Cálculo de Dosis en el Paciente con Monte Carlo

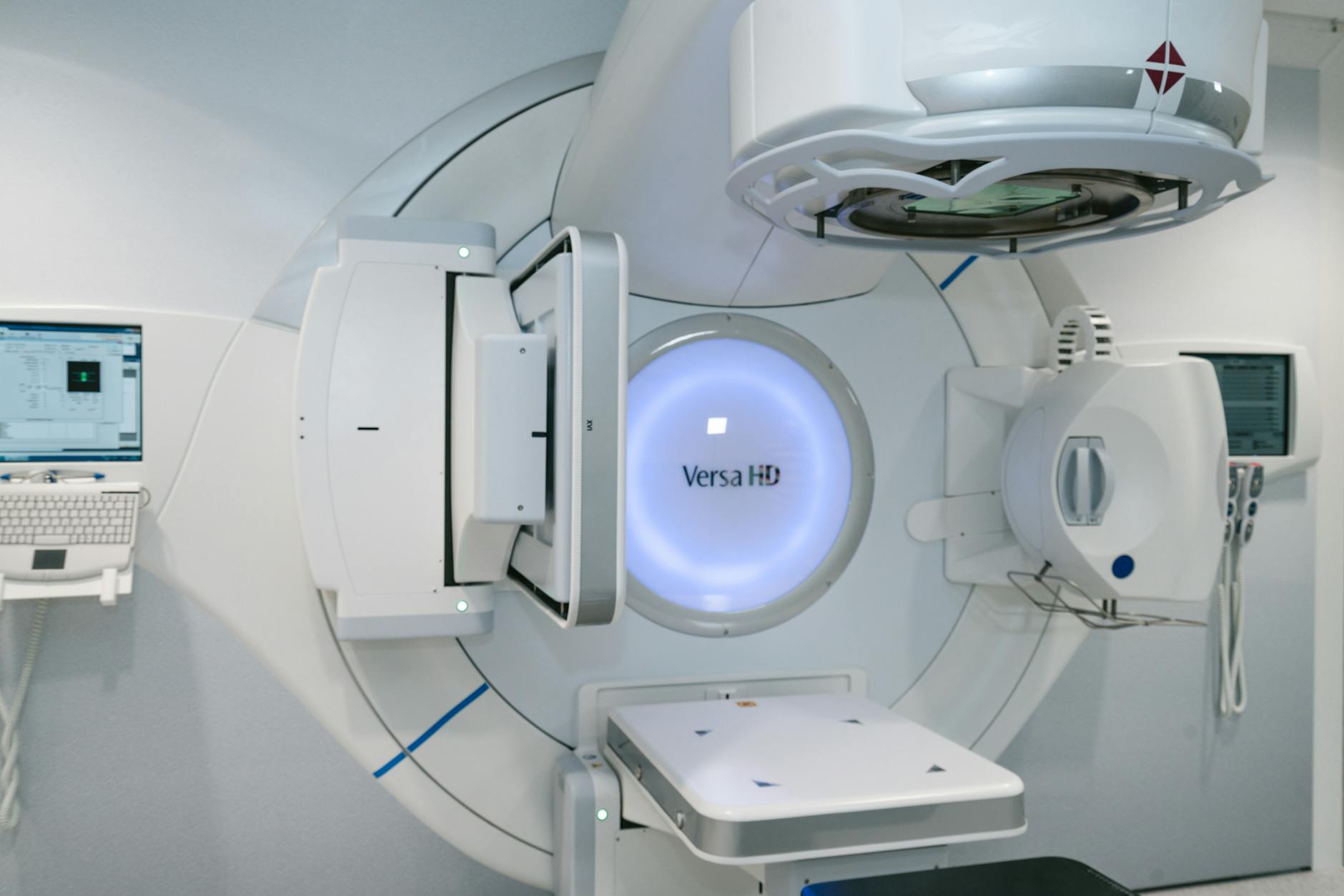

Calcular la dosis absorbida en el paciente con precisión clínica requiere algoritmos que reproduzcan fielmente la física de las interacciones de radiación en tejidos heterogéneos. El método Monte Carlo (MC) se considera el estándar de oro para esta tarea, con códigos como EGSnrc, MCNP, GEANT4 y PENELOPE liderando tanto la práctica clínica como la investigación. Todos ellos se basan en las técnicas de historia condensada desarrolladas por Berger (1963), donde miles de interacciones electrónicas se agrupan en un solo paso de transporte.

Guía completa de la serie: para ver el panorama general y los artículos relacionados, vuelve a la guía completa sobre Monte Carlo en radioterapia.

En la historia condensada clase I (como MCNP, que hereda el algoritmo de ETRAN), todas las colisiones se agrupan y las partículas secundarias por encima de un umbral de energía se generan después del paso. En la clase II — utilizada por EGSnrc, GEANT4 y PENELOPE — las colisiones hard se rastrean individualmente, mientras las soft se agrupan. Esta distinción importa en la práctica: los artefactos de tamaño de paso y problemas de cruce de frontera entre regiones ya están bien comprendidos y resueltos en las versiones actuales de los códigos.

Para una visión completa del método Monte Carlo en radioterapia, consulte nuestra guía completa sobre técnicas de Monte Carlo en radioterapia.

Incertidumbres Estadísticas en el Cálculo de Dosis MC

Toda simulación MC introduce ruido estadístico inevitable en la dosis calculada. La fluctuación de la dosis alrededor del valor medio en cada vóxel afecta directamente la calidad de las curvas de isodosis y los histogramas dosis-volumen (DVHs). La eficiencia del cálculo combina la varianza estimada con el tiempo de CPU requerido:

$$\varepsilon = \frac{1}{\sigma^2 T}$$

Donde:

- epsilon = eficiencia (figura de mérito) de la simulación MC

- sigma al cuadrado = varianza estimada en la cantidad de interés

- T = tiempo de CPU (segundos)

Mejorar la eficiencia significa reducir la varianza para un tiempo T dado, o disminuir T manteniendo la varianza constante. Las técnicas de reducción de varianza (VRTs) atacan el primer camino, usando trucos físicos y matemáticos para acelerar la convergencia sin alterar el número de historias simuladas. Para más detalles sobre VRTs, consulte nuestro artículo sobre fundamentos del Monte Carlo en radioterapia.

Geometrías de Scoring y Métodos de Incertidumbre

La geometría donde se deposita la dosis influye tanto en la precisión como en la velocidad del cálculo. El motor de dosis PEREGRINE utiliza dosels — esferas superpuestas independientes de la malla de transporte de material — y termina la simulación cuando la desviación estándar en el dosel de dosis máxima alcanza un umbral definido por el usuario. El motor MMC (Macro Monte Carlo) utiliza kugels: esferas macroscópicas de diferentes materiales con historias de transporte precalculadas, almacenadas en tablas de consulta, acelerando enormemente el transporte de electrones.

El scoring por órganos segmentados ofrece otro enfoque: al combinar muchos vóxeles en un volumen grande, se gana capacidad de predecir la dosis orgánica de forma rápida y precisa, aunque se pierde resolución espacial. El fantoma NCAT — basado en el Visible Human Dataset con superficies B-spline — simula movimiento cardíaco y respiratorio, siendo ideal para estudios 4D controlados.

El tamaño del vóxel afecta directamente el tiempo de cálculo: Cygler et al. (2004) demostraron que el número de historias necesarias por unidad de área es linealmente proporcional a la masa de los vóxeles de scoring.

Varianza Latente

La incertidumbre estadística total en el cálculo de dosis tiene dos fuentes: la simulación del cabezal del acelerador y las fluctuaciones en la dosis del paciente/fantoma. Sempau et al. (2001) acuñaron el término varianza latente para describir la incertidumbre asociada a las fluctuaciones estadísticas en los datos de phase space. Si las partículas del phase space se reutilizan asumiendo independencia, la incertidumbre se aproxima a un valor finito — la varianza latente — independientemente del número de reutilizaciones.

Método Batch vs. History-by-History

En el método batch, la incertidumbre se estima agrupando las historias en N lotes (típicamente 10):

$$s_X = \sqrt{\frac{\sum_{i=1}^{N}(X_i – \bar{X})^2}{N(N-1)}}$$

Walters et al. (2002) señalaron tres problemas: fluctuaciones en la propia incertidumbre con pocos lotes, correlaciones ignoradas entre partículas incidentes y una dimensión extra en los datos almacenados.

El método history-by-history, implementado siguiendo a Salvat et al. (2009), resuelve estas limitaciones. La incertidumbre se calcula directamente a partir de los acumuladores mantenidos durante la simulación, sin necesidad de almacenar datos en lotes separados.

Denoising y Suavización de Distribuciones MC

Las simulaciones MC con pocas historias generan ruido estadístico que perjudica la evaluación clínica. En lugar de simplemente aumentar el número de historias — lo cual no siempre es práctico — se pueden aplicar algoritmos de denoising para reducir el ruido sin comprometer la precisión. Kawrakow (2002) estableció cinco criterios de referencia para evaluar algoritmos de suavización: inspección visual de isodosis, diferencia de DVHs, dosis máxima, RMSD y el test x%/y mm (recomendación actual: 2-3%/2 mm).

| Método | Autor(es) | Factor de Aceleración | Características |

|---|---|---|---|

| Denoising DVH (deconvolución) | Sempau y Bielajew (2000) | n/a | DVH calculado como DVH verdadero convolucionado con ruido |

| Denoising DVH (restauración) | Jiang et al. (2000) | n/a | Función de deblurring con minimización least-square |

| Filtros digitales 3D (Deasy) | Deasy (2000) | n/a | Primero en proponer denoising de distribución 3D de dosis |

| Wavelet Threshold | Deasy et al. (2002) | 2x o más | Coeficientes wavelet bajo el umbral igualados a cero |

| Savitzky-Golay 3D Adaptativo | Kawrakow (2002) | 2-20x | Ventana adaptativa basada en la incertidumbre local |

| Difusión Anisotrópica 3D | Miao et al. (2003) | hasta 20x | Preserva gradientes de dosis, reduce ruido 2-5x |

| IRON | Fippel y Nüsslin (2003) | 2-10x | Minimiza derivadas parciales de segundo orden |

| Content Adaptive Median Hybrid | El Naqa et al. (2005) | n/a | Mediana en bordes, media en regiones homogéneas |

Fuente: Monte Carlo Techniques in Radiation Therapy (2nd ed., CRC Press, 2022)

El filtro Savitzky-Golay 3D de Kawrakow se destaca en la práctica: su ventana de suavización se adapta a la incertidumbre estadística local, reduciendo el número de historias necesarias por factores de 2 a 20. Esto lo hace particularmente valioso durante la fase iterativa de la planificación.

Conversión CT a Tejido en el Cálculo MC

La conversión de números Hounsfield (HU) de la tomografía computarizada en composición y densidad de materiales es uno de los pasos más críticos del cálculo de dosis MC. Los algoritmos iniciales usaban seis materiales o menos (aire, pulmón, grasa, agua, músculo, hueso). du Plessis et al. (1998) evaluaron 16 tejidos humanos y concluyeron que siete subconjuntos eran suficientes para alcanzar 1% de precisión en la dosis con haces de fotones de megavoltaje — resultando en 57 tipos de tejido, incluyendo 21 tipos de hueso cortical (1.100-3.000 HU) y 31 tejidos pulmonares (20-950 HU).

El avance real llegó con los esquemas estequiométricos, propuestos por Schneider et al. (1996) originalmente para algoritmos de protones. La idea central: escanear materiales de composición conocida para calibrar, ajustar los HU medidos a una ecuación teórica que relaciona HU, densidad, Z y peso atómico, y usar los parámetros ajustados para calcular los HU de tejidos reales.

Vanderstraeten et al. (2007) generalizaron el esquema a 14 subconjuntos dosimétricamente equivalentes (10 de hueso), reduciendo diferencias de hasta 5% en la interfaz tejido-hueso que existían con el esquema de 5 bins. La calibración fue validada en nueve departamentos de radioterapia europeos con diferentes escáneres CT.

CT Dual-Energy: Conversión Mejorada

La imagen CT dual-energy escanea el objeto con dos voltajes de tubo diferentes para estimar mejor el número atómico efectivo Z y la densidad electrónica relativa. Bazalova et al. (2008) reportaron errores medios de extracción de 1,8% y 2,8%, respectivamente. Para el haz de 250 kVp, los errores de dosis alcanzaron el 17% por asignación incorrecta de tejido; para 18 MeV de electrones y 18 MV de fotones, los errores fueron del 6% y 3%; para 6 MV, las diferencias quedaron por debajo del 1%.

Registro Deformable y Cálculo de Dosis 4D

El registro deformable de imágenes conecta fases respiratorias, propagación de contornos y optimización 4D. Keall et al. (2004) realizaron uno de los primeros cálculos MC 4D: la dosis se calculó por separado en 8 CTs 3D (una por fase respiratoria) y se mapeó de vuelta a la fase de referencia usando registro deformable. Para un panorama completo de dinámica 4D, vea nuestro artículo sobre Dynamic Beam Delivery y Monte Carlo 4D.

Flampouri et al. (2005) compararon planificación 3D y 4D para seis pacientes de IMRT pulmonar y concluyeron que la planificación convencional era suficiente para movimiento tumoral menor a 12 mm. Los artefactos de reconstrucción CT tuvieron mayor impacto que el movimiento en sí. Tres fases respiratorias permiten un error del 3% relativo a la composición de 10 fases; cinco fases lo reducen al 0,5%.

Seco et al. (2008) introdujeron el índice omega para analizar diferencias de dosis en función de la densidad tisular. Se observaron diferencias de 3-5 Gy entre inhalación y free-breathing tanto en regiones de baja densidad (pulmón) como de alta (hueso), mostrando que el MC 4D mejora las predicciones no solo en el tumor, sino en todo el PTV.

Heath et al. (2008) compararon tres métodos de warping de dosis — rastreo de centro de masa, interpolación trilineal y defDOSXYZ — sin diferencias clínicamente significativas entre ellos. Cuando no se consideraba el movimiento, el volumen blanco se subestimaba hasta en un 16%.

Planificación Inversa con Monte Carlo

La planificación inversa IMRT calcula la matriz D que convierte fluencias en dosis. Cada elemento de esta matriz puede calcularse mediante pencil beam, convolución/superposición o MC. Sin embargo, la formulación estándar frecuentemente no modela restricciones de delivery ni factores de output dependientes del tamaño de campo.

Jeraj y Keall (1999) realizaron el primer intento de planificación inversa 3D con MC (MCNP + EGS4), generando pencil beams MC. Siebers y Kawrakow (2007) refinaron con un método híbrido: predicción inicial por pencil beam, mejorada iterativamente por MC, alcanzando una ganancia de 2,5x sobre optimización MC pura.

Nohadani et al. (2009) propusieron un enfoque de broad beam para MC-PB 4D: el phase space después de los jaws se divide en píxeles, cada uno generando una distribución pencil beam MC en el paciente. Si todos los PBs se combinan en campo abierto, el factor de output es el de campo estándar. La comparación de DVHs mostró que los planes IMRT basados en pencil beam convencional pueden parecer superiores en cobertura de PTV, pero se desvían significativamente de la dosis real depositada calculada por MC.

Considerando el uso clínico del Monte Carlo para fotones y las técnicas de modelado para electrones, queda claro que el cálculo de dosis MC en el paciente reúne los avances de toda la cadena — desde el modelo de fuente hasta la entrega dinámica — para proporcionar la evaluación dosimétrica más realista posible.