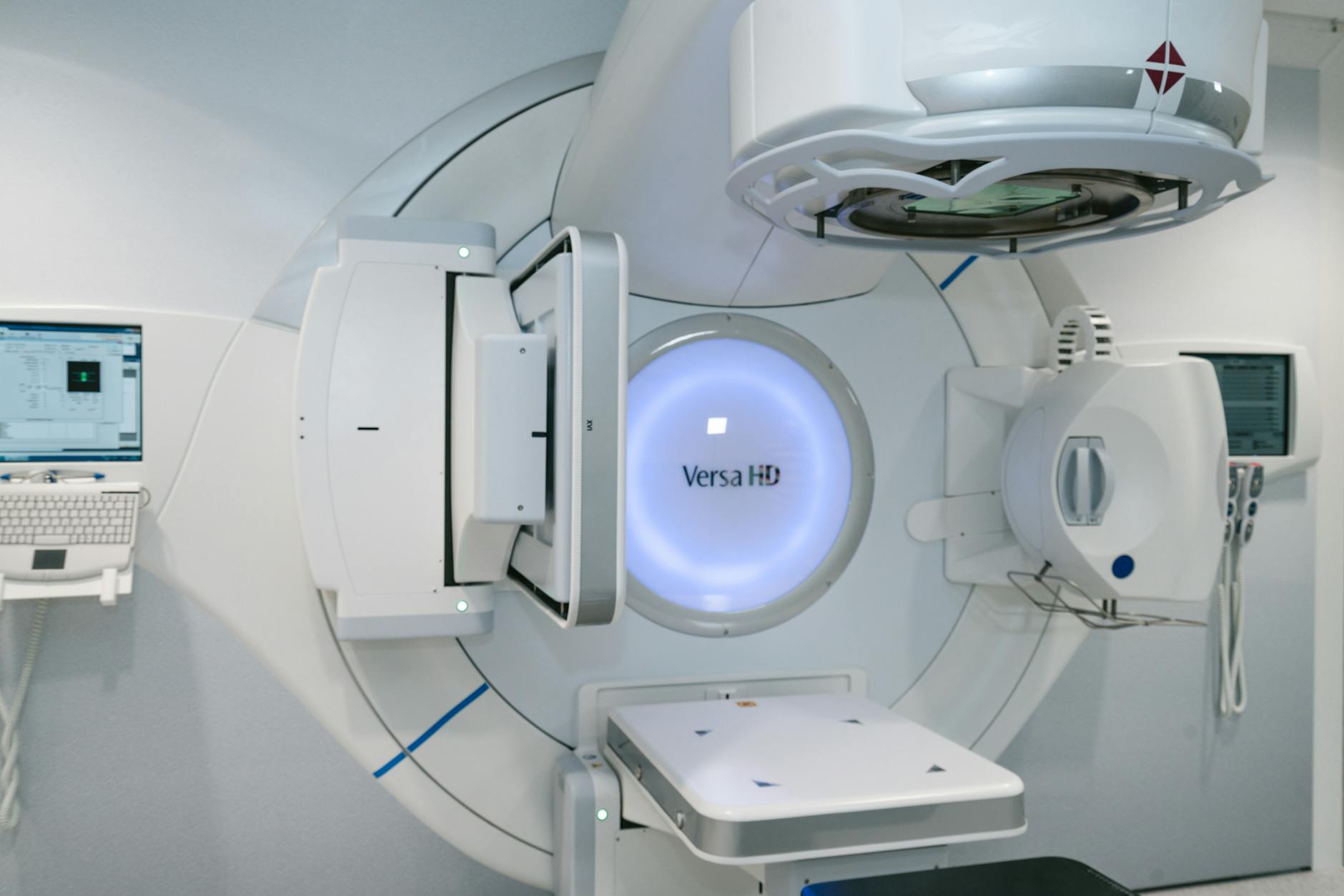

Cálculo de Dose no Paciente com Monte Carlo

Calcular a dose absorvida no paciente com precisão clínica exige algoritmos que reproduzam fielmente a física das interações de radiação em tecidos heterogêneos. O método Monte Carlo (MC) é considerado o padrão-ouro para essa tarefa, com códigos como EGSnrc, MCNP, GEANT4 e PENELOPE liderando a prática clínica e a pesquisa. Todos eles se baseiam nas técnicas de história condensada desenvolvidas por Berger (1963), onde milhares de interações eletrônicas são agrupadas em um único passo de transporte.

Guia completo da série: para visão geral e links dos artigos relacionados, volte ao guia completo sobre Monte Carlo em radioterapia.

Na história condensada classe I (como o MCNP, que herda o algoritmo do ETRAN), todas as colisões são agrupadas e partículas secundárias acima de um limiar de energia são geradas após o passo. Já na classe II — usada pelo EGSnrc, GEANT4 e PENELOPE — colisões hard são rastreadas individualmente, enquanto as soft são agrupadas. Essa distinção importa na prática: artefatos de tamanho de passo e problemas de cruzamento de fronteira entre regiões já são bem compreendidos e resolvidos nas versões atuais dos códigos.

Para uma visão completa do método Monte Carlo na radioterapia, confira nosso guia completo sobre técnicas de Monte Carlo em radioterapia.

Incertezas Estatísticas no Cálculo de Dose MC

Toda simulação MC introduz ruído estatístico inevitável na dose calculada. A flutuação da dose em torno do valor médio em cada voxel afeta diretamente a qualidade das curvas de isodose e dos histogramas dose-volume (DVHs). Caracterizamos essas flutuações pela variância, e a eficiência do cálculo combina a variância estimada com o tempo de CPU necessário:

$$\varepsilon = \frac{1}{\sigma^2 T}$$

Onde:

- epsilon = eficiência (figura de mérito) da simulação MC

- sigma ao quadrado = variância estimada na quantidade de interesse

- T = tempo de CPU (segundos)

Melhorar a eficiência significa reduzir a variância para um dado tempo T, ou diminuir T mantendo a variância constante. As técnicas de redução de variância (VRTs) atacam o primeiro caminho, usando truques físicos e matemáticos para acelerar a convergência sem alterar o número de histórias simuladas. Para mais detalhes sobre VRTs, consulte nosso artigo sobre fundamentos do Monte Carlo em radioterapia.

Geometrias de Scoring e Métodos de Incerteza

A geometria onde a dose é depositada influencia tanto a precisão quanto a velocidade do cálculo. O motor de dose PEREGRINE usa dosels — esferas sobrepostas independentes da malha de transporte de material — e termina a simulação quando o desvio padrão no dosel de dose máxima atinge um limiar definido pelo usuário. Já o motor MMC (Macro Monte Carlo) utiliza kugels: esferas macroscópicas de diferentes materiais com histórias de transporte pré-calculadas, armazenadas em tabelas de consulta, o que acelera enormemente o transporte de elétrons.

O scoring por órgãos segmentados é outra abordagem: ao combinar muitos voxels em um volume grande, ganhamos capacidade de prever a dose orgânica de forma rápida e precisa, embora percamos resolução espacial. O phantom NCAT — baseado no Visible Human Dataset e usando superfícies B-spline — permite simular movimento cardíaco e respiratório, tornando-se ideal para estudos 4D controlados.

O tamanho do voxel afeta diretamente o tempo de cálculo: Cygler et al. (2004) demonstraram que o número de histórias necessárias por unidade de área é linearmente proporcional à massa dos voxels de scoring.

Variância Latente

A incerteza estatística total no cálculo de dose tem duas fontes: a simulação do cabeçote do acelerador e as flutuações na dose no paciente/phantom. Sempau et al. (2001) introduziram o conceito de variância latente para descrever a incerteza ligada às flutuações estatísticas nos dados de phase space. Se as partículas do phase space são reutilizadas assumindo independência, a incerteza se aproxima de um valor finito — a variância latente — independentemente de quantas vezes o phase space é reutilizado.

Método Batch vs. History-by-History

No método batch, a incerteza é estimada agrupando as histórias em N lotes (tipicamente 10):

$$s_X = \sqrt{\frac{\sum_{i=1}^{N}(X_i – \bar{X})^2}{N(N-1)}}$$

Walters et al. (2002) apontaram três problemas: flutuações na própria incerteza com poucos lotes, correlações ignoradas entre partículas incidentes e uma dimensão extra nos dados armazenados.

O método history-by-history, implementado seguindo Salvat et al. (2009), resolve essas limitações. A incerteza é calculada diretamente a partir dos acumuladores mantidos durante a simulação, sem necessidade de armazenar dados em lotes separados.

Denoising e Suavização de Distribuições MC

Simulações MC com poucas histórias geram ruído estatístico que prejudica a avaliação clínica. Em vez de simplesmente aumentar o número de histórias — o que nem sempre é prático — pode-se aplicar algoritmos de denoising para reduzir o ruído sem comprometer a precisão. Kawrakow (2002) estabeleceu cinco critérios que se tornaram referência para avaliar algoritmos de suavização: inspeção visual de isodoses, diferença de DVHs, dose máxima, RMSD e o teste x%/y mm (recomendação atual: 2-3%/2 mm).

| Método | Autor(es) | Fator de Aceleração | Características |

|---|---|---|---|

| Denoising DVH (deconvolução) | Sempau e Bielajew (2000) | n/a | DVH calculado como DVH verdadeiro convolvido com ruído |

| Denoising DVH (restauração) | Jiang et al. (2000) | n/a | Função de deblurring com minimização least-square |

| Filtros digitais 3D (Deasy) | Deasy (2000) | n/a | Primeiro a propor denoising de distribuição 3D de dose |

| Wavelet Threshold | Deasy et al. (2002) | 2x ou mais | Coeficientes wavelet abaixo do limiar zerados |

| Savitzky-Golay 3D Adaptativo | Kawrakow (2002) | 2-20x | Janela adaptativa baseada na incerteza local |

| Difusão Anisotrópica 3D | Miao et al. (2003) | até 20x | Preserva gradientes de dose, reduz ruído 2-5x |

| IRON | Fippel e Nüsslin (2003) | 2-10x | Minimiza derivadas parciais de segunda ordem |

| Content Adaptive Median Hybrid | El Naqa et al. (2005) | n/a | Mediana em bordas, média em regiões homogêneas |

Fonte: Monte Carlo Techniques in Radiation Therapy (2nd ed., CRC Press, 2022)

O filtro Savitzky-Golay 3D de Kawrakow se destaca na prática: a janela de suavização se adapta à incerteza estatística local, reduzindo o número de histórias necessárias por fatores de 2 a 20. Isso o torna particularmente valioso na fase iterativa do planejamento.

Conversão CT para Tecido no Cálculo MC

A conversão de números Hounsfield (HU) da tomografia computadorizada em composição e densidade de materiais é um dos passos mais críticos do cálculo de dose MC. Algoritmos iniciais usavam seis materiais ou menos (ar, pulmão, gordura, água, músculo, osso). du Plessis et al. (1998) avaliaram 16 tecidos humanos e concluíram que sete subconjuntos eram suficientes para atingir 1% de precisão na dose com feixes de fótons de megavoltagem — resultando em 57 tipos de tecido, incluindo 21 tipos de osso cortical (1.100-3.000 HU) e 31 tecidos pulmonares (20-950 HU).

O avanço real veio com os esquemas estequiométricos, propostos por Schneider et al. (1996) originalmente para algoritmos de prótons. A ideia central: escanear materiais de composição conhecida para calibrar, ajustar os HU medidos a uma equação teórica que relaciona HU, densidade, Z e peso atômico, e usar os parâmetros ajustados para calcular os HU de tecidos reais.

Vanderstraeten et al. (2007) generalizaram o esquema para 14 subconjuntos dosimetricamente equivalentes (10 de osso), reduzindo diferenças de até 5% na interface tecido-osso que existiam com o esquema de 5 bins. A calibração foi validada em nove departamentos de radioterapia europeus com diferentes scanners CT.

CT Dual-Energy: Conversão Aprimorada

A imagem CT dual-energy escaneia o objeto com duas voltagens de tubo diferentes para estimar melhor o número atômico efetivo Z e a densidade eletrônica relativa. Bazalova et al. (2008) mostraram erros médios de extração de 1,8% e 2,8%, respectivamente. Para o feixe de 250 kVp, os erros de dose chegaram a 17% por atribuição incorreta de tecido; para 18 MeV de elétrons e 18 MV de fótons, os erros foram de 6% e 3%; já para 6 MV, as diferenças ficaram abaixo de 1%.

Registro Deformável e Cálculo de Dose 4D

O registro deformável de imagens conecta fases respiratórias, propagação de contornos e otimização 4D. Keall et al. (2004) realizaram um dos primeiros cálculos MC 4D: a dose foi calculada separadamente em 8 CTs 3D (uma por fase respiratória) e mapeada de volta para a fase de referência usando registro deformável. Para um panorama completo de dinâmica 4D, veja nosso artigo sobre Dynamic Beam Delivery e Monte Carlo 4D.

Flampouri et al. (2005) compararam planejamento 3D e 4D para seis pacientes de IMRT pulmonar e concluíram que o planejamento convencional era suficiente para movimento tumoral menor que 12 mm. Artefatos de reconstrução CT tiveram impacto maior que o movimento em si. Três fases respiratórias permitem erro de 3% relativo à composição de 10 fases; cinco fases reduzem a 0,5%.

Seco et al. (2008) introduziram o índice omega para analisar diferenças de dose em função da densidade tecidual. Diferenças de 3-5 Gy entre inalação e free-breathing foram observadas tanto em regiões de baixa densidade (pulmão) quanto de alta (osso), mostrando que o MC 4D melhora predições não apenas no tumor, mas em todo o PTV (volume-alvo de planejamento).

Heath et al. (2008) compararam três métodos de warping de dose — rastreamento de centro de massa, interpolação trilinear e defDOSXYZ — sem diferenças clinicamente significativas entre eles. Quando o movimento não era considerado, o subtarget era subestimado em até 16%.

Planejamento Inverso com Monte Carlo

O planejamento inverso IMRT calcula a matriz D que converte fluências em dose. Cada elemento dessa matriz pode ser calculado por pencil beam, convolução/superposição ou MC. Porém, a formulação padrão frequentemente não modela restrições de delivery nem fatores de output dependentes do tamanho de campo.

Jeraj e Keall (1999) fizeram a primeira tentativa de planejamento inverso 3D com MC (MCNP + EGS4), gerando pencil beams MC. Siebers e Kawrakow (2007) refinaram com um método híbrido: predição inicial por pencil beam, melhorada iterativamente por MC, alcançando ganho de 2,5x sobre otimização MC pura.

Nohadani et al. (2009) propuseram uma abordagem de broad beam para MC-PB 4D: o phase space após os jaws é dividido em pixels, cada um gerando uma distribuição pencil beam MC no paciente. Se todos os PBs são combinados em campo aberto, o fator de output é o de campo padrão. A comparação de DVHs mostrou que planos IMRT baseados em pencil beam convencional podem parecer superiores em cobertura de PTV, mas desviam significativamente da dose real depositada calculada por MC. Erros no cálculo de dose não podem ser negligenciados.

Considerando o uso clínico de Monte Carlo para fótons e as técnicas de modelagem para elétrons, fica evidente que o cálculo de dose MC no paciente reúne os avanços de toda a cadeia — do modelo de fonte até a entrega dinâmica — para fornecer a avaliação dosimétrica mais realista possível.