Neste Artigo

- 1. Método de Clarkson: Separação Primário-Espalhamento

- 2. Integração 2D e Correção para Campos Modulados

- 3. Extensão para Energias Altas: Mini-Phantom e TPR

- 4. O Princípio da Superposição e a Convolução de Kernels

- 5. Fluência Energética e Modelagem da Fonte

- 6. TERMA: Energia Total Liberada por Unidade de Massa

- 7. Kernels de Deposição de Energia em Água

- 8. Comparação: Clarkson vs Convolução/Superposição

O cálculo de dose por superposição de kernels representa o salto conceitual que separou os métodos empíricos de feixe largo dos algoritmos modernos usados nos sistemas de planejamento de tratamento (TPS). Antes de chegar à convolução propriamente dita, porém, existe uma etapa intermediária fundamental: a separação entre componente primária e espalhada da radiação — formalizada pelo método de Clarkson — e a quantificação da energia total liberada no meio, expressa pelo conceito de TERMA. Este artigo percorre essa trajetória, das integrações angulares de espalhamento até a formulação completa da convolução/superposição de kernels, conforme descrito no Handbook of Radiotherapy Physics (2ª edição). Para uma visão panorâmica de todos os algoritmos, do empírico ao Monte Carlo, confira nosso guia completo sobre algoritmos de cálculo de dose por fótons.

Método de Clarkson: Separação Primário-Espalhamento

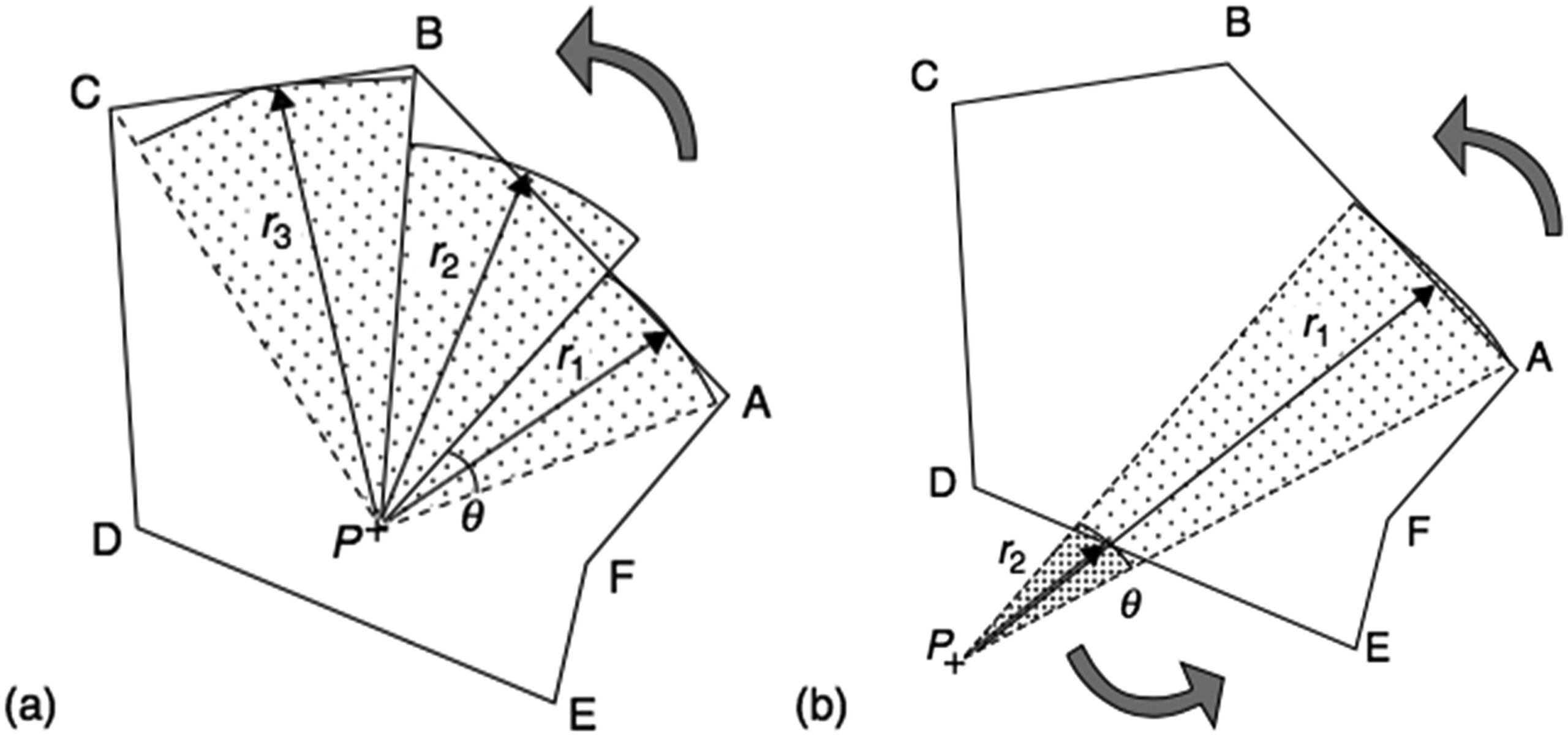

A ideia central do método de Clarkson é calcular separadamente a dose primária e a dose espalhada em qualquer ponto de interesse $P$. A componente primária depende apenas da atenuação ao longo do eixo fonte-ponto, enquanto a componente espalhada depende da geometria do campo inteiro — sua forma, tamanho e proximidade do ponto $P$.

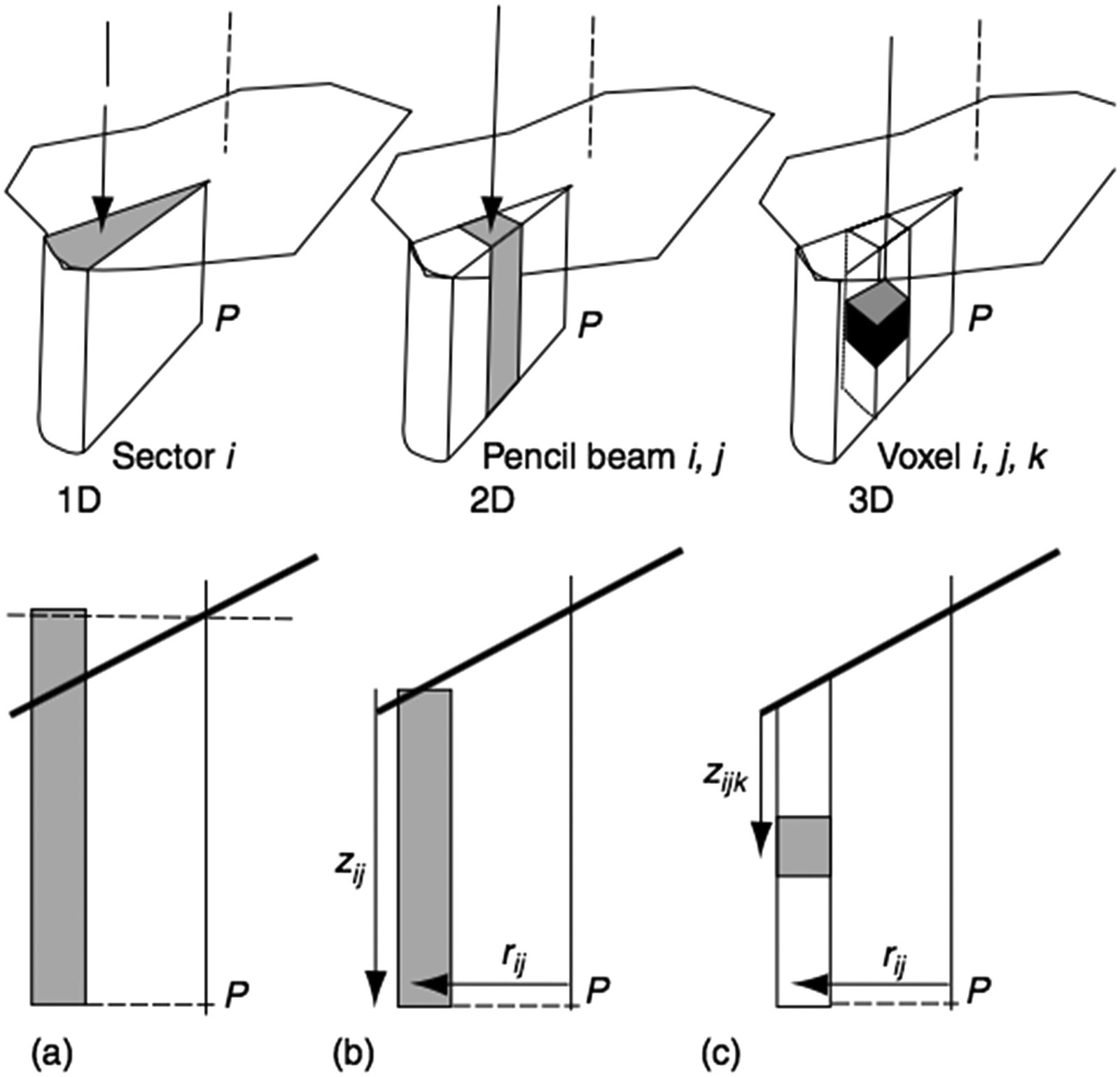

O campo irregular é dividido em $n$ setores angulares centrados em $P$. Cada setor $i$ possui largura angular $\Delta\theta_i$ e raio $r_i$ (medido até a borda do campo). O espalhamento é então somado sobre todos os setores usando razões de espalhamento-ar (SAR) tabuladas:

$$D_S(x,y,z) = D_A(z) \times \sum_i S(z, r_i) \frac{\Delta\theta_i}{2\pi}$$

Onde:

- $D_A(z)$ é a dose “no ar” (sem atenuação) na posição $(0,0,z)$

- $S(z, r_i)$ é a razão de espalhamento-ar (scatter-air ratio) para profundidade $z$ num campo circular de raio $r_i$

- $\Delta\theta_i / 2\pi$ é a fração angular que o setor representa do círculo completo

A componente primária, por sua vez, utiliza o TAR de campo zero — um conceito matemático que representa a atenuação pura, sem espalhamento. Na prática, TAR$_0(z)$ não pode ser medido diretamente; é obtido por extrapolação de TARs para campos pequenos até tamanho zero, ou por medições em condições livres de espalhamento com grandes distâncias entre fonte e detector.

$$D_P(x,y,z) = D_A(z) \times \text{TAR}_0(z) \times f(x,y)$$

Aqui $f(x,y)$ é o fator off-axis no ar que corrige o perfil do feixe. A dose total é simplesmente:

$$D(x,y,z) = D_P(x,y,z) + D_S(x,y,z)$$

Quando o ponto $P$ está fora do campo, o mesmo somatório funciona: setores percorridos da direita para a esquerda (de A para B) recebem sinal positivo, e da esquerda para a direita (de D para E), negativo — mantendo apenas a contribuição real de dentro do campo.

Integração 2D e Correção para Campos Modulados

O Clarkson clássico assume superfície plana e fluência primária uniforme. Na prática clínica, a superfície do paciente é oblíqua e irregular, e o feixe primário pode ser modulado por filtros de cunha, compensadores ou colimadores multi-lâminas (MLC). A solução está na extensão para integração 2D com elementos tipo “lápis” (pencil-beam scatter):

Cada elemento de espalhamento fica referenciado a um sistema de coordenadas polares centrado no ponto de cálculo $P$, a uma distância $r_{ij}$ ao longo do raio definido pelo ângulo $\theta_i$, com espessura de tecido $z_{ij}$:

$$\Delta S_{ij}(z_{ij}, \theta_i, r_{ij}) = \frac{\Delta\theta_i}{2\pi} \times \left[ S(z_{ij}, r_{ij} + \Delta r) – S(z_{ij}, r_{ij}) \right]$$

Na integração sobre a área do campo, cada pencil beam é ponderado pela fluência primária local no ponto $ij$. Essa extensão produz resultados satisfatórios mesmo para IMRT com MLC (Papatheodorou et al. 2000), uma vez que a obliquidade da superfície e a modulação da intensidade são consideradas explicitamente.

Tentativas de ir além — integrações 3D como o método dSAR (differential scatter-air ratio) de Beaudoin (1968) e Cunningham (1972) — enfrentaram problemas com o comportamento complexo do espalhamento múltiplo e foram parcialmente abandonadas. Os métodos delta-volume (Wong e Henkelman, 1983), dTAR (Kappas e Rosenwald, 1986b) e ETAR melhorado (Redpath e Thwaites, 1991) trouxeram refinamentos, mas todos compartilham uma limitação fundamental: assumem que o caminho dos elétrons secundários é desprezível.

Extensão para Energias Altas: Mini-Phantom e TPR

Conforme a energia dos fótons aumenta, o conceito de dose “no ar” perde relevância prática. As capas de build-up necessárias para equilíbrio eletrônico tornam-se grandes demais, e a atenuação e espalhamento dentro delas não podem ser ignorados. O TAR precisa ser substituído.

A solução veio com o conceito de mini-phantom: a atenuação da componente primária passa a ser representada pelo TPR (tissue phantom ratio) medido num mini-fantoma, TPR$(z, \text{ESQ}_{\text{mini}})$, onde ESQ$_{\text{mini}}$ é o quadrado equivalente correspondente à geometria do mini-fantoma. A SAR é substituída por SAR$’$, obtida a partir de:

$$\text{SAR}'(z, \text{ESQ}_z) = \text{TAR}'(z, \text{ESQ}_z) – \text{TPR}(z, \text{ESQ}_{\text{mini}})$$

Com TAR$’$ definida como:

$$\text{TAR}'(z, \text{ESQ}_z) = \text{TPR}(z, A_z) \frac{S_p(z_{\text{ref}}, \text{ESQ}_z)}{S_p(z_{\text{ref}}, \text{ESQ}_{\text{mini}})}$$

Onde $S_p$ é o fator de correção de espalhamento no fantoma (phantom scatter correction factor). A dose de referência “no ar” $D_A$ é substituída pela dose no mini-fantoma na profundidade $z_{\text{ref}}$ para a abertura de colimador $A$, derivada pelo processo de calibração interna.

Esses métodos de separação primário-espalhamento geram resultados aceitáveis em muitas situações clínicas para campos maiores que ESQ$_{\text{mini}}$ em meio tipo água (Knöös et al. 2006). Contudo, falham onde há falta de equilíbrio eletrônico: bordas de campo, interfaces com heterogeneidades, campos pequenos em feixes de alta energia atravessando pulmão (Mohan e Chui, 1985; Mackie et al., 1985; AAPM, 2004). Essa limitação motivou a transição para os métodos baseados em superposição de kernels de deposição de energia.

O Princípio da Superposição e a Convolução de Kernels

A ideia de usar convolução/superposição de kernels para cálculo de dose foi proposta independentemente por vários grupos em 1984: Ahnesjö, Boyer e Mok, Chui e Mohan, Mackie e Scrimger. O conceito é elegante na sua generalidade.

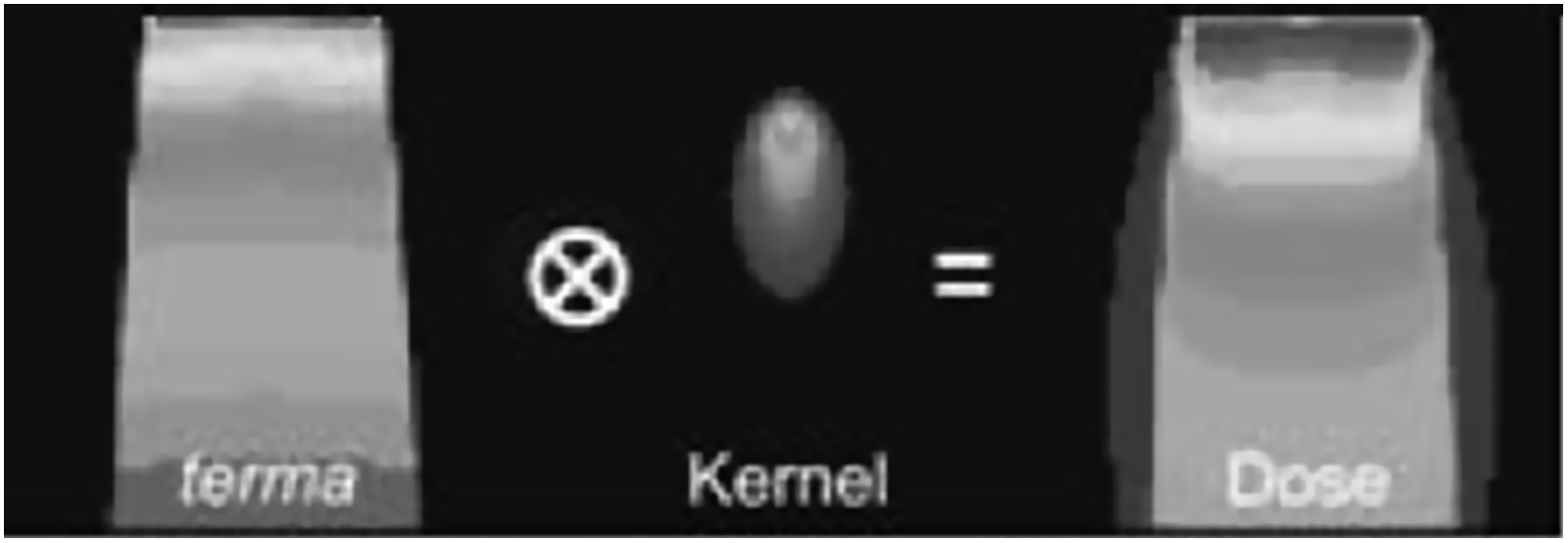

Para um meio homogêneo, a dose no ponto $P$ na posição $\mathbf{r} = [x, y, z]$ é dada por:

$$D(\mathbf{r}) = \iiint \Psi(\mathbf{r}’) \frac{\mu}{\rho}(\mathbf{r}’) \, K(\mathbf{r} – \mathbf{r}’) \, dV’$$

Onde:

- $\Psi(\mathbf{r}’)$ é a fluência energética (J m$^{-2}$) no ponto $P’$ na posição $\mathbf{r}’ = [x’, y’, z’]$

- $\mu/\rho(\mathbf{r}’)$ é o coeficiente de atenuação mássico (m$^2$ kg$^{-1}$) no meio em $P’$

- $\Psi(\mathbf{r}’) \cdot \mu/\rho(\mathbf{r}’)$ é a TERMA — energia total (elétrons secundários + fótons espalhados) liberada por unidade de massa em $dV’$ (J kg$^{-1}$ ou Gy)

- $K(\mathbf{r} – \mathbf{r}’)$ é o kernel de deposição de energia, que representa a fração de energia liberada em $dV’$ que é depositada em $P$

A integração é realizada em 3D sobre o volume do paciente. Matematicamente, se o kernel for espacialmente invariante, a operação é uma convolução — o que permite o uso de transformadas de Fourier para acelerar o cálculo. Quando o kernel varia espacialmente (como em meios heterogêneos), a operação é uma superposição, computacionalmente mais custosa mas fisicamente mais correta.

Para feixes clínicos polienergéticos, a formulação geral requer integração adicional sobre os bins de energia do espectro local, com $\Psi$ substituído pela fluência energética diferencial em energia e tanto $\mu/\rho$ quanto $K$ dependendo da energia. Boyer et al. (1989) e Zhu e Van Dyk (1995) demonstraram que um número limitado de bins é suficiente.

Fluência Energética e Modelagem da Fonte

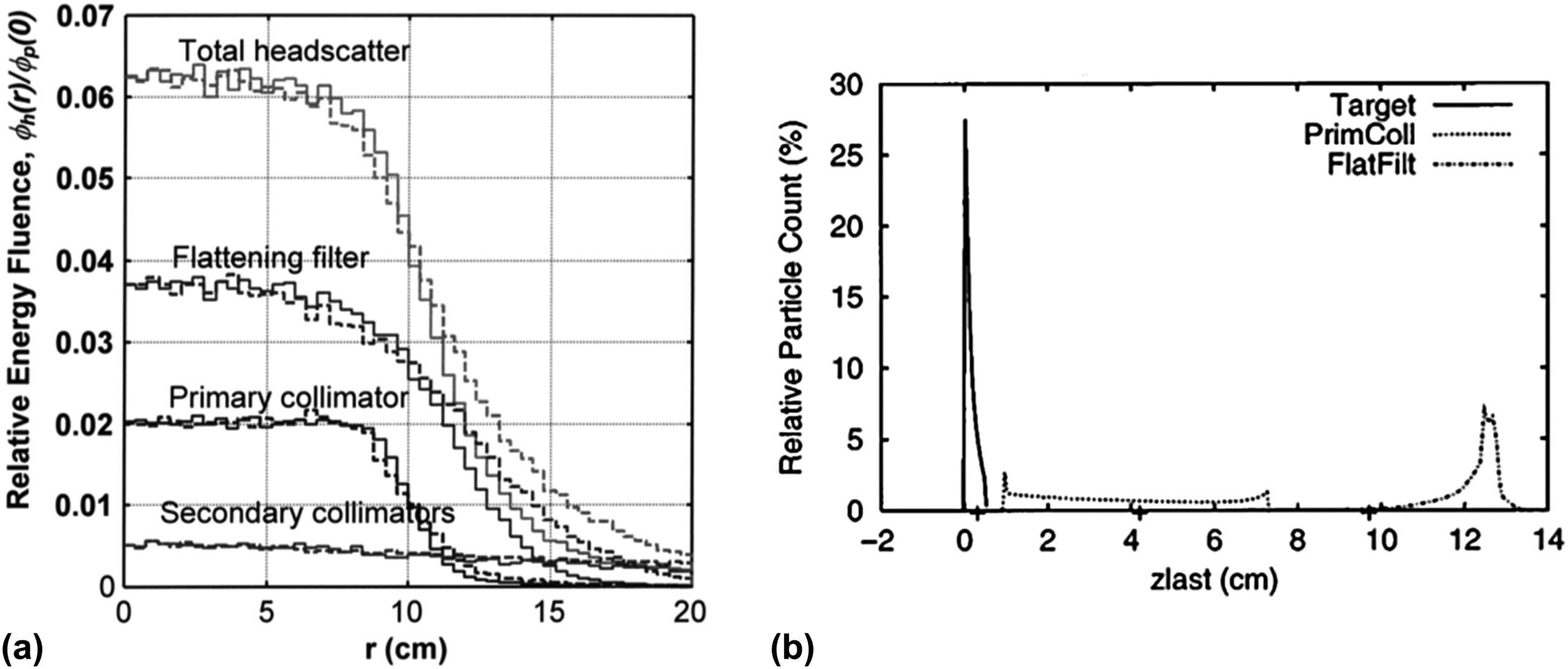

O cálculo da dose por convolução requer dois inputs fundamentais: a fluência energética (ou TERMA) em cada ponto $P’$ e os kernels de deposição ao redor de $P’$. A determinação da fluência é um processo em dois passos: modelar a fluência incidente na superfície do paciente e depois transportá-la através do meio.

Num acelerador linear, os fótons incidentes provêm principalmente de bremsstrahlung emitido pelo alvo. Porém, tipicamente alguns por cento são espalhados pelo filtro aplainador e, em menor proporção, pelas superfícies internas do colimador primário e secundário. Essa contribuição extrafocal tem uma posição de fonte efetiva a jusante do alvo físico e um perfil em forma de sino que se estende além dos limites geométricos do campo.

Para feixes sem filtro aplainador (FFF), a contribuição extrafocal é menor e o modelo pode ser simplificado (Kry et al. 2010; Almberg et al. 2012). Para feixes convencionais, o modelo de fonte normalmente combina múltiplas fontes estendidas — alvo, colimador primário, filtro aplainador — integradas sobre as partes do cabeçote visíveis a partir do ponto de cálculo (Ahnesjö 1994; Sharpe et al. 1995; Fippel et al. 2003).

A modificação da fluência na borda do campo e sob os dispositivos de conformação é baseada em considerações geométricas complementadas pelo cálculo da transmissão através do colimador principal, blocos ou MLC. Com o desenvolvimento da IMRT, tornou-se essencial modelar com precisão a transmissão individual de cada lâmina do MLC (Tyagi et al. 2007). Os resultados são armazenados como mapas 2D de fluência inicial, modificáveis por matrizes de correção para cada dispositivo de conformação.

TERMA: Energia Total Liberada por Unidade de Massa

A fluência incidente deve ser transportada através do paciente por ray tracing ao longo de caminhos divergentes a partir da posição da fonte, aplicando a correção do inverso do quadrado da distância e a atenuação no tecido entre a superfície e $P’$.

Para um feixe monoenergético de energia $E$, a atenuação da radiação primária na profundidade $z’ = \sum_i \Delta z_i$ é calculada como (Ahnesjö et al. 1987):

$$\text{Atenuação} = e^{-\sum_i \left(\frac{\mu}{\rho}\right)_{E,i} \rho_i \Delta z_i}$$

Onde $\rho_i$ é a densidade mássica do voxel $i$ e $(\mu/\rho)_{E,i}$ é o coeficiente de atenuação mássico no voxel $i$ para a energia $E$.

Para feixes polienergéticos, calcular a dose como soma ponderada de cada bin de energia seria computacionalmente proibitivo (Hoban 1995). A solução mais eficiente é usar um kernel polienergético pré-calculado e calcular a atenuação com coeficientes efetivos $\mu_{\text{eff}}$ obtidos pela média ponderada segundo as contribuições espectrais. A modificação espectral com a profundidade (beam hardening) é tratada atenuando cada componente exponencialmente com seu coeficiente próprio (Hoban et al. 1994). Correções lineares adicionais podem ser aplicadas a $\mu_{\text{eff}}$ para compensar o endurecimento com a profundidade (Papanikolaou et al. 1993; Ahnesjö et al. 2005) e o amolecimento off-axis (Tailor et al. 1998).

Os valores de $\mu/\rho$ resultantes são armazenados numa tabela 3D de consulta e multiplicados pela fluência energética local para gerar a distribuição 3D de TERMA (Metcalfe et al. 1990). A TERMA é, portanto, o “mapa de energia disponível” que será redistribuída pelos kernels de deposição.

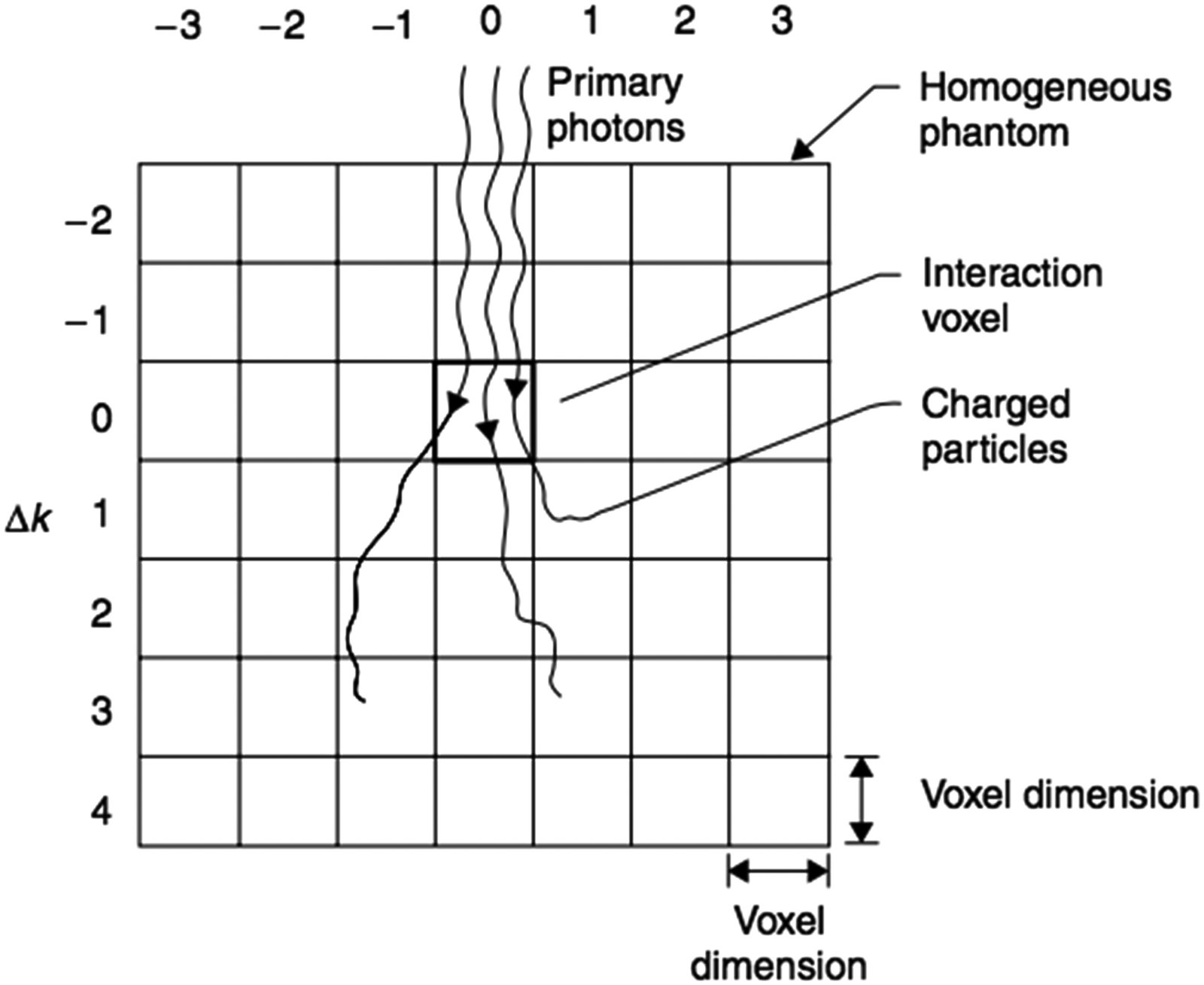

Kernels de Deposição de Energia em Água

Os kernels $K$ na equação de convolução são determinados por simulação Monte Carlo em fantoma de água, forçando a interação dos fótons primários no voxel de origem (Mackie et al. 1988; Mohan et al. 1986; Ahnesjö et al. 1987). Geometria esférica com coordenadas polares é a escolha padrão, com intervalos radiais e angulares que permitem representação precisa da deposição de energia a qualquer distância do ponto de interação.

Esses kernels podem ser decompostos em kernel primário $K_p$ (energia depositada pelas partículas carregadas dos fótons primários) e kernel de espalhamento $K_s$ (energia depositada por todas as partículas associadas a fótons espalhados, incluindo bremsstrahlung e radiação de aniquilação). O kernel $K$ é normalizado como fração da energia incidente por unidade de volume (cm$^{-3}$), satisfazendo:

$$\iiint_{\infty} K(\mathbf{r}) \, dV \approx 1$$

As integrais dos componentes seguem relações fundamentais (Mackie et al. 1988; Boyer et al. 1988):

$$\iiint_{\infty} K_p(\mathbf{r}) \, dV = \frac{\mu_{\text{en}}}{\mu}$$

$$\iiint_{\infty} K_s(\mathbf{r}) \, dV = \frac{\mu – \mu_{\text{en}}}{\mu}$$

Onde $\mu$ é o coeficiente de atenuação linear e $\mu_{\text{en}}$ é o coeficiente de absorção de energia linear. Essas relações servem para verificação dos kernels gerados e para aplicação de correções por variações na qualidade do feixe.

Para feixes clínicos polienergéticos, a abordagem mais eficaz é gerar kernels polienergéticos por adição ponderada de kernels monoenergéticos pré-calculados, segundo o espectro normalizado de fluência energética incidente. Uma vez que o espectro muda com a profundidade e posição lateral (endurecimento do feixe), Liu et al. (1997d) propuseram pré-calcular kernels polienergéticos em diferentes profundidades (tipicamente três) e interpolar entre eles.

Clarkson vs Convolução/Superposição: Quando Usar Cada Um?

| Característica | Clarkson / Separação Primário-Espalhamento | Convolução/Superposição de Kernels |

|---|---|---|

| Princípio físico | Separação empírica primário + espalhamento com SARs tabuladas | Integração 3D da TERMA com kernels MC de deposição de energia |

| Tratamento de heterogeneidades | Correções por fatores (Batho, ETAR); assume caminho de elétrons desprezível | Scaling do kernel por densidade; modela transporte de elétrons implicitamente |

| Precisão na borda do campo | Limitada em campos pequenos e interfaces pulmão/tecido | Superior, especialmente com kernels anisotrópicos |

| Campos modulados (IMRT) | Possível com extensão 2D (pencil scatter) | Naturalmente compatível via mapas de fluência 2D |

| Velocidade computacional | Rápido (tabelas + somatórios) | Mais lento (convolução 3D); acelerável com FFT |

| Uso clínico atual | Amplamente substituído, exceto sistemas legados | Base dos algoritmos comerciais modernos (CCC, AAA, Pinnacle) |

Tabela comparativa baseada no Handbook of Radiotherapy Physics, 2nd Ed.

Aplicação Clínica do Clarkson Modificado: Verificação Independente de Unidades Monitoras

Embora os métodos de separação primário-espalhamento tenham sido amplamente substituídos nos TPS modernos, o algoritmo de Clarkson Modificado mantém um papel clínico fundamental: a verificação independente do cálculo de unidades monitoras (UM). Programas de garantia de qualidade em radioterapia exigem que o cálculo de UM gerado pelo TPS seja conferido por um segundo método, preferencialmente baseado em algoritmo e dados independentes. A velocidade computacional e a base física bem compreendida do Clarkson Modificado tornam-no ideal para essa função de dupla verificação.

O software RTConnect, desenvolvido pela RT Medical Systems, utiliza exatamente essa abordagem: implementa o algoritmo de Clarkson Modificado para realizar a verificação independente de UM em campos conformados 3D e técnicas baseadas em MLC. O cálculo considera a separação primário-espalhamento com SARs equivalentes, correções de bandeja, filtro de cunha e fatores off-axis, fornecendo uma conferência rápida e confiável que complementa o resultado do TPS principal. Essa metodologia de verificação baseada em Clarkson está bem documentada na literatura, conforme descrito no artigo técnico publicado no repositório do IAEA sobre verificação de UM por método de Clarkson.

Na prática clínica, o uso de um sistema de dupla verificação independente como o RTConnect não é apenas uma boa prática — é um requisito de programas de acreditação e auditorias de qualidade. A discrepância entre o cálculo do TPS e a verificação independente serve como indicador de possíveis erros de entrada de dados, configuração do plano ou limitações algorítmicas em condições específicas.

Os métodos de separação primário-espalhamento foram historicamente importantes e ainda oferecem resultados aceitáveis em meios tipo água para campos regulares. Mas a demanda por precisão em heterogeneidades, campos pequenos e IMRT empurrou o estado da arte para a convolução/superposição de kernels — que, por sua vez, abriu caminho para os algoritmos comerciais como o Collapsed Cone Convolution (CCC) e o Monte Carlo clínico.

A transição do Clarkson para a convolução não foi apenas uma mudança de método; foi uma mudança de paradigma. O Clarkson opera sobre dados empíricos tabulados — TARs, SARs, perfis medidos. A convolução opera sobre grandezas físicas fundamentais — fluência, TERMA, kernels derivados de primeiros princípios via Monte Carlo. Essa base física torna os métodos de convolução/superposição intrinsecamente mais generalizáveis e confiáveis fora das condições de calibração.

Para um aprofundamento nos kernels de deposição e no algoritmo Collapsed Cone Convolution especificamente, acompanhe os próximos artigos desta série. Se você trabalha com planejamento de tratamento e recomendações DVH, a compreensão desses fundamentos é indispensável para avaliar criticamente os resultados do seu TPS.