O algoritmo pencil beam, o Fast Pencil Beam e o AAA (Analytical Anisotropic Algorithm) dominam os sistemas de planejamento comerciais há décadas. Enquanto o pencil beam decompõe o feixe em lápis estreitos e os convolui com a fluência incidente, o Fast Pencil Beam sacrifica parte dessa precisão em troca de velocidade computacional dramática nos loops de otimização. O AAA evolui o conceito original ao tratar separadamente componentes longitudinais e laterais com escalamento anisotrópico por densidade. Este artigo analisa em profundidade os três métodos — dos fundamentos matemáticos às limitações clínicas em meios heterogêneos — com base no Handbook of Radiotherapy Physics (2nd Ed., CRC Press).

Neste Artigo

- 1. Princípio do Pencil Beam para Fótons

- 2. Determinação dos Kernels

- 3. Implementações Práticas no TPS

- 4. Limitações em Meios Heterogêneos

- 5. Fast Pencil Beam: Velocidade para Otimização

- 6. O AAA no Eclipse: Evolução do Pencil Beam

- 7. Desempenho e Limitações do AAA

- 8. Pencil Beam para Elétrons: Modelo Fermi–Eyges

- 9. Pencil Beam para Prótons

- 10. Comparação entre Algoritmos Comerciais

Princípio do Pencil Beam para Fótons

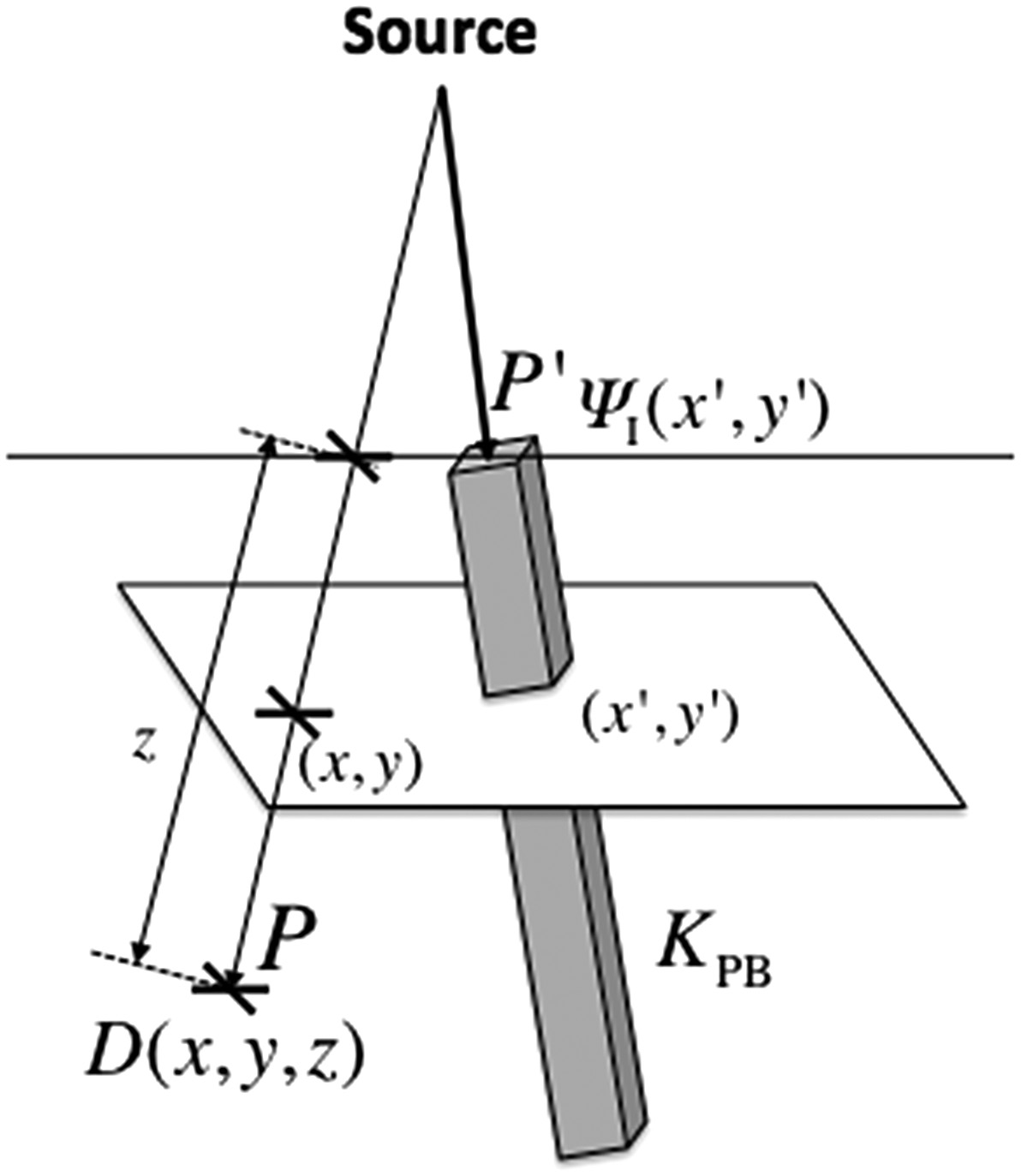

A ideia central do pencil beam é intuitiva: decompor o feixe clínico em um conjunto de feixes elementares estreitos (“lápis”) e somar suas contribuições de dose em cada ponto de cálculo. A dose no ponto $P(x,y,z)$ resulta da integração sobre a área do campo dos kernels pencil beam $K_{PB}$ ponderados pela fluência energética primária incidente $\Psi_I$:

$$D(x,y,z) = \iint \frac{\mu}{\rho} \Psi_I(x’,y’) \, K_{PB}(x-x’, y-y’, z) \, dx’ \, dy’ \quad (28.32)$$

Onde:

- $\Psi_I(x’,y’)$ é a fluência energética incidente em $P’$ (J m⁻²)

- $\mu/\rho$ é o coeficiente de atenuação mássico (m² kg⁻¹) no meio em $P’$

- $(\mu/\rho)\Psi_I(x’,y’)$ é a TERMA — energia total liberada por unidade de massa (J kg⁻¹ ou Gy)

- $K_{PB}(x-x’, y-y’, z)$ é o kernel pencil beam, representando a fração de energia depositada por unidade de massa no ponto $P$ devido à fluência primária entrando pelo ponto $P’$

A diferença fundamental entre o pencil beam e a separação primário-espalhamento (método de Clarkson) é que no pencil beam o “lápis” carrega toda a energia depositada a distância — tanto por elétrons secundários quanto por fótons espalhados. No método de superposição com Clarkson, apenas o componente de espalhamento é integrado sobre a área do campo.

Essa abordagem torna o pencil beam naturalmente adequado para modelar variações na intensidade incidente — causadas por filtros, compensadores ou modulação dinâmica de intensidade (IMRT). Além disso, variações espectrais fora do eixo podem, em princípio, ser consideradas ao alterar a qualidade do pencil beam conforme a posição de entrada.

Determinação dos Kernels Pencil Beam

O kernel pencil beam é o coração do método. Existem diversas abordagens para obtê-lo, e a escolha impacta diretamente a precisão clínica do algoritmo.

Kernels por Monte Carlo direto

Mohan e Chui (1987) realizaram cálculos Monte Carlo diretos usando o código EGS4 para gerar kernels pencil beam monoenergéticos e polienergéticos para feixes de cobalto-60, 6 MV e 18 MV. Kernels polienergéticos podem ser computados pela soma ponderada de kernels monoenergéticos, com pesos definidos pelo espectro local de raios X. Os autores demonstraram que o método dependia apenas de princípios físicos fundamentais, sem recorrer a hipóteses empíricas ou funções analíticas arbitrárias para descrever a distribuição da fonte.

Modelo analítico de Ahnesjö

Ahnesjö et al. (1992b) apresentaram um modelo pencil beam completo para uso clínico, empregando kernels polienergéticos obtidos pela convolução em profundidade de kernels pontuais de deposição de energia derivados por Monte Carlo. Esses kernels puderam ser representados analiticamente com alta precisão por uma soma de duas exponenciais sobre o raio:

$$K_{PB}(r,z) = \frac{A_z \, e^{-a_z r}}{r} + \frac{B_z \, e^{-b_z r}}{r} \quad (28.33)$$

Onde $r$ é o raio cilíndrico a partir do eixo do pencil beam, e $A_z$, $a_z$, $B_z$, $b_z$ são parâmetros de ajuste que dependem da profundidade $z$. O denominador $r$ (ao invés de $r^2$ como nos kernels pontuais) compensa a dispersão geométrica a partir de uma fonte linear infinita.

Para todos os componentes de dose exceto espalhamento de fótons, o modelo de Ahnesjö corrige heterogeneidades por escalamento em profundidade — usando os parâmetros do pencil beam na profundidade radiológica equivalente em água. Para o componente de espalhamento, usa-se a profundidade geométrica seguida de um fator de correção específico.

Outras abordagens

Métodos alternativos incluem integração em profundidade de kernels pontuais pré-calculados (Seção 28.5.3.1 do Handbook), deconvolução a partir de medidas de feixe largo (Chui e Mohan, 1988) e estimativa experimental via diferenciação de fatores de espalhamento (Ceberg et al., 1996; Storchi e Woudstra, 1996).

Implementações Práticas no TPS

Em meio homogêneo, os kernels pencil beam podem ser considerados invariantes com a posição, transformando a Equação 28.32 em uma convolução verdadeira. Nesse caso, a transformada rápida de Fourier (FFT) acelera enormemente o cálculo — estratégia explorada com sucesso por Boyer (1984) e Mohan e Chui (1987).

Mohan e Chui demonstraram o poder do método pencil beam na predição de distribuições de dose para campos irregulares em meio uniforme com superfície plana. Para um feixe de 15 MV, eles negligenciaram variações espectrais fora do eixo (assumindo kernel invariante com a posição), mas obtiveram excelente concordância com medições graças ao transporte automático de fótons espalhados e elétrons secundários embutido nos pencil beams gerados por Monte Carlo.

Bortfeld et al. (1993) otimizaram a eficiência decompondo o kernel pencil beam em três termos separados, reduzindo o número de convoluções 2D necessárias, e empregando a transformada rápida de Hartley. Para o feixe de 15 MV, obtiveram concordância excelente com medições em campos irregulares em água.

Storchi e Woudstra (1996) desenvolveram um modelo com parametrização baseada em dados experimentais limitados, introduzindo kernels tanto de espalhamento quanto de borda. A comparação com medidas mostrou desvios inferiores a 2% para campos retangulares e irregulares, com ou sem filtros, exceto para cunhas de 45° ou sob blocos, onde chegou a 4–5%. Esse algoritmo foi incorporado ao TPS Cadplan (Dosetek–Varian) e migrou posteriormente para o Eclipse (Varian).

Limitações do Pencil Beam em Meios Heterogêneos

Bortfeld et al. (1993) já alertavam: alta precisão com o pencil beam só é atingível, em princípio, para fantomas homogêneos com superfícies planas. Mohan e Chui (1987) fizeram a mesma ressalva, e Ahnesjö et al. (1992b) não reivindicaram desempenho exagerado de seu modelo em situações heterogêneas.

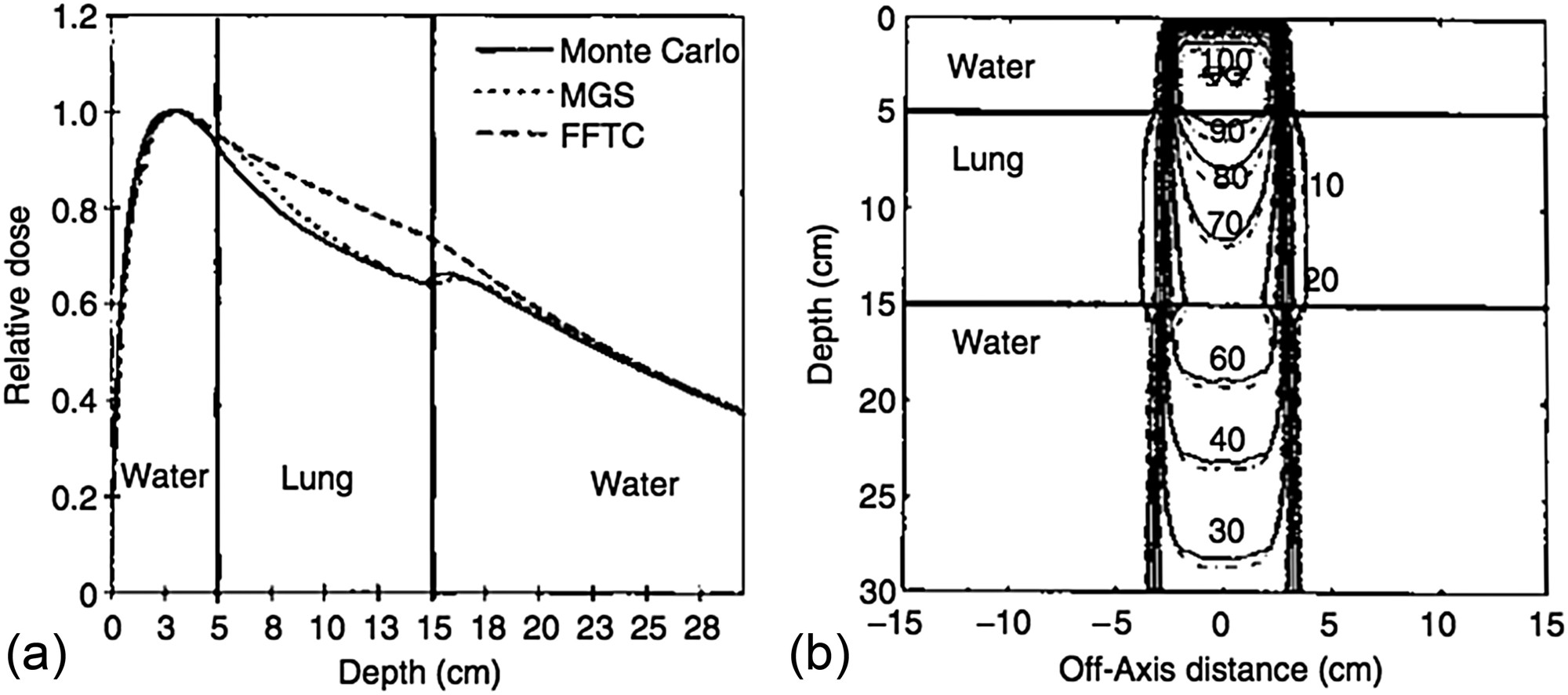

Knöös et al. (1995) fizeram um estudo detalhado das limitações na presença de tecido pulmonar, comparando o modelo pencil beam do sistema Helax-TMS com cálculos Monte Carlo na geometria desafiadora do mediastino. Os desvios em volumes de baixa densidade aumentaram com a energia do feixe: cerca de 3% a 4 MV, chegando a 14% a 18 MV — resultado atribuído ao desequilíbrio eletrônico. Outros estudos confirmaram essa tendência (Vanderstraeten et al., 2006).

A magnitude dessas limitações é similar à encontrada em modelos “convencionais” de correção de heterogeneidade (como o método de Batho ou ETAR, descritos no artigo sobre métodos empíricos). Por essa razão, o pencil beam convencional é classificado como algoritmo tipo ‘a’ — ou seja, não contabiliza adequadamente o transporte de elétrons secundários. Seu uso não é recomendado para planejamento em regiões torácicas onde o desequilíbrio eletrônico é clinicamente significativo.

Apesar dessa limitação, o pencil beam permanece como opção em muitos sistemas comerciais por representar um compromisso aceitável entre velocidade e precisão na maioria das situações clínicas, e por ser particularmente adequado para técnicas de modulação de intensidade, incluindo planejamento inverso.

Fast Pencil Beam: Velocidade para Otimização em Tempo Real

O Fast Pencil Beam é uma variante simplificada e acelerada do algoritmo pencil beam convolutivo, projetada especificamente para fornecer estimativas de dose em tempo real durante os loops iterativos de otimização inversa de IMRT e VMAT. Enquanto o pencil beam convencional já oferece velocidade razoável, as centenas ou milhares de iterações necessárias no planejamento inverso exigem um motor de cálculo ainda mais rápido — e é exatamente esse nicho que o Fast Pencil Beam ocupa.

Princípio de funcionamento

A estratégia central do Fast Pencil Beam consiste em pré-computar tabelas de consulta (lookup tables) que armazenam valores de dose por unidade de fluência para cada combinação relevante de profundidade, distância lateral e tamanho de campo equivalente. Durante a otimização, em vez de executar a integral de convolução completa da Equação 28.32, o algoritmo interpola diretamente nesses dados tabulados. Os kernels de espalhamento são substituídos por modelos simplificados — frequentemente gaussianas de largura fixa ou polinômios de baixa ordem — que sacrificam a fidelidade do transporte lateral em troca de uma redução drástica no tempo de computação.

Além das lookup tables, implementações típicas empregam técnicas adicionais de aceleração: amostragem esparsa do grid de cálculo (com interpolação nos pontos intermediários), truncamento dos kernels em distâncias laterais onde a contribuição é desprezível, e representação da fluência modulada em resolução reduzida. O resultado é um algoritmo capaz de calcular uma distribuição de dose completa em frações de segundo — viabilizando a convergência do otimizador inverso em minutos ao invés de horas.

Papel no fluxo de trabalho clínico

Na prática clínica, o Fast Pencil Beam não é utilizado como algoritmo de cálculo de dose final. Seu papel é restrito ao engine de otimização: a cada iteração do planejamento inverso, o otimizador avalia centenas de possíveis configurações de fluência e precisa de uma resposta rápida sobre a dose resultante. Nesse contexto, uma estimativa com precisão de 2–5% é suficiente para guiar a convergência do algoritmo.

Uma vez que o otimizador converge para uma solução de fluência ótima, o cálculo de dose final é realizado com um algoritmo de maior fidelidade — tipicamente o AAA, o Collapsed Cone Convolution (CCC) ou, em sistemas mais modernos, Monte Carlo ou soluções determinísticas como o Acuros XB. Essa abordagem em dois estágios — otimização rápida seguida de cálculo final preciso — é o padrão de fato nos sistemas de planejamento contemporâneos.

Comparação com o pencil beam convencional

As diferenças entre o Fast Pencil Beam e o pencil beam convencional não são de natureza conceitual, mas sim de implementação. Ambos se baseiam na decomposição do feixe em lápis elementares; a versão “fast”, porém, troca kernels fisicamente detalhados por aproximações tabuladas. Em meio homogêneo, as discrepâncias entre os dois são geralmente inferiores a 2–3%. Em meios heterogêneos — particularmente em interfaces pulmão-tecido mole e em regiões de build-up —, o Fast Pencil Beam apresenta desvios maiores que o pencil beam convencional, já que as simplificações nos kernels reduzem ainda mais a capacidade de modelar o desequilíbrio eletrônico.

Essa perda de precisão é clinicamente aceitável durante a otimização porque o objetivo nessa fase não é obter a dose final, mas sim encontrar o mapa de fluência que melhor satisfaz as restrições clínicas. A dose “real” só é avaliada após a conversão da fluência otimizada em segmentos de MLC e o recálculo com o algoritmo de referência.

Exemplos comerciais

O exemplo mais proeminente é o sistema Eclipse (Varian), que utiliza o Fast Pencil Beam como motor de dose durante a otimização de planos IMRT e VMAT, com recálculo final pelo AAA ou pelo Acuros XB. O RayStation (RaySearch) emprega abordagem similar, com um pencil beam rápido no otimizador e CCC ou Monte Carlo para o cálculo definitivo. No Pinnacle (Philips), o CCC é usado tanto na otimização quanto no cálculo final, o que resulta em tempos de otimização mais longos, mas com consistência de dose ao longo de todo o processo.

A tendência nos sistemas mais recentes é substituir o Fast Pencil Beam por motores de otimização baseados em GPU (Graphics Processing Unit), que permitem rodar algoritmos mais precisos — incluindo versões aceleradas de CCC e até Monte Carlo — em tempos compatíveis com a otimização iterativa. Ainda assim, o Fast Pencil Beam permanece em amplo uso clínico e constitui uma etapa essencial do fluxo de trabalho em milhares de centros de radioterapia.

O AAA no Eclipse: Evolução do Pencil Beam

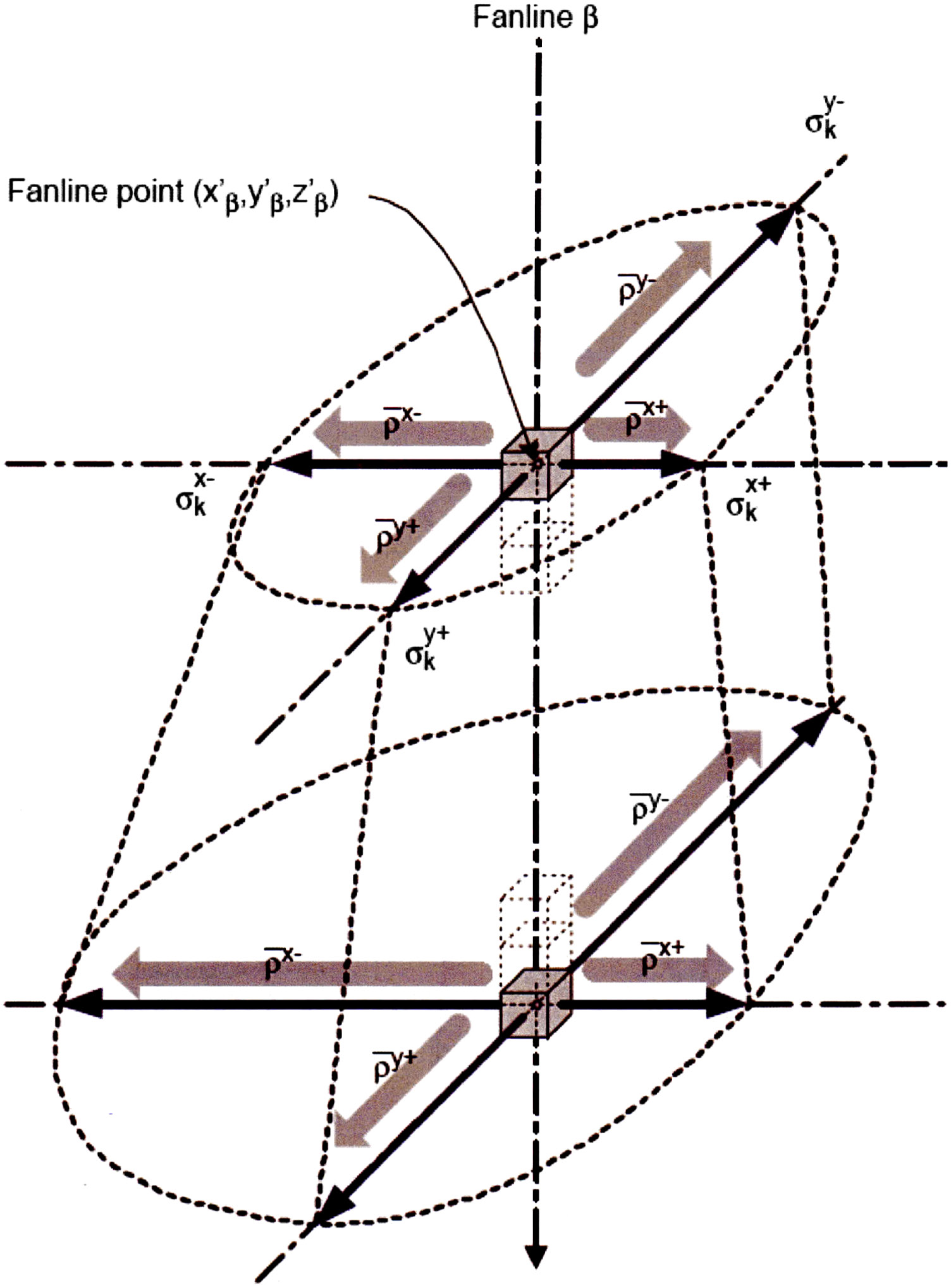

O Analytical Anisotropic Algorithm (AAA) começou a ser implementado no Eclipse (Varian) no início dos anos 2000. Essencialmente, trata-se de um algoritmo de convolução/superposição pencil beam com tratamento explícito e separado dos componentes longitudinais e laterais, escalados conforme a densidade do meio.

A dose total resulta da soma das contribuições de beamlets $\beta$ cobrindo toda a área do campo, cada um com seção transversal aproximadamente igual ao tamanho do voxel do paciente. Em meio aquoso, a expressão para a contribuição de dose no ponto $P(x,y,z)$ de um beamlet individual $\beta$ na posição $(x’,y’)$ é:

$$D_\beta(x,y,z) = I_\beta(z) \iint F_0(x’,y’) \, K_\beta(x-x’, y-y’, z) \, dx’ \, dy’ \quad (28.34)$$

Onde:

- $I_\beta(z)$ é a função polienergética de deposição de energia dos fótons primários na profundidade $z$

- $F_0(x’,y’)$ é a fluência primária incidente, assumida uniforme sobre a seção do beamlet

- $K_\beta(x-x’, y-y’, z)$ é o kernel de espalhamento que contabiliza a contribuição no ponto $P$ dos fótons espalhados pelo beamlet $(x’,y’)$

A diferença crucial em relação à Equação 28.32 é que no AAA a deposição primária de energia ($I_\beta$) é tratada separadamente — não está incluída no kernel de espalhamento. Tanto $I_\beta$ quanto $K_\beta$ derivam de cálculos Monte Carlo para espectros típicos de aceleradores lineares e são convertidos por deconvolução em expressões analíticas adaptadas aos dados medidos.

O kernel de espalhamento polienergético $K_\beta$ foi inicialmente representado pela soma ponderada de três perfis gaussianos com desvios-padrão $\sigma_{k=0,1,2}(z)$ para espalhamento de curto, médio e longo alcance. Em versões posteriores (Tillikainen et al., 2007), passou a ser representado pela soma de seis funções exponenciais radiais:

$$K_\beta(r,z) = \sum_{k=1}^{6} c_k \, \frac{1}{r} \, e^{-\mu_k r} \quad (28.35)$$

Onde $r$ é a distância ao eixo central do beamlet, $\mu_k$ é o coeficiente de atenuação que define o alcance do componente de espalhamento $k$, e $c_k$ é o peso relativo de cada componente. Embora as publicações originais da Varian atribuam o componente de curto alcance ao espalhamento de fótons, autores como Knöös et al. (2006) sugerem que ele está relacionado à deposição lateral de energia por elétrons secundários.

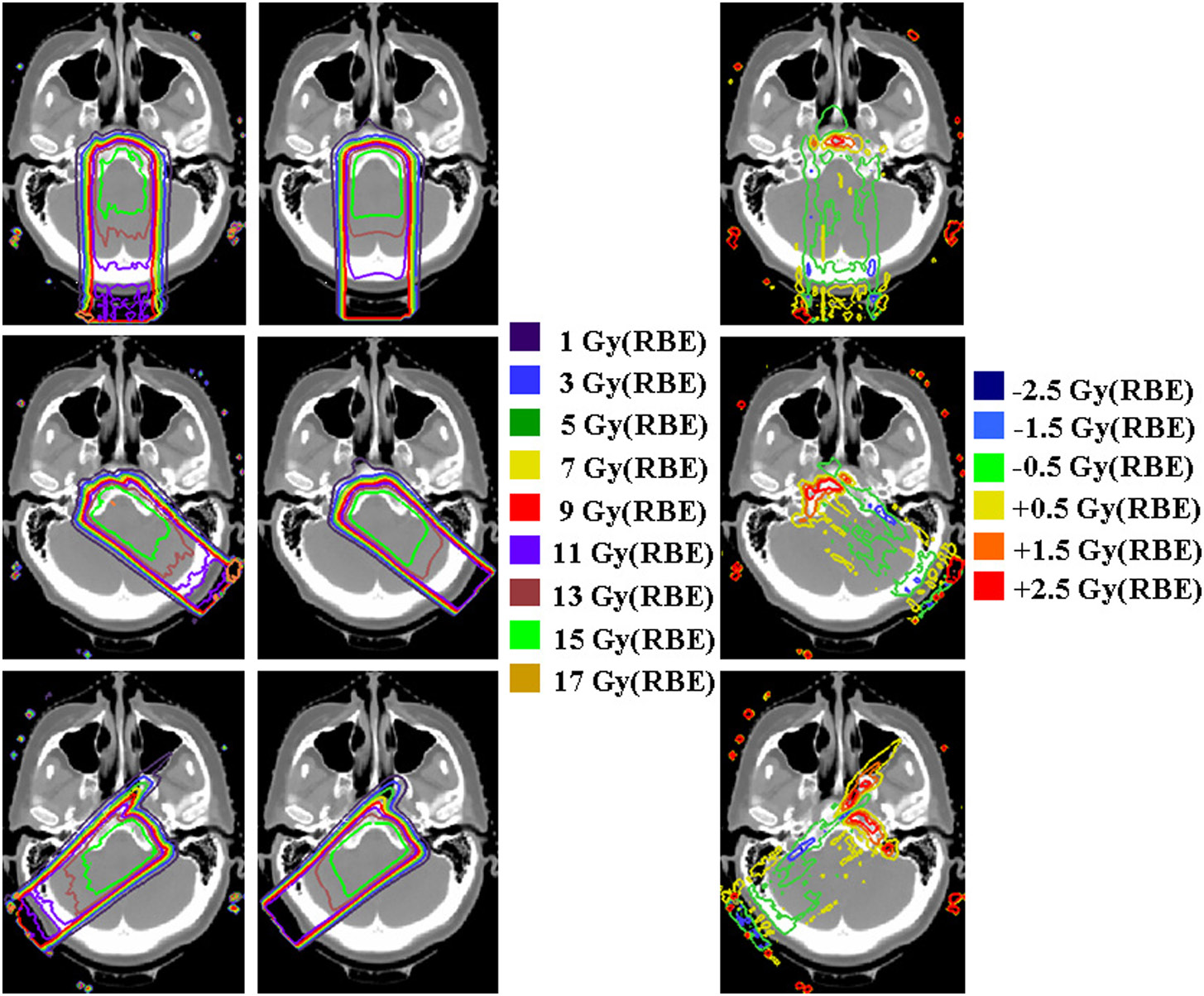

Em meio heterogêneo, os componentes primário e de espalhamento são ponderados pela densidade relativa local e escalados lateralmente usando o caminho equivalente em água no meio. Uma abordagem recursiva preserva o “histórico” desse escalamento conforme a profundidade aumenta. O componente primário também é escalado em profundidade. Cálculos similares são realizados para o bremsstrahlung do alvo e para o componente extrafocal, além da contaminação eletrônica.

Desempenho e Limitações do AAA

Comparado ao pencil beam convencional que o precedeu no Eclipse, o AAA representou uma melhora significativa na precisão do cálculo de dose em heterogeneidades. Ele pode ser considerado um algoritmo tipo ‘b’ — ou seja, contabiliza (de forma aproximada) o transporte de elétrons secundários (Knöös et al., 2006; Van Esch et al., 2006).

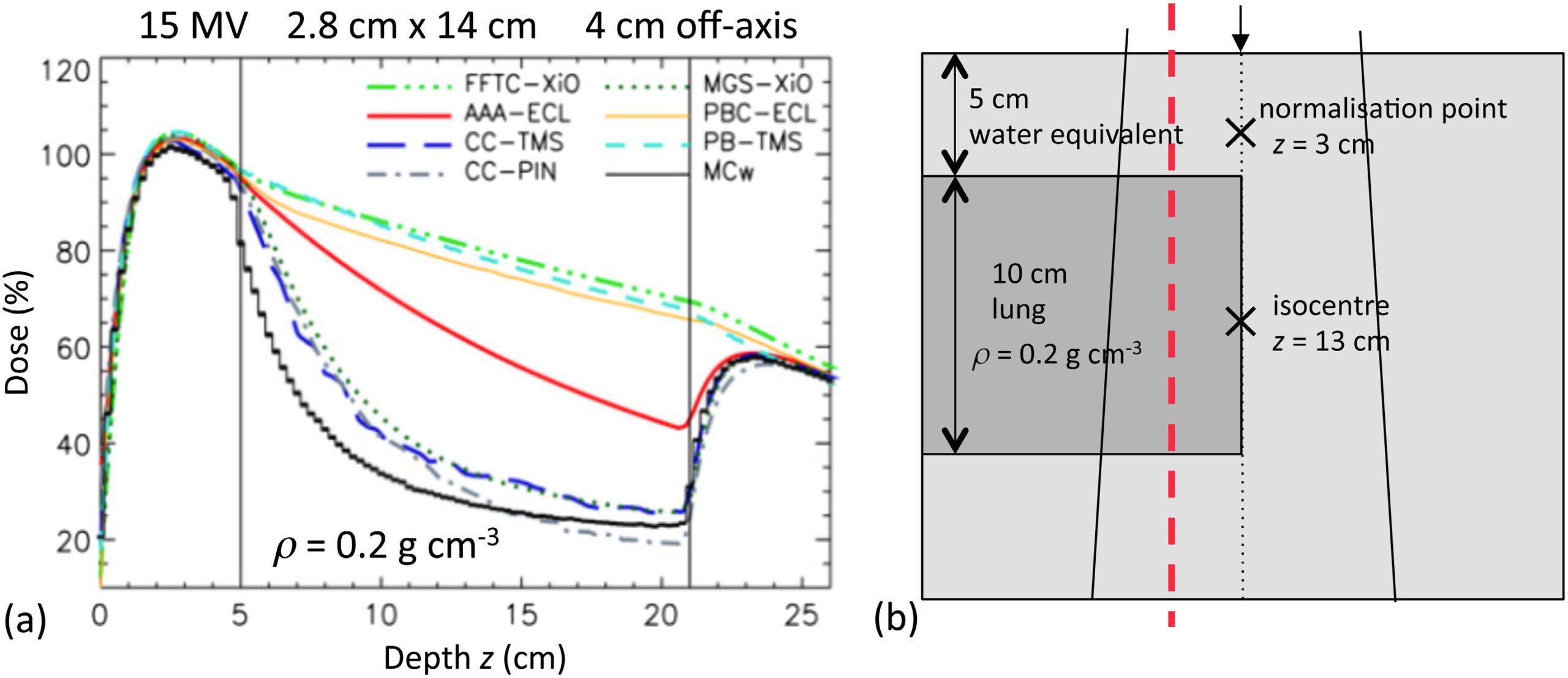

No entanto, seu princípio é menos direto que o dos algoritmos de convolução/superposição com kernel pontual. O tratamento do transporte eletrônico não é explícito — utiliza-se um espalhamento lateral ao invés do espalhamento direcionado dos kernels pontuais. Essa pode ser a causa da superestimação aparente da dose dentro e abaixo de heterogeneidades de baixa densidade para campos pequenos em feixes de alta energia (Fogliata et al., 2007; Ding et al., 2006, 2007; Robinson, 2008; Dunn et al., 2015).

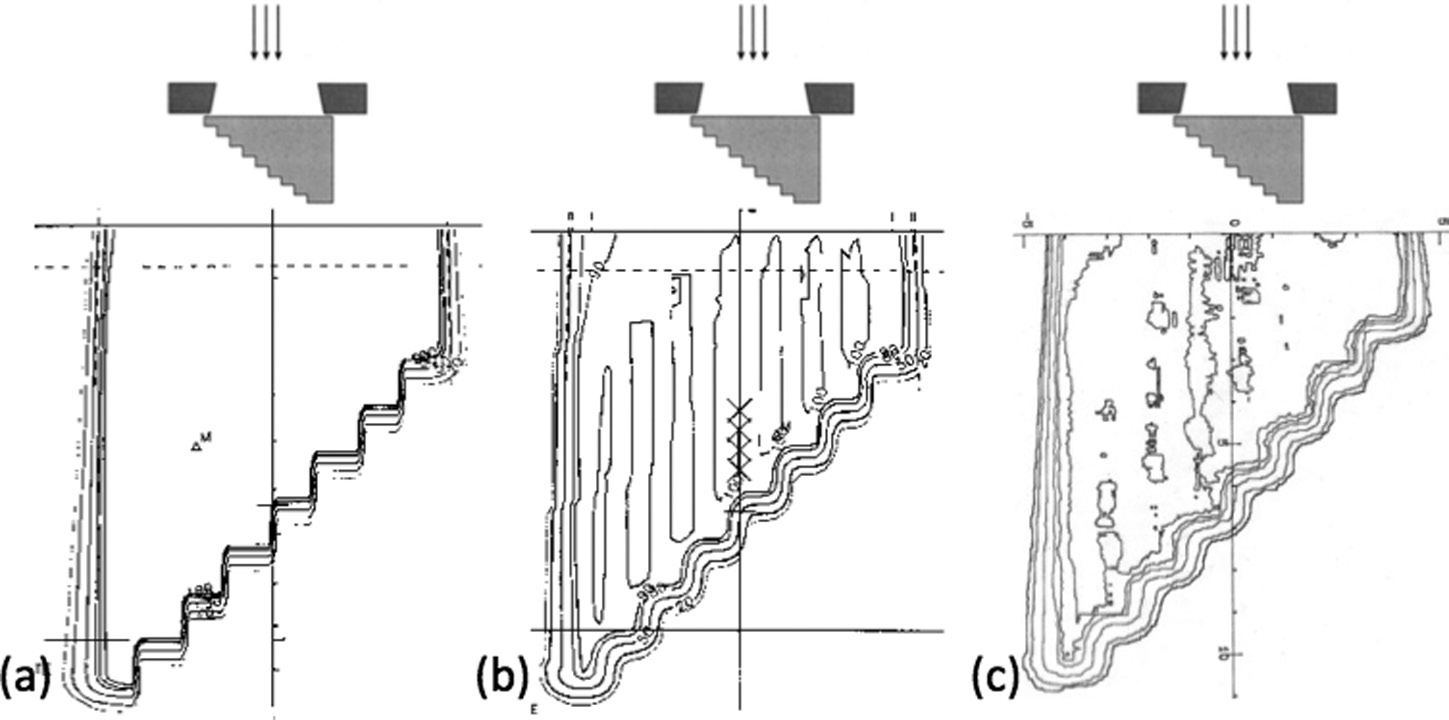

A Figura 28.21 ilustra bem o problema: para um feixe de 15 MV com campo de 2,8 cm × 14 cm atravessando 10 cm de pulmão equivalente ($\rho = 0,2$ g/cm³), os algoritmos tipo ‘a’ (FFTC-XiO, PB-TMS, PBC-ECL) não “enxergam” a falta de equilíbrio eletrônico no pulmão. Os algoritmos de convolução/superposição tipo ‘b’ (MGS-XiO, CC-TMS, CC-PIN) concordam com a simulação Monte Carlo. O AAA (AAA-ECL) fica numa posição intermediária entre os dois grupos.

Essa questão exige consideração cuidadosa quando se migra do AAA para um algoritmo mais preciso (CCC ou model-based), especialmente em lesões torácicas — tumores de pulmão, metástases pulmonares ou espinhais, tumores de esôfago. Como o algoritmo mais avançado demonstraria a dose tumoral real mais baixa por unidade monitora nas bordas do feixe, o número calculado de MUs seria maior para atingir a mesma dose tumoral média, resultando em dose global entregue mais alta (Fogliata et al., 2012; Rana et al., 2013; Zhen et al., 2015). Para aprofundar essa discussão, consulte o guia completo sobre algoritmos de cálculo de dose por fótons.

Apesar dessa limitação, o AAA tem a vantagem de ser 4 a 10 vezes mais rápido que um algoritmo típico de kernel pontual CCC (Hasenbalg et al., 2007; Han et al., 2011). Na maioria das situações, compete favoravelmente com o CCC. Para casos onde é menos preciso, a alternativa disponível na plataforma Eclipse é o algoritmo model-based Acuros XB, baseado na solução determinística da equação de transporte de Boltzmann.

Pencil Beam para Elétrons: O Modelo Fermi–Eyges

O conceito de pencil beam aplica-se também a partículas carregadas, mas a física subjacente muda radicalmente. Diferente dos fótons, os elétrons interagem “imediatamente” e “continuamente” ao entrar no meio — a fluência primária converte-se em fluência espalhada quase instantaneamente. Não faz sentido falar em kernels de dose pontual para elétrons da mesma forma que para fótons.

O modelo de Hogstrom et al. (1981), baseado na teoria de Fermi–Eyges, dominou o cálculo de dose para elétrons desde o início dos anos 1980. A solução analítica da equação de transporte de partículas carregadas na aproximação de pequenos ângulos (Fermi), estendida por Eyges (1948) para meios heterogêneos, fornece a probabilidade de encontrar o elétron na profundidade $z$ com deslocamento lateral $(x,y)$:

$$p(x,y,z) \, dx \, dy = \frac{1}{2\pi \sigma_{MCS}^2} \exp\left(-\frac{x^2 + y^2}{2\sigma_{MCS}^2}\right) dx \, dy \quad (29.1)$$

Onde $\sigma_{MCS}^2$ é o espalhamento coulombiano múltiplo acumulado:

$$\sigma_{MCS}^2 = \frac{1}{2} \int_0^z (z-u)^2 \, T(u) \, du \quad (29.2)$$

e $T(u)$ é o poder de espalhamento linear do meio na profundidade $u$, avaliado na energia média dos elétrons naquela profundidade.

Para um campo de tamanho $2A \times 2B$ com intensidade uniforme, a fluência eletrônica no ponto $(x,y,z)$ resulta da integração sobre a área do campo:

$$N(x,y,z) = \frac{1}{4} \left[\text{erf}\left(\frac{A-x}{\sqrt{2}\sigma_{MCS}}\right) + \text{erf}\left(\frac{A+x}{\sqrt{2}\sigma_{MCS}}\right)\right] \times \left[\text{erf}\left(\frac{B-y}{\sqrt{2}\sigma_{MCS}}\right) + \text{erf}\left(\frac{B+y}{\sqrt{2}\sigma_{MCS}}\right)\right] \quad (29.6)$$

Quando $x$ e $y$ estão mais de ~$3\sigma_{MCS}$ das bordas do campo, $N(x,y,z) = 1$ — o perfil de dose é plano longe das bordas, como esperado. Porém, essa expressão é constante com a profundidade, o que significa que o aumento inicial da fluência eletrônica com a profundidade (devido ao espalhamento múltiplo) não é predito. Um fator de ponderação empírico $g(z)$ é necessário para converter a distribuição de fluência planar em distribuição de dose que reproduza medidas de dose em profundidade.

Limitações críticas do modelo Fermi–Eyges

A limitação mais séria é a aproximação do raio central. Cada pencil individual é corrigido para heterogeneidades calculando $\sigma_{MCS}(z)$ apenas ao longo do raio central daquele pencil — o equivalente a assumir que todos os pencils incidem num fantoma em camadas. Em profundidades onde o pencil já se espalhou significativamente, heterogeneidades estreitas perpendiculares à direção do feixe não serão preditas com precisão.

Outra limitação: a teoria de Fermi–Eyges prediz que $\sigma_{MCS}(z)$ cresce continuamente com a profundidade, mas o comportamento real mostra um máximo seguido de diminuição, causada pela redução significativa do número de elétrons em grandes profundidades devido ao straggling de alcance. Tentativas de incorporar essa “perda de elétrons” foram feitas por Bruinvis et al. (1989) e Jette e Walker (1992).

A forma gaussiana da distribuição é apenas uma aproximação razoável a pequenas e grandes profundidades (Brahme et al., 1981; Lax et al., 1983). O modelo de Lax, que usa três gaussianas ajustadas a pencil beams gerados por Monte Carlo, oferece concordância superior com medidas na região de penumbra. Essas limitações do modelo Fermi–Eyges foram parcialmente responsáveis pelo desenvolvimento de métodos Monte Carlo para cálculo de dose em elétrons.

Pencil Beam para Prótons e Partículas Pesadas

Feixes de prótons de alta energia se tornaram uma modalidade terapêutica importante, e os métodos de cálculo de dose em pacientes seguem princípios análogos aos de elétrons, embora com diferenças na física de transporte. O efeito de heterogeneidades é particularmente relevante: a presença de osso ou ar pode alterar significativamente o alcance e a distribuição lateral do feixe.

O método mais simples, ray tracing, traça uma linha reta entre a fonte e cada ponto de cálculo, corrigindo a profundidade pela água equivalente. Essa abordagem unidimensional só contabiliza mudanças no alcance (“overshooting” ou “undershooting”), sem prever efeitos laterais como espalhamento em bordas de heterogeneidades.

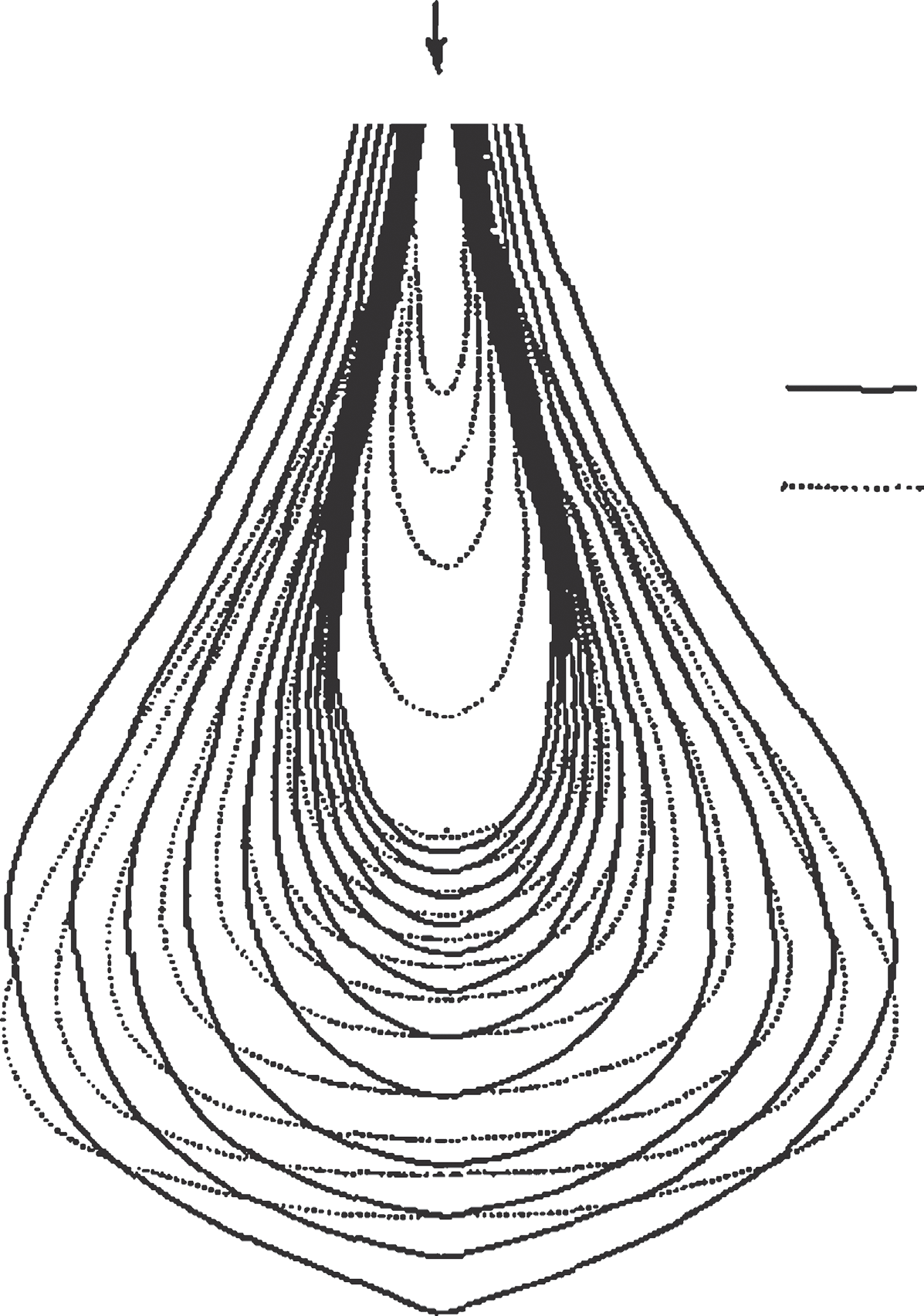

O pencil beam melhora substancialmente a modelagem ao incluir o espalhamento lateral. Como mostra a Figura 29.10, ao contrário do ray-tracing, o pencil beam captura a “degradação” do pico de Bragg causada por estruturas heterogêneas na entrada do feixe — produzindo isodoses mais suaves e realistas que concordam melhor com medidas.

Para prótons, assim como para elétrons, o pencil beam representa uma melhoria significativa sobre o ray-tracing, mas ainda sofre com a aproximação do raio central. Comparações entre Eclipse, XiO e Pinnacle para casos de meningioma (Doolan et al., 2015) demonstram diferenças clinicamente relevantes entre algoritmos, especialmente em interfaces osso-tecido mole.

Comparação entre Algoritmos Comerciais

A tabela abaixo sintetiza as características dos algoritmos discutidos neste artigo e os compara com métodos de referência (CCC e Monte Carlo), com base nos dados do Handbook of Radiotherapy Physics.

| Característica | Pencil Beam | Fast Pencil Beam | AAA | CCC | Monte Carlo |

|---|---|---|---|---|---|

| Classificação | Tipo ‘a’ | Tipo ‘a’ (simplificado) | Tipo ‘b’ (intermediário) | Tipo ‘b’ | Referência |

| Transporte e⁻ secundários | Não explícito | Não explícito | Aproximado (espalhamento lateral) | Sim (via kernels) | Sim (explícito) |

| Heterogeneidades | Escalamento em profundidade | Escalamento simplificado | Escalamento anisotrópico (recursivo) | Density scaling 3D | Transporte completo |

| Erro em pulmão (18 MV) | Até 14% | >14% (heterogeneidades críticas) | Intermediário (~5-8%) | ~2-3% | <1% (referência) |

| Velocidade relativa | Muito rápido (FFT) | Ultrarrápido (lookup tables) | Rápido | 4-10× mais lento que AAA | Muito lento |

| Uso principal | Cálculo final em casos simples | Motor de otimização inversa | Cálculo final (Eclipse) | Cálculo final (Pinnacle, XiO) | Referência / cálculo final |

| TPS comerciais | Eclipse, Helax-TMS | Eclipse (otimizador IMRT/VMAT) | Eclipse (Varian) | Pinnacle, XiO, TMS | Monaco, iPlan |

Fonte: Compilado a partir do Handbook of Radiotherapy Physics, 2nd Ed. (CRC Press, 2020)

A escolha do algoritmo depende do cenário clínico. Para planejamentos de rotina em regiões sem grandes heterogeneidades, o pencil beam ou o AAA oferecem precisão adequada com velocidade superior. O Fast Pencil Beam desempenha um papel fundamental nos bastidores da otimização inversa, mas nunca deve ser usado como cálculo de dose final. Em regiões torácicas com campos pequenos e feixes de alta energia, algoritmos tipo ‘b’ como o CCC — ou, idealmente, soluções model-based como o Acuros XB ou Monte Carlo — são fortemente recomendados.

Para uma visão completa de toda a jornada dos algoritmos de cálculo de dose — desde os métodos empíricos até Monte Carlo e Acuros — confira nosso guia completo sobre algoritmos de cálculo de dose por fótons.