Métodos empíricos de cálculo de dose — também chamados de métodos broad-beam — foram a base do planejamento radioterápico computadorizado por décadas. Antes dos algoritmos de convolução e Monte Carlo, o físico médico dependia de dados tabulados e correções semi-analíticas para estimar a dose no paciente. Este artigo explora cada técnica em detalhe: da representação tabular de Bentley-Milan às correções de heterogeneidade de Batho, ETAR e subtração de feixe.

Se você busca uma visão panorâmica de todos os algoritmos — dos empíricos ao Monte Carlo — confira nosso guia completo sobre algoritmos de cálculo de dose por fótons.

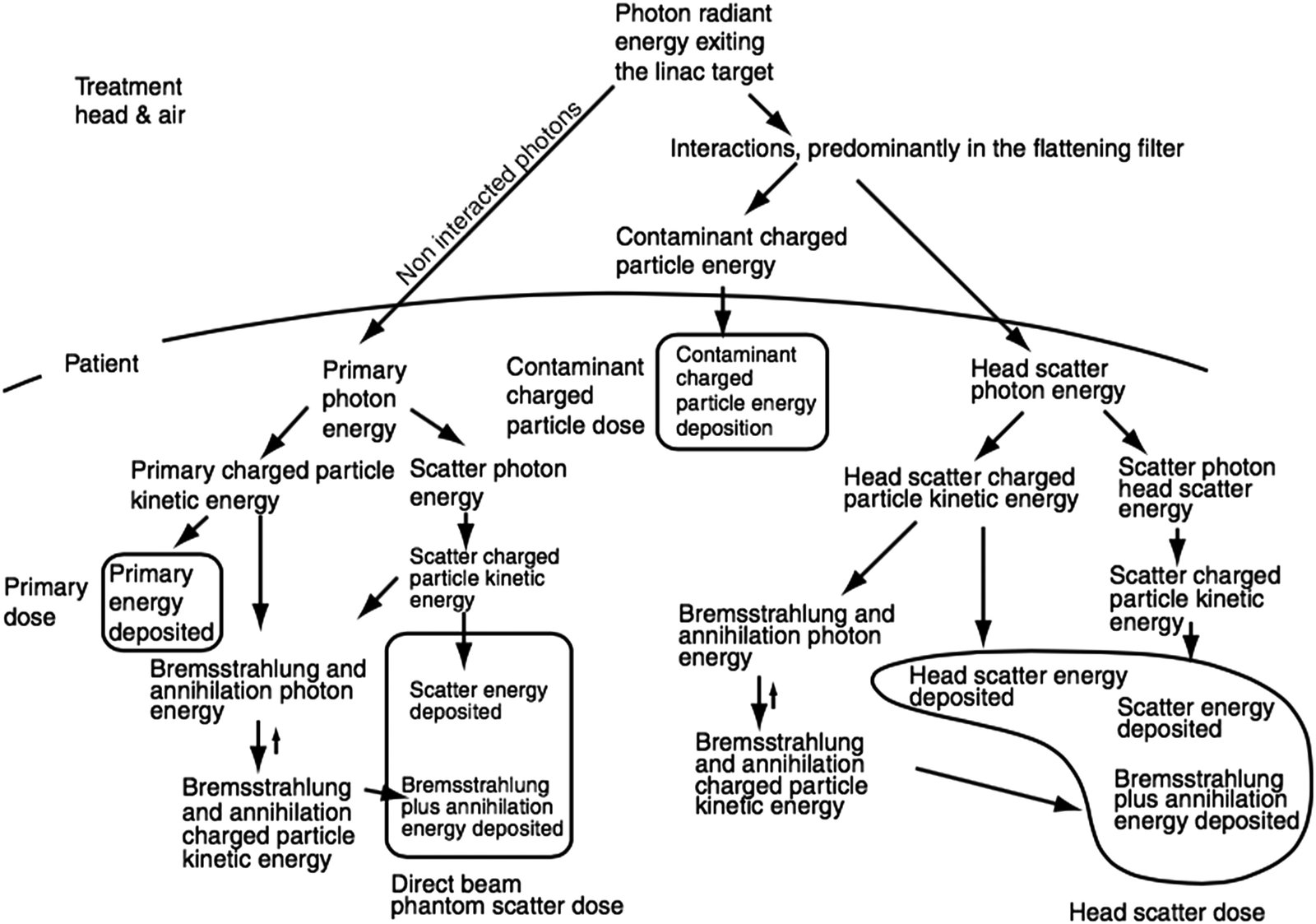

Componentes de Dose em Feixes Clínicos de Fótons

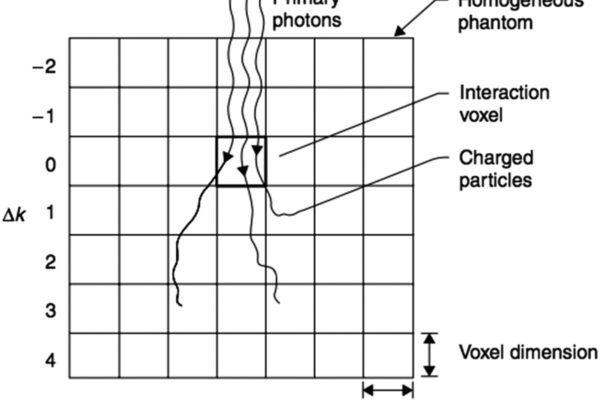

A dose total em qualquer ponto do paciente resulta de quatro componentes distintos. A dose primária, originada de fótons que não sofreram interação além do alvo, responde geralmente por mais de 70% do total. O espalhamento no fantoma (phantom scatter) contribui com até 30%, dependendo do tamanho de campo e profundidade.

Menos óbvios, mas clinicamente relevantes, o espalhamento no cabeçote (head scatter ou contribuição extrafocal) — fótons espalhados no filtro aplainador e colimador — pode chegar a 5–10% da dose total. Por fim, a contaminação por partículas carregadas, predominantemente elétrons gerados no ar e nos componentes do cabeçote, afeta principalmente a região de build-up (tipicamente os primeiros 4 cm).

Os métodos broad-beam tratam esses componentes de forma implícita, sem separá-los explicitamente. Essa simplificação é tanto sua força — rapidez computacional — quanto sua fraqueza fundamental.

Representações Tabulares: O Modelo Bentley-Milan

Na década de 1970, Bentley e Milan desenvolveram um dos primeiros sistemas digitais de planejamento. O modelo armazenava dados de feixe como curvas de dose em profundidade no eixo central e razões off-axis (OARs). Para economizar memória — requisito crítico na época — usavam-se quadrados equivalentes para reduzir campos retangulares arbitrários a dados de campos quadrados.

Cada campo quadrado tinha curvas de PDD armazenadas em apenas 17 profundidades, igualmente espaçadas a partir do $z_{max}$. A região de build-up recebia tratamento simplificado: a dose a uma profundidade $z < z_{max}$ era interpolada linearmente entre a dose na superfície e a dose máxima, usando uma profundidade modificada $z_B$:

$$z_B = z_{max} – \frac{(z_{max} – z)^3}{z_{max}^2}$$

As razões off-axis dependiam principalmente da largura in-plane do campo. Como a variação com a profundidade era lenta ao longo de linhas divergentes (fan lines), bastavam 5 profundidades de armazenamento. Na implementação original, o conjunto total de dados cabia em 255 itens — ou seja, $2^8 – 1$.

Representações Analíticas e Correções de Filtro

Uma alternativa às tabelas foram as funções analíticas. O modelo de van de Geijn (1965, 1970, 1972) separava a representação em dose no eixo central e razões off-axis, cada parte modelada por uma função matemática. Apenas sete medições bastavam para caracterizar as curvas de PDD para uma dada energia — uma economia enorme em tempo de comissionamento.

Para filtros de cunha, duas abordagens coexistiam. A primeira incluía distribuições de dose com cunha diretamente no dataset experimental. A segunda derivava um perfil de transmissão a partir de medições com e sem cunha em campo grande, tabelando-o como fator de correção. Na prática, esse perfil também podia ser calculado a partir das dimensões e composição do filtro, desde que o coeficiente de atenuação fosse verificado experimentalmente. A transmissão de cunha não se limita ao método broad-beam e foi incorporada em algoritmos mais modernos.

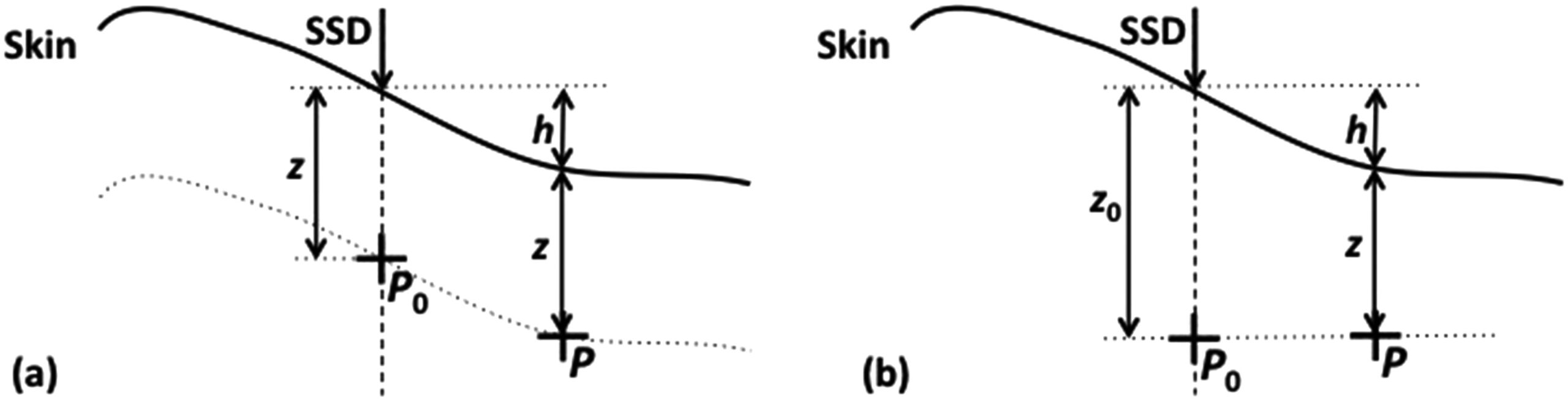

Correção para Forma do Paciente: Métodos SSD Efetivo e TPR

O corpo humano não é um bloco plano de água. Corrigir a dose para a curvatura real da superfície exige métodos dedicados.

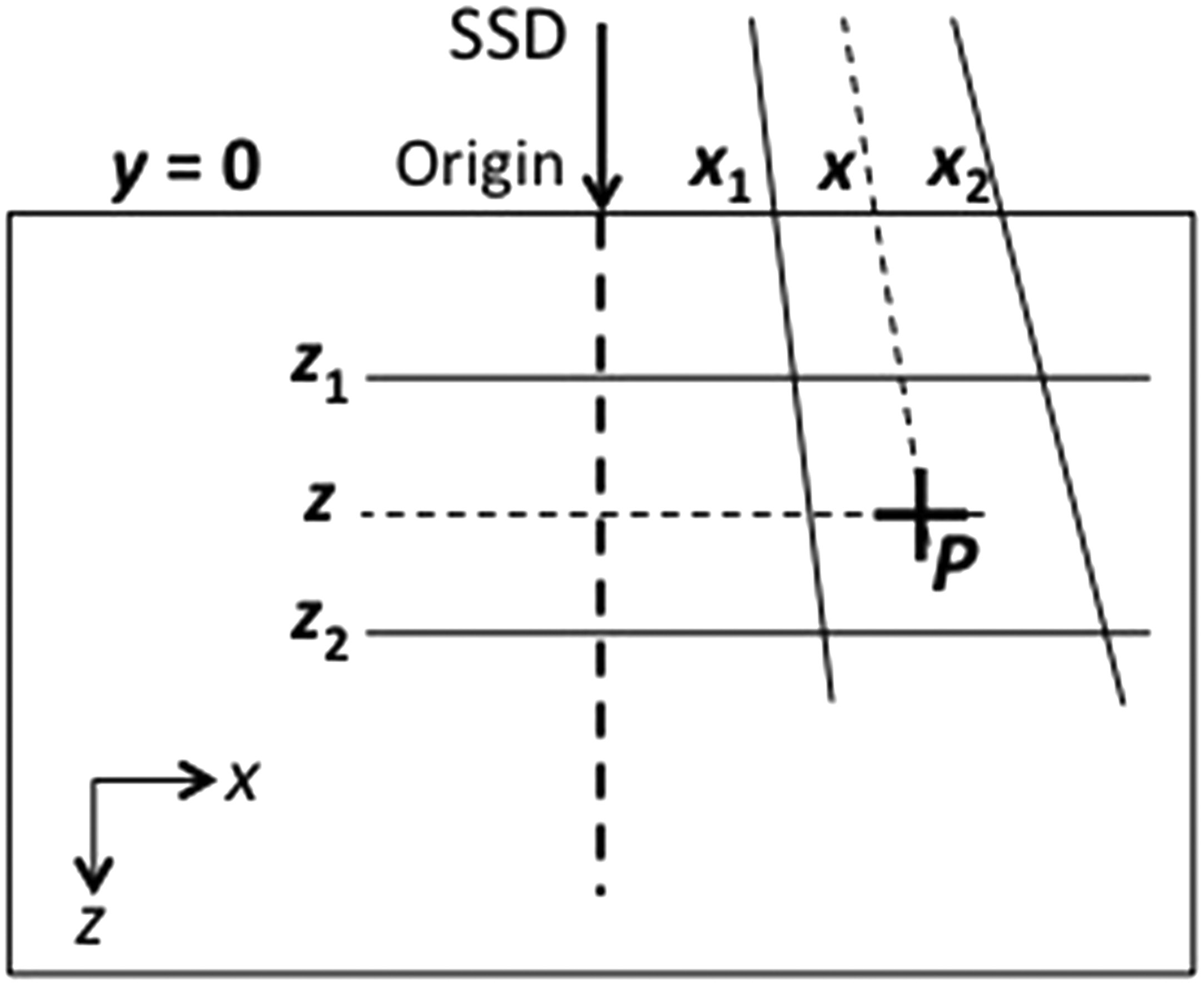

Método do SSD Efetivo

O método SSD efetivo aplica uma correção de lei do inverso do quadrado. Se a SSD no eixo central é $SSD$ e o acréscimo de distância para um ponto off-axis é $h$, o fator de correção fica:

$$C_{SSD} = \left(\frac{SSD + z}{SSD + h + z}\right)^2$$

Na prática de Bentley-Milan, os dados medidos eram primeiro convertidos para “SSD infinita” (removendo a variação com a lei do inverso do quadrado), e depois a correção geométrica era aplicada para a SSD de tratamento real.

Método da Razão TPR

Uma alternativa é o método da razão TPR. O fator de correção é a razão de dois TPRs (tissue phantom ratios), que independem da SSD:

$$C_{TPR} = \frac{TPR(z, ESQ_{z_0})}{TPR(z + h, ESQ_{z_0})}$$

Em ambos os casos, uma correção off-axis adicional deve ser aplicada para contabilizar o filtro aplainador e a cunha.

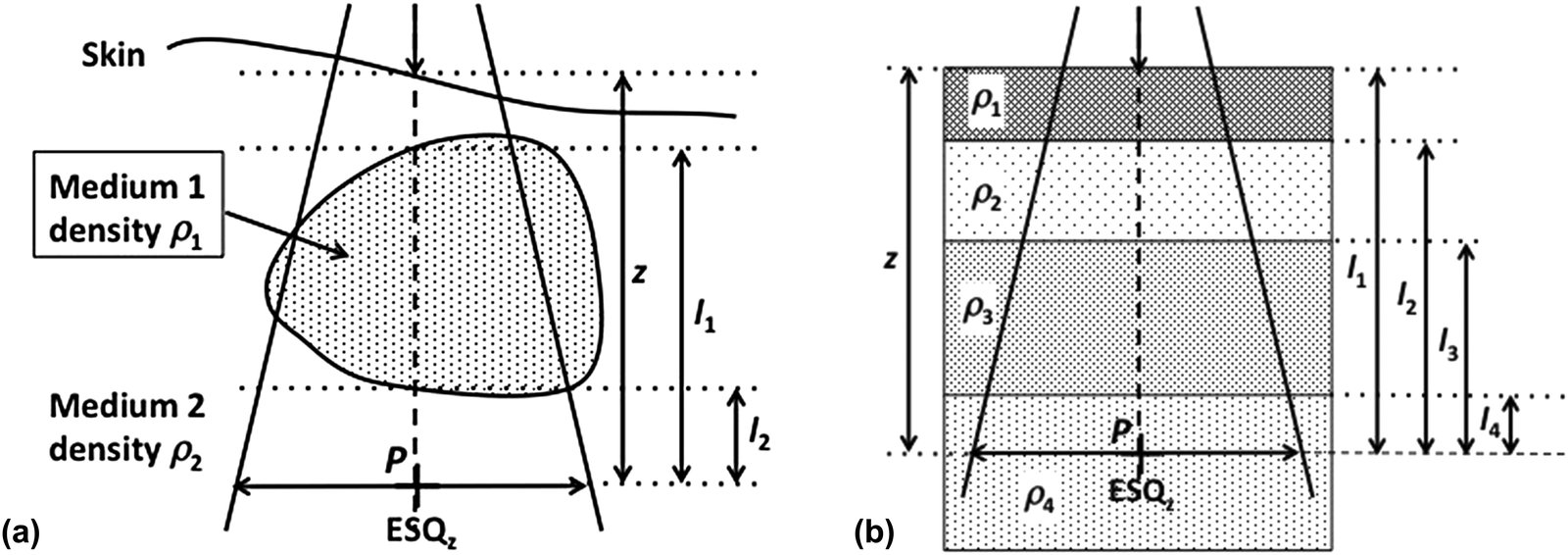

Correção para Heterogeneidades: Da Profundidade Efetiva ao Batho

A presença de pulmão, osso e ar no trajeto do feixe altera tanto a atenuação quanto o espalhamento. Os métodos broad-beam desenvolveram correções progressivamente mais sofisticadas.

Profundidade Efetiva (TAR)

O método mais simples substitui a profundidade real por uma profundidade efetiva $z_{eff}$, calculada como soma das espessuras de cada tecido ponderadas pela densidade eletrônica relativa $\rho_i$:

$$z_{eff} = \sum_{i=1}^{n} t_i \, \rho_i$$

O fator de correção usa razões de TAR (ou TPR):

$$C_{het}^{TPR} = \frac{TPR(z_{eff}, ESQ_z)}{TPR(z, ESQ_z)}$$

Trata-se de uma correção unidimensional que ignora alterações no espalhamento lateral — aceitável longe da heterogeneidade, mas insuficiente em interfaces.

Correção Power-Law de Batho

O método power-law, proposto por Batho (1964) e generalizado por Sontag e Cunningham (1977), eleva o TAR à potência da densidade relativa do meio. Para um ponto $P$ em meio de densidade $\rho_2$ abaixo de uma heterogeneidade de densidade $\rho_1$:

$$C_{het}^{Batho} = TAR(l_2, ESQ_z)^{(\rho_2 – \rho_1)} \cdot TAR(l_1, ESQ_z)^{(1 – \rho_1)}$$

Para múltiplas camadas superpostas, a generalização de Webb e Fox (1980) é:

$$C_{het}^{Batho} = \prod_{i=1}^{n} TAR(l_i, ESQ_z)^{(\rho_i – \rho_{i-1})}$$

onde $l_i$ é a distância do ponto $P$ à parte distal da $i$-ésima heterogeneidade e $\rho_0 = 1$.

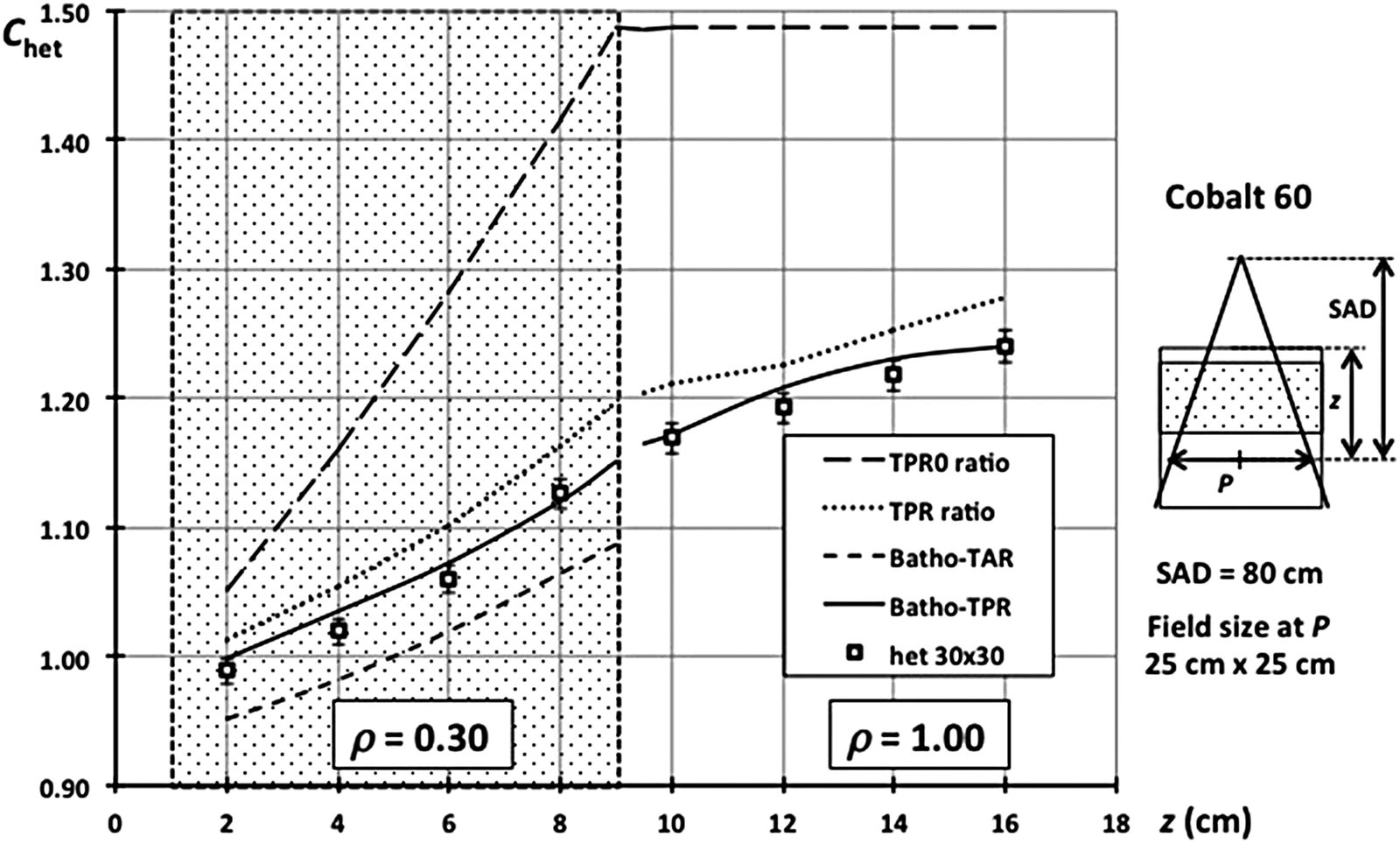

Comparação Experimental dos Métodos

A Figura 28.5 mostra resultados para uma heterogeneidade de 8 cm de espessura ($\rho = 0{,}3$) a 1 cm da superfície, em feixe de cobalto-60. O método TPR0 (apenas primário) superestima fortemente a correção. O TPR ratio completo melhora, mas ainda superestima dentro da heterogeneidade. O Batho original (baseado em TAR) funciona bem abaixo da heterogeneidade, mas subestima dentro dela. A formulação Batho-TPR, usando razão de TPRs, oferece o melhor compromisso em todas as regiões — com erros tipicamente menores que 2% em água abaixo de camadas de baixa densidade.

| Método | Dentro da heterogeneidade | Abaixo da heterogeneidade | Limitação principal |

|---|---|---|---|

| Profundidade efetiva (TAR/TPR ratio) | Superestima correção | Superestima correção | Ignora modificação do espalhamento |

| Batho original (TAR) | Subestima dose | Boa precisão (~2%) | Não contabiliza backscatter |

| Batho-TPR (modificado) | Melhor resultado | Boa precisão (~2%) | Assume geometria de camadas |

| Batho-TPR (campo zero) | Equivalente a TAR ratio | Equivalente a TAR ratio | Só válido para campo pequeno |

Fonte: Handbook of Radiotherapy Physics, 2nd Ed., Capítulo 28

Pontos críticos que o Batho não resolve: para heterogeneidades de alta densidade ($\rho > 1$), a precisão cai. Para energias altas, o equilíbrio eletrônico pode faltar — invalidando a premissa de deposição local de energia. E a aplicação multiplicativa camada a camada é frequentemente grosseira demais.

Beam Subtraction e ETAR: Refinamentos 3D

Método Beam Subtraction

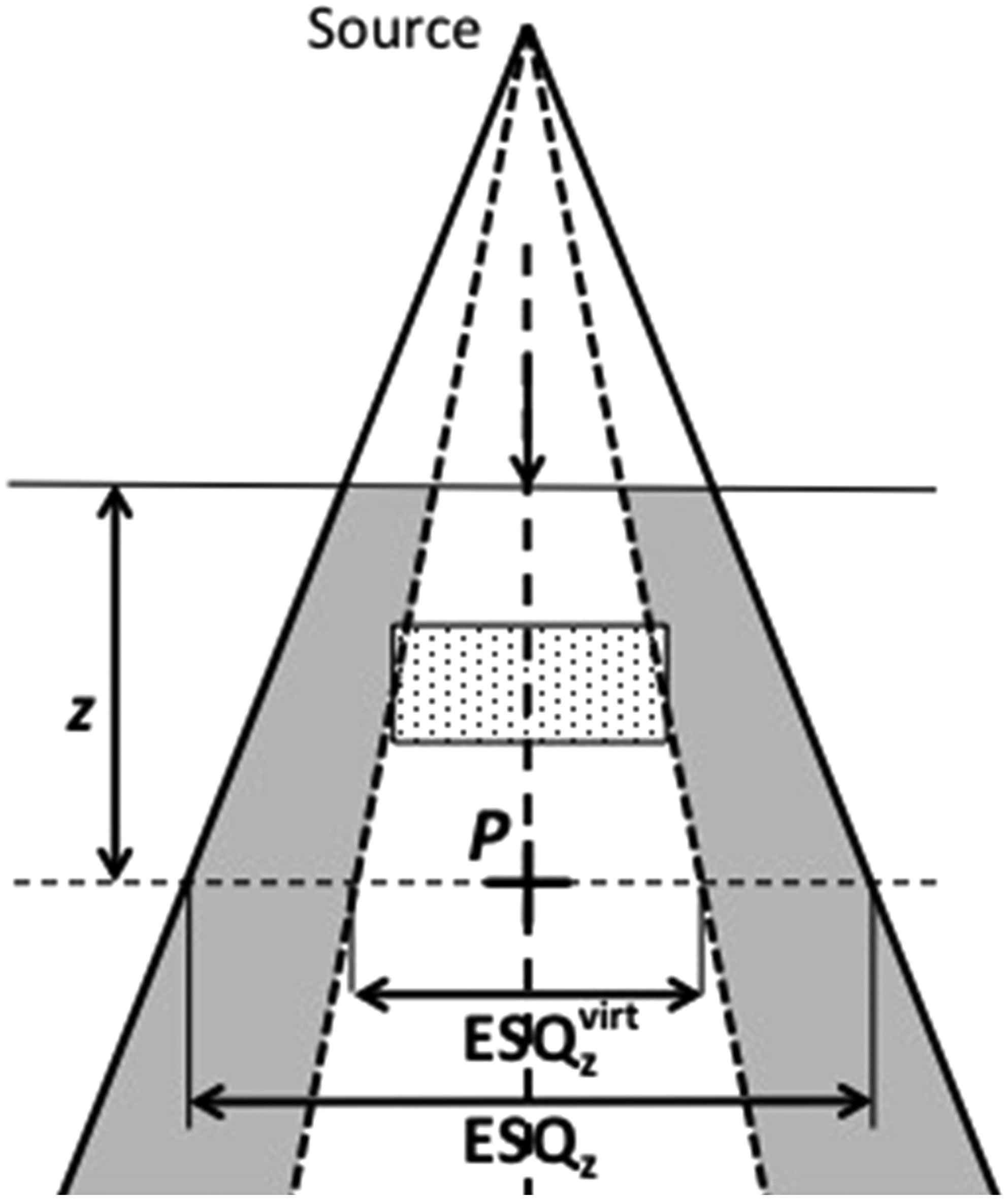

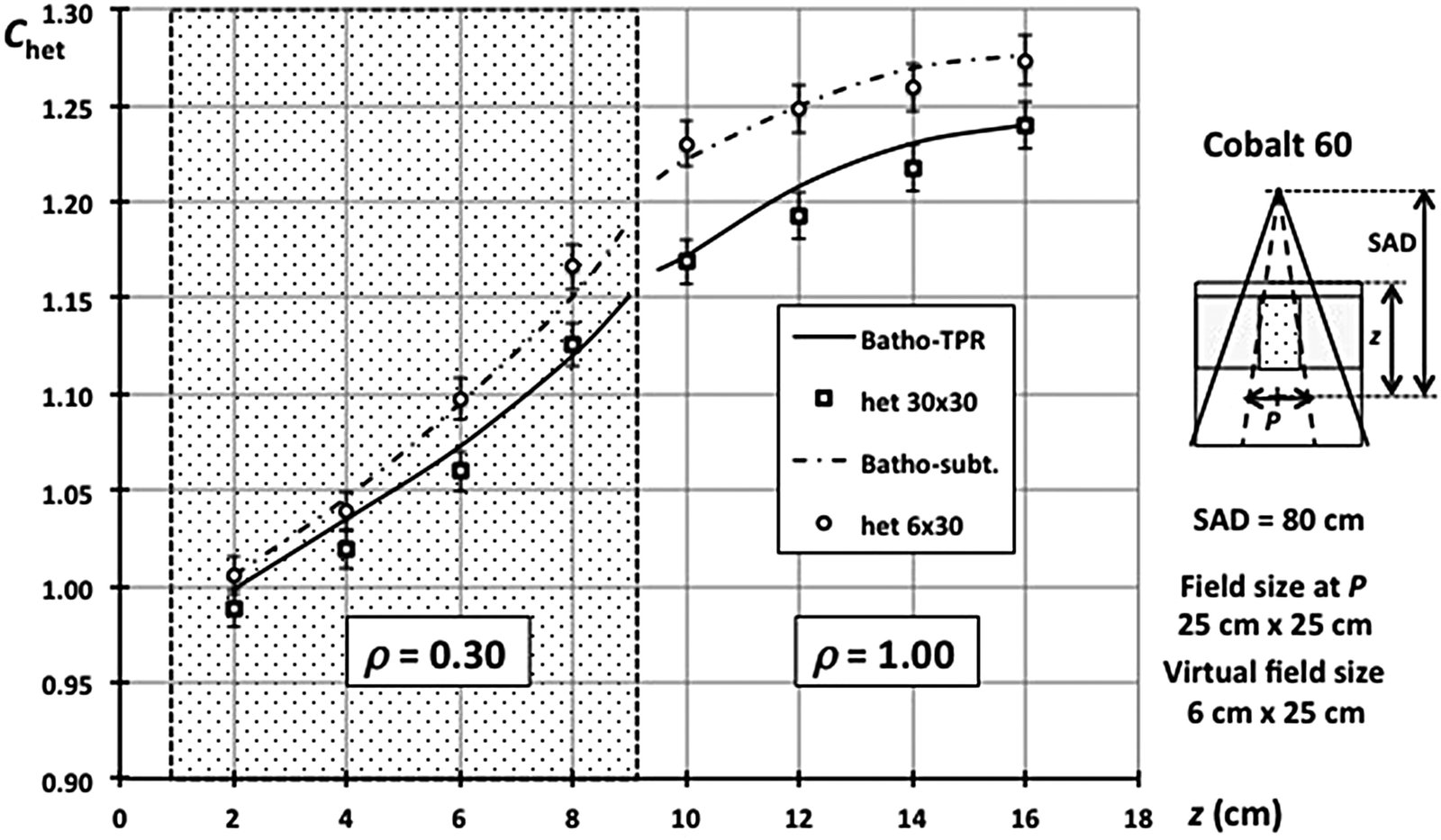

Quando a heterogeneidade é menor que o campo, o método de Batho falha porque assume geometria de camada infinita. O beam subtraction (Lulu e Bjärngard, 1982; Kappas e Rosenwald, 1982) resolve isso usando um feixe virtual ($ESQ_z^{virt}$) que cobre exatamente a heterogeneidade:

$$C_{het}^{Batho-subt} = 1 + \frac{TPR(z, ESQ_z^{virt})}{TPR(z, ESQ_z)} \times (C_{het}^{Batho} – 1)$$

A Figura 28.7 confirma a eficácia: para uma heterogeneidade de 6 cm de largura lateral ($\rho = 0{,}3$) em campo de 25×25 cm², a curva dot-dash do beam subtraction coincide com os pontos experimentais. O espalhamento perdido dentro e abaixo da heterogeneidade é naturalmente menor para 6 cm do que para 30 cm de largura.

Método ETAR (Equivalent Tissue-Air Ratio)

O método ETAR (Sontag e Cunningham, 1978) vai além ao escalar não apenas a profundidade, mas também o tamanho de campo. O fator de correção torna-se:

$$C_{het}^{ETAR} = \frac{TPR(z_{eff}, ESQ_z^{eff})}{TPR(z, ESQ_z)}$$

onde $ESQ_z^{eff}$ resulta de escalar o raio do campo equivalente circular pela densidade efetiva $\bar{\rho}$, calculada como média ponderada das densidades voxel a voxel:

$$\bar{\rho} = \frac{\sum_{i,j,k} \rho_{ijk} W_{ijk}}{\sum_{i,j,k} W_{ijk}}$$

Os pesos $W_{ijk}$ representam a contribuição de cada voxel ao espalhamento no ponto de cálculo. Na época, a computação completa 3D era proibitiva, então Sontag e Cunningham reduziram o array de densidades a 2D, colapsando pixels de mesmas coordenadas X,Z. Essa simplificação causou inconsistências documentadas por Wong e Henkelman (1983).

Limitações dos Métodos Broad-Beam

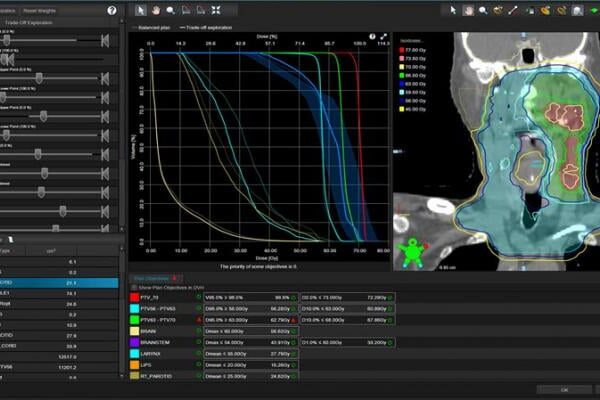

Após percorrer toda a cadeia de correções — forma, heterogeneidade, tamanho de campo — fica claro por que os métodos broad-beam foram progressivamente substituídos. Cada correção adiciona aproximações sobre aproximações. Funcionam razoavelmente para campos retangulares e foram o padrão clínico por décadas, mas são inadequados para situações modernas: campos não retangulares, IMRT, VMAT e estereotaxia.

A limitação fundamental é tratar o espalhamento de forma global, sem ray-tracing explícito da componente de scatter. Para heterogeneidades do tamanho de voxels (como interfaces osso-tecido mole em vértebras), aplicar correções projetadas para camadas grandes gera erros clinicamente relevantes.

A velocidade dos computadores removeu a motivação original: economia de recursos. Algoritmos de Monte Carlo e convolução/superposição oferecem hoje precisão fundamentalmente superior com tempos de cálculo aceitáveis na prática clínica. Para uma visão completa dessa evolução, veja nosso guia sobre algoritmos de cálculo de dose por fótons.