En Este Artículo

- 1. Método de Clarkson: Separación Primario-Dispersión

- 2. Integración 2D y Corrección para Campos Modulados

- 3. Extensión a Energías Altas: Mini-Phantom y TPR

- 4. El Principio de Superposición y la Convolución de Kernels

- 5. Fluencia Energética y Modelado de la Fuente

- 6. TERMA: Energía Total Liberada por Unidad de Masa

- 7. Kernels de Deposición de Energía en Agua

- 8. Comparación: Clarkson vs Convolución/Superposición

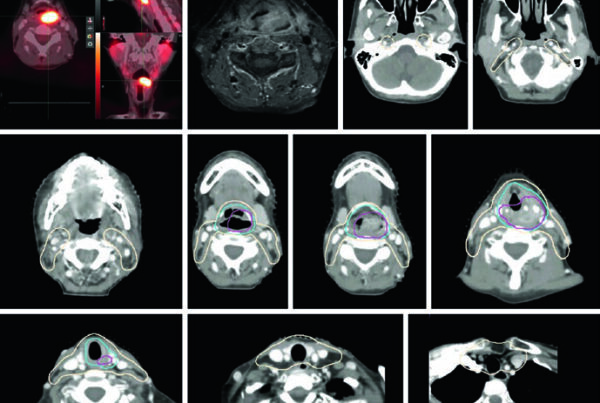

El cálculo de dosis por superposición de kernels representa el salto conceptual que separó los métodos empíricos de haz amplio de los algoritmos modernos utilizados en los sistemas de planificación de tratamiento (TPS). Antes de llegar a la convolución propiamente dicha, existe una etapa intermedia fundamental: la separación entre componente primaria y dispersada de la radiación — formalizada por el método de Clarkson — y la cuantificación de la energía total liberada en el medio, expresada mediante el concepto de TERMA. Este artículo recorre esa trayectoria, desde las integraciones angulares de dispersión hasta la formulación completa de convolución/superposición de kernels, según se describe en el Handbook of Radiotherapy Physics (2ª edición). Para una visión panorámica de todos los algoritmos, del empírico al Monte Carlo, consulte nuestra guía completa sobre algoritmos de cálculo de dosis por fotones.

Método de Clarkson: Separación Primario-Dispersión

La idea central del método de Clarkson consiste en calcular separadamente la dosis primaria y la dosis dispersada en cualquier punto de interés $P$. La componente primaria depende únicamente de la atenuación a lo largo del eje fuente-punto, mientras que la componente dispersada depende de la geometría completa del campo — su forma, tamaño y proximidad al punto $P$.

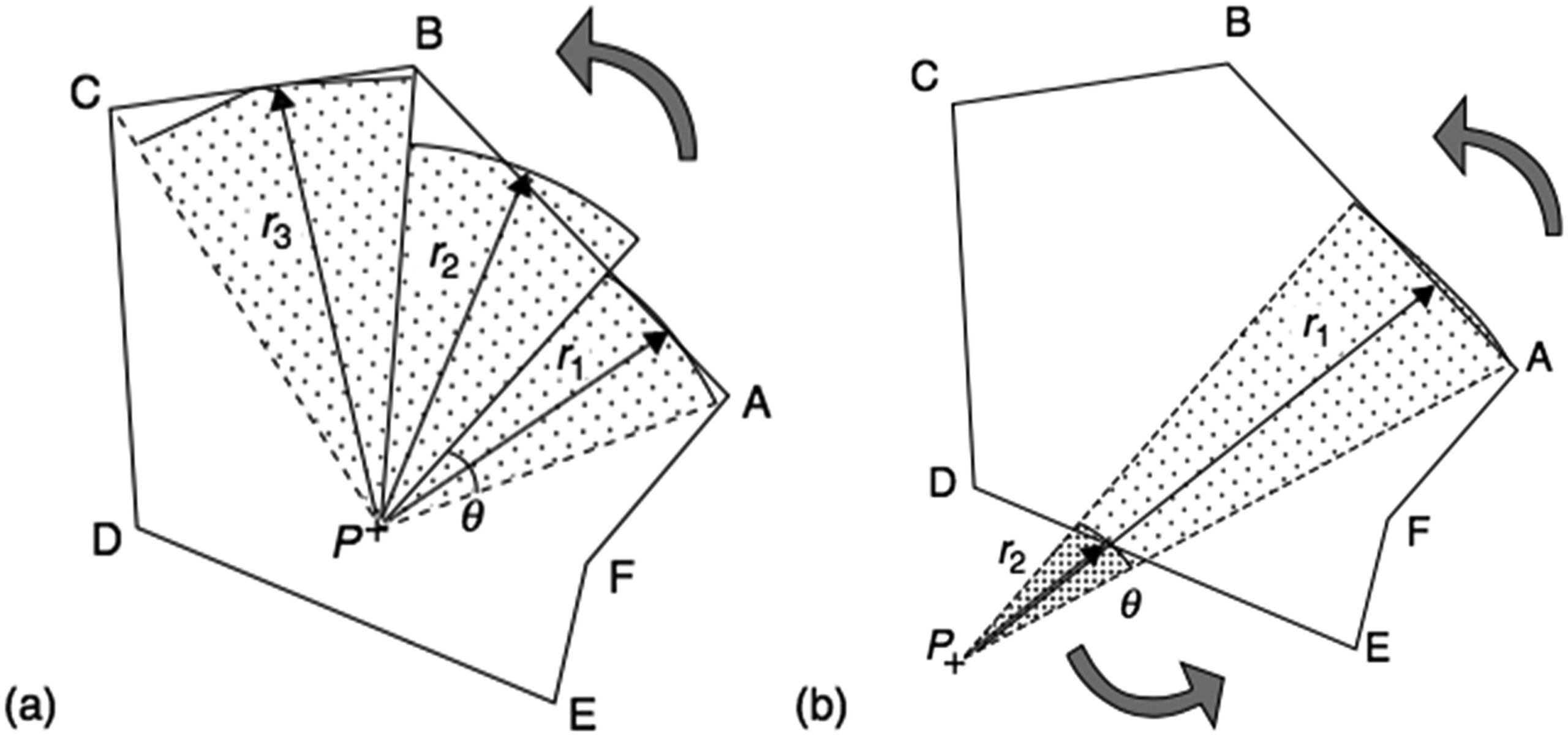

El campo irregular se divide en $n$ sectores angulares centrados en $P$. Cada sector $i$ posee un ancho angular $\Delta\theta_i$ y radio $r_i$ (medido hasta el borde del campo). La dispersión se suma sobre todos los sectores utilizando razones de dispersión-aire (SAR) tabuladas:

$$D_S(x,y,z) = D_A(z) \times \sum_i S(z, r_i) \frac{\Delta\theta_i}{2\pi}$$

Donde:

- $D_A(z)$ es la dosis «en aire» (sin atenuación) en la posición $(0,0,z)$

- $S(z, r_i)$ es la razón de dispersión-aire para la profundidad $z$ en un campo circular de radio $r_i$

- $\Delta\theta_i / 2\pi$ es la fracción angular que el sector representa del círculo completo

La componente primaria utiliza el TAR de campo cero — una abstracción matemática que representa la atenuación pura, sin dispersión. En la práctica, TAR$_0(z)$ no puede medirse directamente; se obtiene por extrapolación de TARs para campos pequeños hasta tamaño cero o mediante mediciones en condiciones libres de dispersión con grandes distancias entre fuente y detector.

$$D_P(x,y,z) = D_A(z) \times \text{TAR}_0(z) \times f(x,y)$$

Aquí $f(x,y)$ es el factor off-axis en aire que corrige el perfil del haz. La dosis total es simplemente:

$$D(x,y,z) = D_P(x,y,z) + D_S(x,y,z)$$

Cuando el punto $P$ está fuera del campo, la misma sumatoria funciona: sectores recorridos de derecha a izquierda (de A a B) reciben signo positivo, y de izquierda a derecha (de D a E), negativo — conservando solo la contribución desde dentro del campo.

Integración 2D y Corrección para Campos Modulados

El Clarkson clásico asume una superficie plana y fluencia primaria uniforme. En la práctica clínica, la superficie del paciente es oblicua e irregular, y el haz primario puede estar modulado por filtros de cuña, compensadores o colimadores multiláminas (MLC). La solución reside en la extensión a integración 2D con elementos tipo «lápiz» (pencil-beam scatter):

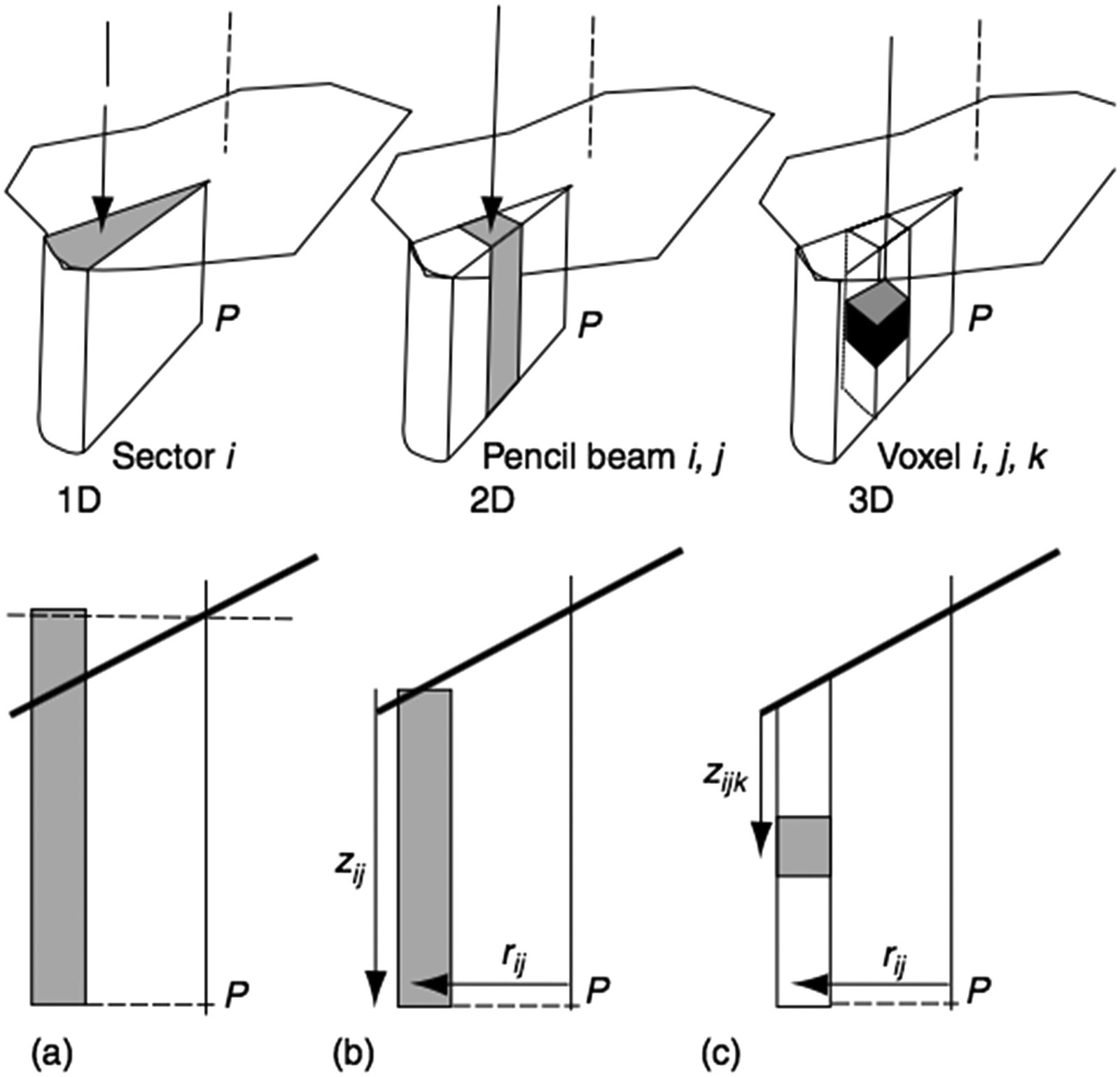

Cada elemento de dispersión se referencia a un sistema de coordenadas polares centrado en el punto de cálculo $P$, a una distancia $r_{ij}$ a lo largo del radio definido por el ángulo $\theta_i$, con espesor de tejido $z_{ij}$:

$$\Delta S_{ij}(z_{ij}, \theta_i, r_{ij}) = \frac{\Delta\theta_i}{2\pi} \times \left[ S(z_{ij}, r_{ij} + \Delta r) – S(z_{ij}, r_{ij}) \right]$$

Al integrar sobre el área del campo, cada pencil beam se pondera por la fluencia primaria local en el punto $ij$. Esta extensión produce resultados satisfactorios incluso para IMRT con MLC (Papatheodorou et al. 2000), ya que la oblicuidad de la superficie y la modulación de intensidad se consideran explícitamente.

Los intentos de ir más allá — integraciones 3D como el método dSAR (Beaudoin 1968; Cunningham 1972) — enfrentaron problemas con el comportamiento complejo de la dispersión múltiple y fueron parcialmente abandonados. Los métodos delta-volumen (Wong y Henkelman, 1983), dTAR (Kappas y Rosenwald, 1986b) y ETAR mejorado (Redpath y Thwaites, 1991) aportaron refinamientos, pero todos comparten una limitación fundamental: asumen que el recorrido de los electrones secundarios es despreciable.

Extensión a Energías Altas: Mini-Phantom y TPR

Conforme aumenta la energía de los fotones, el concepto de dosis «en aire» pierde relevancia práctica. Las capas de build-up necesarias para el equilibrio electrónico se vuelven demasiado grandes, y la atenuación y dispersión en su interior no pueden ignorarse. El TAR debe ser reemplazado.

La solución llegó con el concepto de mini-phantom: la atenuación de la componente primaria pasa a representarse mediante el TPR (tissue phantom ratio) medido en un mini-fantoma, TPR$(z, \text{ESQ}_{\text{mini}})$, donde ESQ$_{\text{mini}}$ es el cuadrado equivalente correspondiente a la geometría del mini-fantoma. La SAR se reemplaza por SAR$’$, obtenida a partir de:

$$\text{SAR}'(z, \text{ESQ}_z) = \text{TAR}'(z, \text{ESQ}_z) – \text{TPR}(z, \text{ESQ}_{\text{mini}})$$

Con TAR$’$ definida como:

$$\text{TAR}'(z, \text{ESQ}_z) = \text{TPR}(z, A_z) \frac{S_p(z_{\text{ref}}, \text{ESQ}_z)}{S_p(z_{\text{ref}}, \text{ESQ}_{\text{mini}})}$$

Donde $S_p$ es el factor de corrección de dispersión en el fantoma. La dosis de referencia «en aire» $D_A$ se reemplaza por la dosis en el mini-fantoma a la profundidad $z_{\text{ref}}$ para la apertura de colimador $A$, derivada mediante el proceso de calibración interna.

Estos métodos de separación primario-dispersión proporcionan resultados aceptables en muchas situaciones clínicas para campos mayores que ESQ$_{\text{mini}}$ en medios tipo agua (Knöös et al. 2006). Sin embargo, fallan donde hay falta de equilibrio electrónico: bordes de campo, interfaces con heterogeneidades, campos pequeños en haces de alta energía a través de pulmón (Mohan y Chui, 1985; Mackie et al., 1985; AAPM, 2004). Esta limitación motivó la transición hacia métodos basados en superposición de kernels de deposición de energía.

El Principio de Superposición y la Convolución de Kernels

La idea de utilizar convolución/superposición de kernels para el cálculo de dosis fue propuesta independientemente por varios grupos en 1984: Ahnesjö, Boyer y Mok, Chui y Mohan, Mackie y Scrimger. El concepto es elegante en su generalidad.

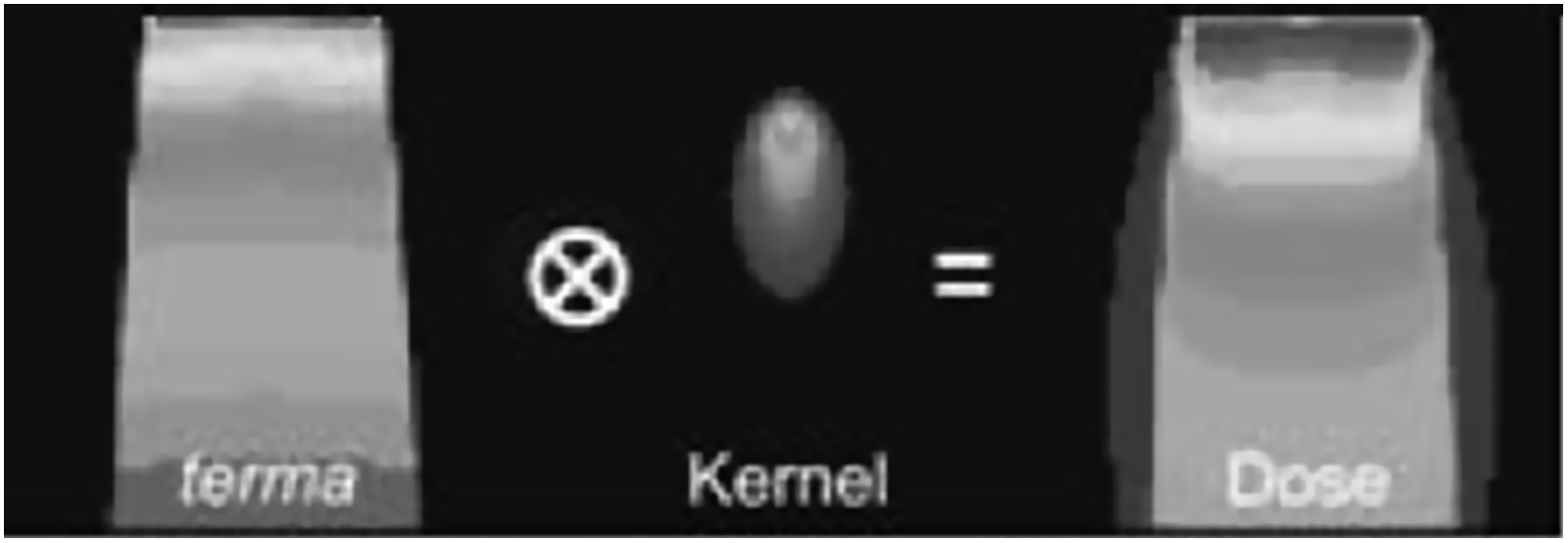

Para un medio homogéneo, la dosis en el punto $P$ en la posición $\mathbf{r} = [x, y, z]$ se expresa como:

$$D(\mathbf{r}) = \iiint \Psi(\mathbf{r}’) \frac{\mu}{\rho}(\mathbf{r}’) \, K(\mathbf{r} – \mathbf{r}’) \, dV’$$

Donde:

- $\Psi(\mathbf{r}’)$ es la fluencia energética (J m$^{-2}$) en el punto $P’$ en la posición $\mathbf{r}’ = [x’, y’, z’]$

- $\mu/\rho(\mathbf{r}’)$ es el coeficiente de atenuación másico (m$^2$ kg$^{-1}$) del medio en $P’$

- $\Psi(\mathbf{r}’) \cdot \mu/\rho(\mathbf{r}’)$ es la TERMA — energía total liberada por unidad de masa desde $dV’$ (J kg$^{-1}$ o Gy)

- $K(\mathbf{r} – \mathbf{r}’)$ es el kernel de deposición de energía, que representa la fracción de energía liberada en $dV’$ depositada en $P$

La integración se realiza en 3D sobre el volumen del paciente. Matemáticamente, si el kernel es espacialmente invariante, la operación es una convolución — lo que permite usar transformadas de Fourier para acelerar el cálculo. Cuando el kernel varía espacialmente (como en medios heterogéneos), la operación es una superposición, computacionalmente más costosa pero físicamente más precisa.

Para haces clínicos polienergéticos, la formulación general requiere integración adicional sobre los bins de energía del espectro local, con $\Psi$ reemplazado por la fluencia energética diferencial en energía y tanto $\mu/\rho$ como $K$ dependientes de la energía. Boyer et al. (1989) y Zhu y Van Dyk (1995) demostraron que un número limitado de bins es suficiente.

Fluencia Energética y Modelado de la Fuente

El cálculo de dosis por convolución requiere dos inputs fundamentales: la fluencia energética (o TERMA) en cada punto $P’$ y los kernels de deposición alrededor de $P’$. La determinación de la fluencia es un proceso en dos pasos: modelar la fluencia incidente en la superficie del paciente y luego transportarla a través del medio.

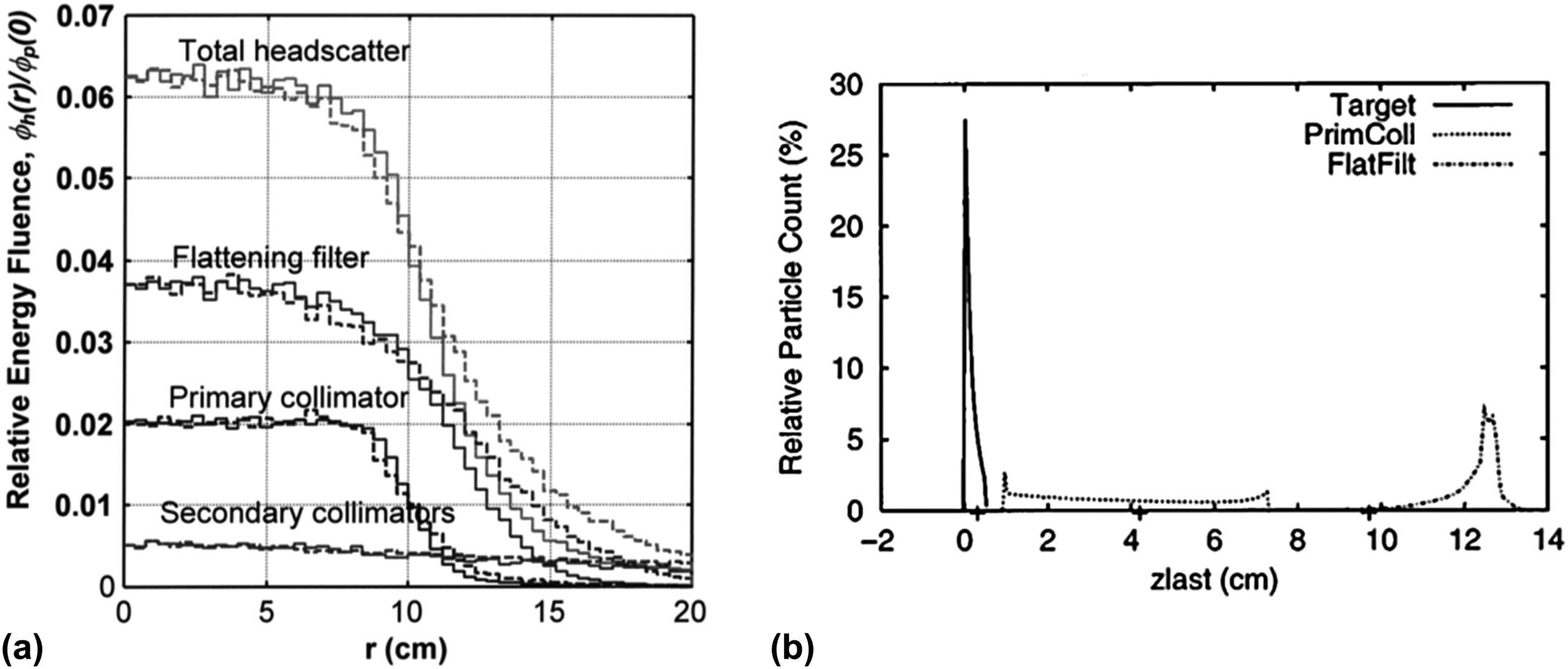

En un acelerador lineal, los fotones incidentes provienen principalmente de bremsstrahlung emitido desde el blanco. Sin embargo, típicamente un pequeño porcentaje es dispersado por el filtro aplanador y, en menor proporción, por las superficies internas del colimador primario y secundario. Esta contribución extrafocal tiene una posición de fuente efectiva aguas abajo del blanco físico y un perfil en forma de campana que se extiende más allá de los límites geométricos del campo.

Para haces sin filtro aplanador (FFF), la contribución extrafocal es menor y el modelo puede simplificarse (Kry et al. 2010; Almberg et al. 2012). Para haces convencionales, el modelo de fuente combina típicamente múltiples fuentes extendidas — blanco, colimador primario, filtro aplanador — integradas sobre las partes del cabezal visibles desde el punto de cálculo (Ahnesjö 1994; Sharpe et al. 1995; Fippel et al. 2003).

La modificación de la fluencia en el borde del campo y bajo los dispositivos de conformación se basa en consideraciones geométricas complementadas por el cálculo de transmisión a través del colimador principal, bloques o MLC. Con el desarrollo de la IMRT, se volvió crítico modelar con precisión la transmisión individual de cada lámina del MLC (Tyagi et al. 2007). Los resultados se almacenan como mapas 2D de fluencia inicial, modificables por matrices de corrección para cada dispositivo de conformación.

TERMA: Energía Total Liberada por Unidad de Masa

La fluencia incidente debe transportarse a través del paciente mediante ray tracing a lo largo de trayectorias divergentes desde la posición de la fuente, aplicando la corrección del inverso del cuadrado de la distancia y la atenuación en el tejido entre la superficie y $P’$.

Para un haz monoenergético de energía $E$, la atenuación de la radiación primaria a la profundidad $z’ = \sum_i \Delta z_i$ se calcula como (Ahnesjö et al. 1987):

$$\text{Atenuación} = e^{-\sum_i \left(\frac{\mu}{\rho}\right)_{E,i} \rho_i \Delta z_i}$$

Donde $\rho_i$ es la densidad másica del voxel $i$ y $(\mu/\rho)_{E,i}$ es el coeficiente de atenuación másico del voxel $i$ para la energía $E$.

Para haces polienergéticos, calcular la dosis como suma ponderada de cada bin de energía sería computacionalmente prohibitivo (Hoban 1995). La solución más eficiente consiste en usar un kernel polienergético precalculado y calcular la atenuación con coeficientes efectivos $\mu_{\text{eff}}$ obtenidos por el promedio ponderado según las contribuciones espectrales. La modificación espectral con la profundidad (beam hardening) se trata atenuando cada componente exponencialmente con su propio coeficiente (Hoban et al. 1994). Correcciones lineales adicionales pueden aplicarse a $\mu_{\text{eff}}$ para compensar el endurecimiento con la profundidad (Papanikolaou et al. 1993; Ahnesjö et al. 2005) y el ablandamiento off-axis (Tailor et al. 1998).

Los valores de $\mu/\rho$ resultantes se almacenan en una tabla 3D de consulta y se multiplican por la fluencia energética local para generar la distribución 3D de TERMA (Metcalfe et al. 1990). La TERMA es, por tanto, el «mapa de energía disponible» que será redistribuida por los kernels de deposición.

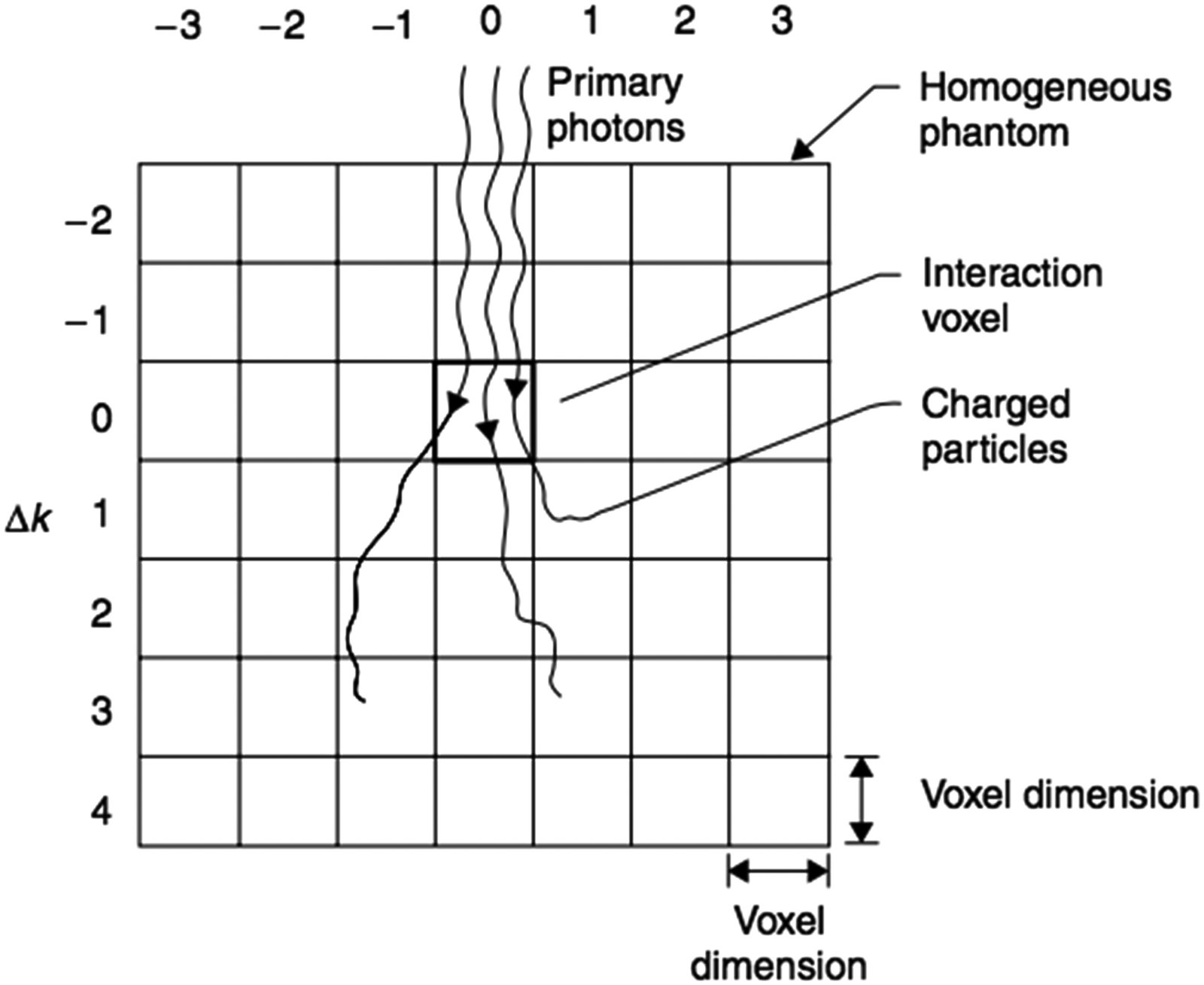

Kernels de Deposición de Energía en Agua

Los kernels $K$ en la ecuación de convolución se determinan mediante simulación Monte Carlo en fantoma de agua, forzando la interacción de los fotones primarios en el voxel de origen (Mackie et al. 1988; Mohan et al. 1986; Ahnesjö et al. 1987). La geometría esférica con coordenadas polares es la elección estándar, con intervalos radiales y angulares que permiten una representación precisa de la deposición de energía a cualquier distancia del punto de interacción.

Estos kernels pueden descomponerse en kernel primario $K_p$ (energía depositada por las partículas cargadas de los fotones primarios) y kernel de dispersión $K_s$ (energía depositada por todas las partículas cargadas asociadas a fotones dispersados, incluyendo bremsstrahlung y radiación de aniquilación). El kernel $K$ se normaliza como fracción de la energía incidente por unidad de volumen (cm$^{-3}$), satisfaciendo:

$$\iiint_{\infty} K(\mathbf{r}) \, dV \approx 1$$

Las integrales de los componentes siguen relaciones fundamentales (Mackie et al. 1988; Boyer et al. 1988):

$$\iiint_{\infty} K_p(\mathbf{r}) \, dV = \frac{\mu_{\text{en}}}{\mu}$$

$$\iiint_{\infty} K_s(\mathbf{r}) \, dV = \frac{\mu – \mu_{\text{en}}}{\mu}$$

Donde $\mu$ es el coeficiente de atenuación lineal y $\mu_{\text{en}}$ es el coeficiente de absorción de energía lineal. Estas relaciones sirven para verificación de los kernels generados y para aplicar correcciones por variaciones en la calidad del haz.

Para haces clínicos polienergéticos, el enfoque más eficaz es generar kernels polienergéticos por adición ponderada de kernels monoenergéticos precalculados, según el espectro normalizado de fluencia energética incidente. Dado que el espectro cambia con la profundidad y posición lateral (endurecimiento del haz), Liu et al. (1997d) propusieron precalcular kernels polienergéticos a diferentes profundidades (típicamente tres) e interpolar entre ellos.

Clarkson vs Convolución/Superposición: ¿Cuándo Usar Cada Uno?

| Característica | Clarkson / Separación Primario-Dispersión | Convolución/Superposición de Kernels |

|---|---|---|

| Principio físico | Separación empírica primario + dispersión con SARs tabuladas | Integración 3D de la TERMA con kernels MC de deposición de energía |

| Tratamiento de heterogeneidades | Factores de corrección (Batho, ETAR); asume recorrido de electrones despreciable | Escalado del kernel por densidad; modela transporte de electrones implícitamente |

| Precisión en borde del campo | Limitada en campos pequeños e interfaces pulmón/tejido | Superior, especialmente con kernels anisotrópicos |

| Campos modulados (IMRT) | Posible con extensión 2D (pencil scatter) | Naturalmente compatible vía mapas de fluencia 2D |

| Velocidad computacional | Rápido (tablas + sumatorias) | Más lento (convolución 3D); acelerado con FFT |

| Uso clínico actual | Ampliamente reemplazado, excepto sistemas legados | Base de los algoritmos comerciales modernos (CCC, AAA, Pinnacle) |

Tabla comparativa basada en el Handbook of Radiotherapy Physics, 2nd Ed.

Aplicación Clínica del Clarkson Modificado: Verificación Independiente de Unidades Monitoras

Aunque los métodos de separación primario-dispersión han sido ampliamente reemplazados en los TPS modernos, el algoritmo de Clarkson Modificado conserva un papel clínico fundamental: la verificación independiente del cálculo de unidades monitoras (UM). Los programas de garantía de calidad en radioterapia exigen que el cálculo de UM generado por el TPS sea verificado mediante un segundo método, preferiblemente basado en un algoritmo y datos independientes. La velocidad computacional y la base física bien comprendida del Clarkson Modificado lo hacen ideal para esta función de doble verificación.

El software RTConnect, desarrollado por RT Medical Systems, utiliza exactamente este enfoque: implementa el algoritmo de Clarkson Modificado para la verificación independiente de UM en campos conformados 3D y técnicas basadas en MLC. El cálculo considera la separación primario-dispersión con SARs equivalentes, correcciones de bandeja, filtro de cuña y factores off-axis, proporcionando una verificación rápida y confiable que complementa el resultado del TPS principal. Esta metodología de verificación basada en Clarkson está bien documentada en la literatura, según se describe en el artículo técnico publicado en el repositorio del IAEA sobre verificación de UM por método de Clarkson.

En la práctica clínica, el uso de un sistema de doble verificación independiente como RTConnect no es solo una buena práctica — es un requisito de programas de acreditación y auditorías de calidad. La discrepancia entre el cálculo del TPS y la verificación independiente sirve como indicador de posibles errores de entrada de datos, configuración del plan o limitaciones algorítmicas en condiciones específicas.

Los métodos de separación primario-dispersión fueron históricamente importantes y aún ofrecen resultados aceptables en medios tipo agua para campos regulares. Pero la demanda de precisión en heterogeneidades, campos pequeños e IMRT impulsó el estado del arte hacia la convolución/superposición de kernels — que a su vez abrió camino a los algoritmos comerciales como el Collapsed Cone Convolution (CCC) y el Monte Carlo clínico.

La transición del Clarkson a la convolución no fue simplemente un cambio de método; fue un cambio de paradigma. Clarkson opera sobre datos empíricos tabulados — TARs, SARs, perfiles medidos. La convolución opera sobre magnitudes físicas fundamentales — fluencia, TERMA, kernels derivados de primeros principios vía Monte Carlo. Esta base física hace que los métodos de convolución/superposición sean intrínsecamente más generalizables y confiables fuera de las condiciones de calibración.

Para profundizar en los kernels de deposición y el algoritmo Collapsed Cone Convolution específicamente, siga los próximos artículos de esta serie. Si trabaja con planificación de tratamiento y recomendaciones DVH, comprender estos fundamentos es indispensable para evaluar críticamente los resultados de su TPS.