El algoritmo pencil beam, el Fast Pencil Beam y el AAA (Analytical Anisotropic Algorithm) han dominado los sistemas de planificación comerciales durante décadas. Mientras el pencil beam descompone el haz clínico en haces elementales estrechos y los convoluciona con la fluencia incidente, el Fast Pencil Beam sacrifica parte de esa precisión a cambio de una velocidad computacional drástica en los bucles de optimización. El AAA evoluciona el concepto original al tratar separadamente los componentes longitudinales y laterales con escalado anisotrópico según la densidad. Este artículo analiza en profundidad los tres métodos — desde los fundamentos matemáticos hasta las limitaciones clínicas en medios heterogéneos — basándose en el Handbook of Radiotherapy Physics (2nd Ed., CRC Press).

En Este Artículo

- 1. Principio del Pencil Beam para Fotones

- 2. Determinación de los Kernels

- 3. Implementaciones Prácticas en TPS

- 4. Limitaciones en Medios Heterogéneos

- 5. Fast Pencil Beam: Velocidad para Optimización

- 6. El AAA en Eclipse: Evolución del Pencil Beam

- 7. Rendimiento y Limitaciones del AAA

- 8. Pencil Beam para Electrones: Modelo Fermi–Eyges

- 9. Pencil Beam para Protones

- 10. Comparación entre Algoritmos Comerciales

Principio del Pencil Beam para Fotones

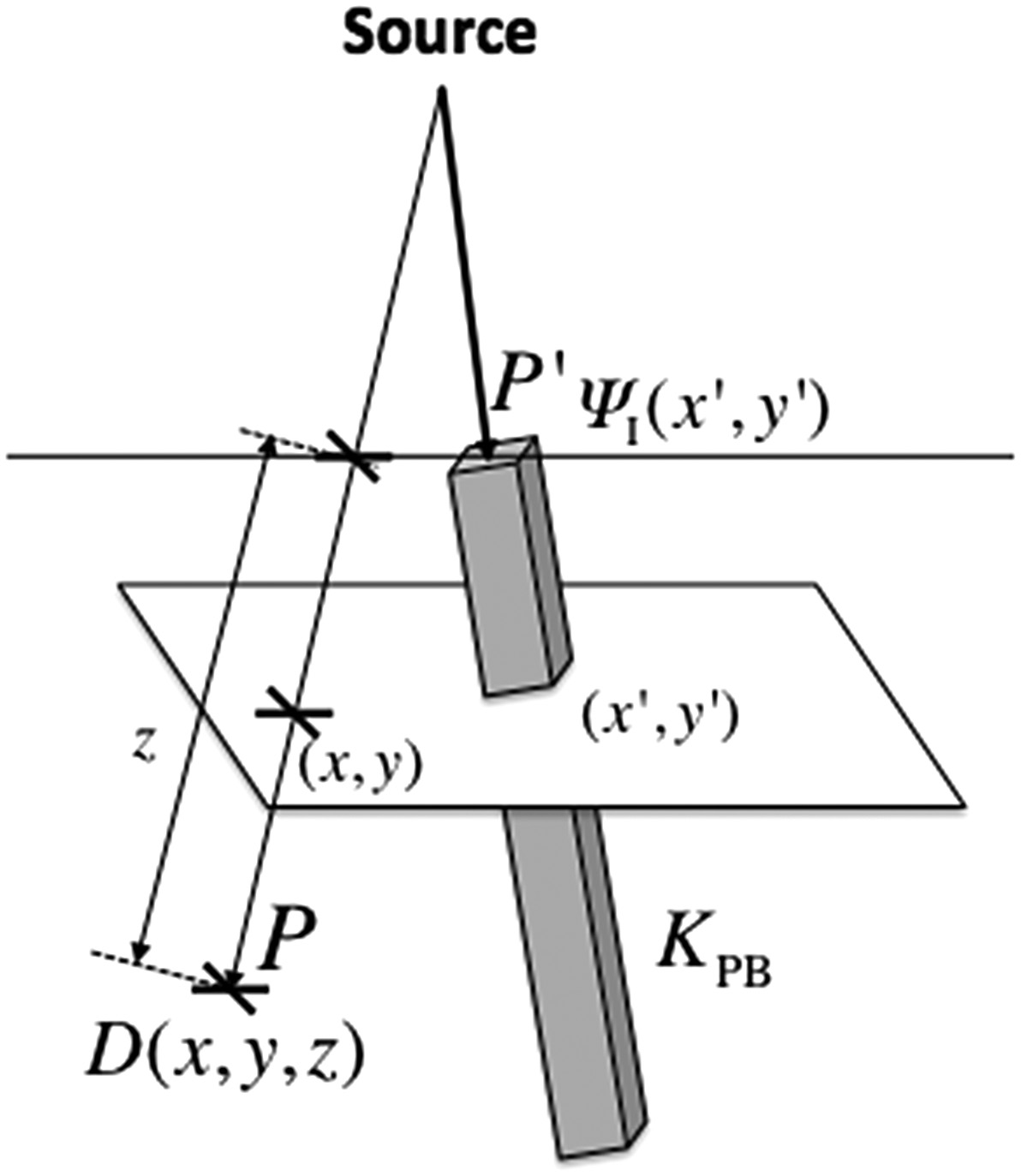

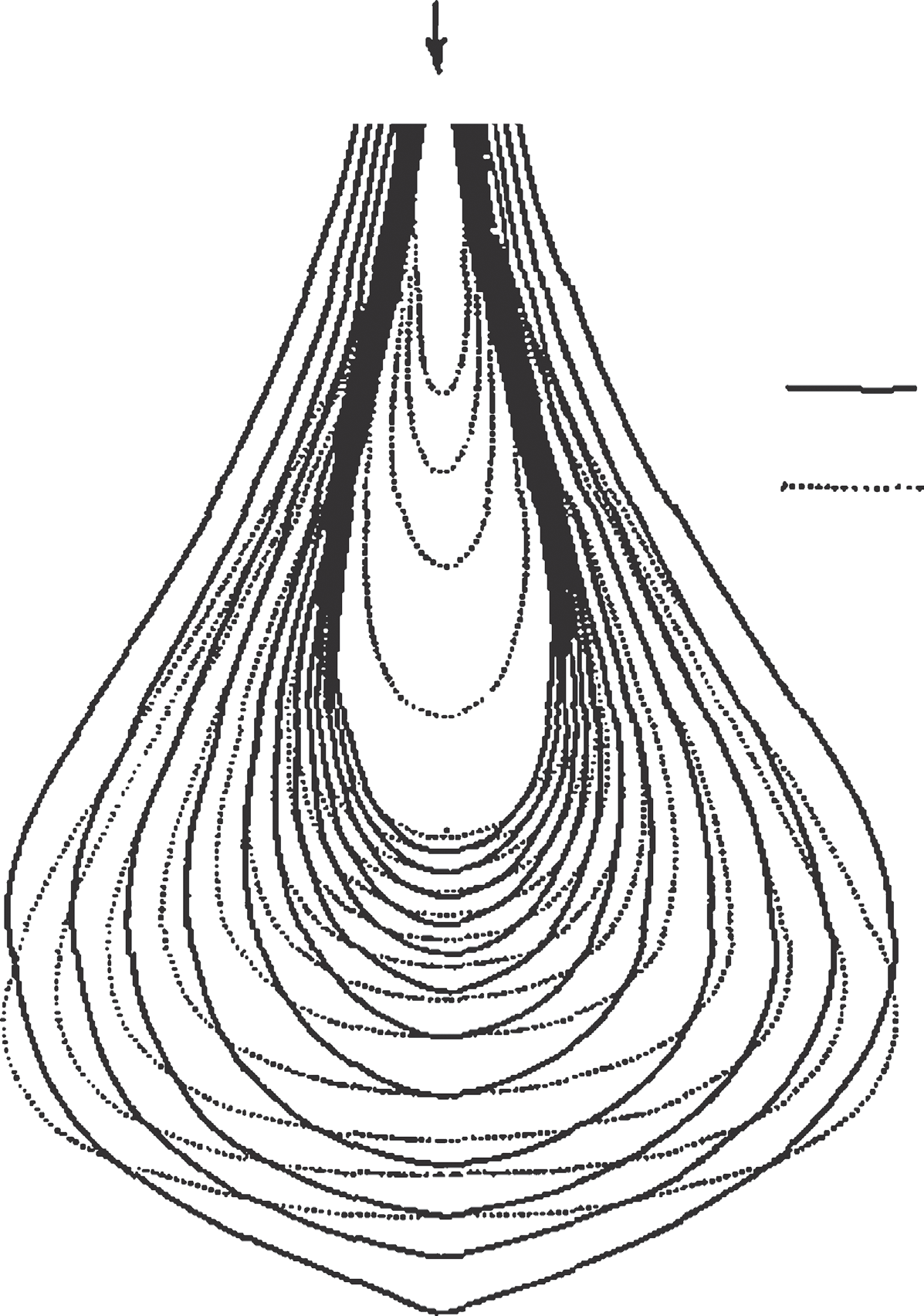

La idea central del pencil beam es intuitiva: descomponer el haz clínico en un conjunto de haces elementales estrechos («lápices») y sumar sus contribuciones de dosis en cada punto de cálculo. La dosis en el punto $P(x,y,z)$ resulta de la integración sobre el área del campo de los kernels pencil beam $K_{PB}$ ponderados por la fluencia energética primaria incidente $\Psi_I$:

$$D(x,y,z) = \iint \frac{\mu}{\rho} \Psi_I(x’,y’) \, K_{PB}(x-x’, y-y’, z) \, dx’ \, dy’ \quad (28.32)$$

Donde:

- $\Psi_I(x’,y’)$ es la fluencia energética incidente en $P’$ (J m⁻²)

- $\mu/\rho$ es el coeficiente de atenuación másico (m² kg⁻¹) del medio en $P’$

- $(\mu/\rho)\Psi_I(x’,y’)$ es el TERMA — energía total liberada por unidad de masa (J kg⁻¹ o Gy)

- $K_{PB}(x-x’, y-y’, z)$ es el kernel pencil beam, que representa la fracción de energía depositada por unidad de masa en $P$ debido a la fluencia primaria entrando por $P’$

La diferencia fundamental entre el pencil beam y la separación primario-dispersión (método de Clarkson) es que en el pencil beam el «lápiz» transporta toda la energía depositada a distancia — tanto por electrones secundarios como por fotones dispersados. En el método de superposición con Clarkson, solo el componente de dispersión se integra sobre el área del campo.

Este enfoque hace que el pencil beam sea naturalmente adecuado para modelar variaciones en la intensidad incidente — causadas por filtros, compensadores o modulación dinámica de intensidad (IMRT). Las variaciones espectrales fuera del eje también pueden considerarse ajustando la calidad del pencil beam según la posición de entrada.

Determinación de los Kernels Pencil Beam

El kernel pencil beam es el corazón del método. Existen diversas formas de obtenerlo, y la elección impacta directamente la precisión clínica.

Kernels por Monte Carlo directo

Mohan y Chui (1987) realizaron cálculos Monte Carlo directos usando el código EGS4 para generar kernels monoenergéticos y polienergéticos para haces de cobalto-60, 6 MV y 18 MV. Demostraron que el método dependía únicamente de principios físicos fundamentales, sin recurrir a hipótesis empíricas ni funciones analíticas arbitrarias.

Modelo analítico de Ahnesjö

Ahnesjö et al. (1992b) presentaron un modelo pencil beam completo para uso clínico, empleando kernels polienergéticos obtenidos por convolución en profundidad de kernels puntuales derivados por Monte Carlo. Estos kernels se representaron analíticamente como una suma de dos exponenciales sobre el radio:

$$K_{PB}(r,z) = \frac{A_z \, e^{-a_z r}}{r} + \frac{B_z \, e^{-b_z r}}{r} \quad (28.33)$$

Donde $r$ es el radio cilíndrico desde el eje del pencil beam, y $A_z$, $a_z$, $B_z$, $b_z$ son parámetros de ajuste dependientes de la profundidad $z$. El denominador $r$ (en lugar de $r^2$ como en kernels puntuales) compensa la dispersión geométrica desde una fuente lineal infinita.

Implementaciones Prácticas en TPS

En medio homogéneo, los kernels pencil beam pueden considerarse invariantes con la posición, transformando la Ecuación 28.32 en una convolución verdadera acelerada por la transformada rápida de Fourier (FFT) — estrategia explotada con éxito por Boyer (1984) y Mohan y Chui (1987).

Mohan y Chui demostraron el poder del método para campos irregulares en medio uniforme. Bortfeld et al. (1993) optimizaron la eficiencia descomponiendo el kernel en tres términos separados y empleando la transformada rápida de Hartley. Storchi y Woudstra (1996) desarrollaron un modelo con desviaciones menores al 2% para campos rectangulares e irregulares, excepto para cuñas de 45° (4–5%). Este algoritmo se incorporó al TPS Cadplan (Dosetek–Varian) y migró posteriormente a Eclipse.

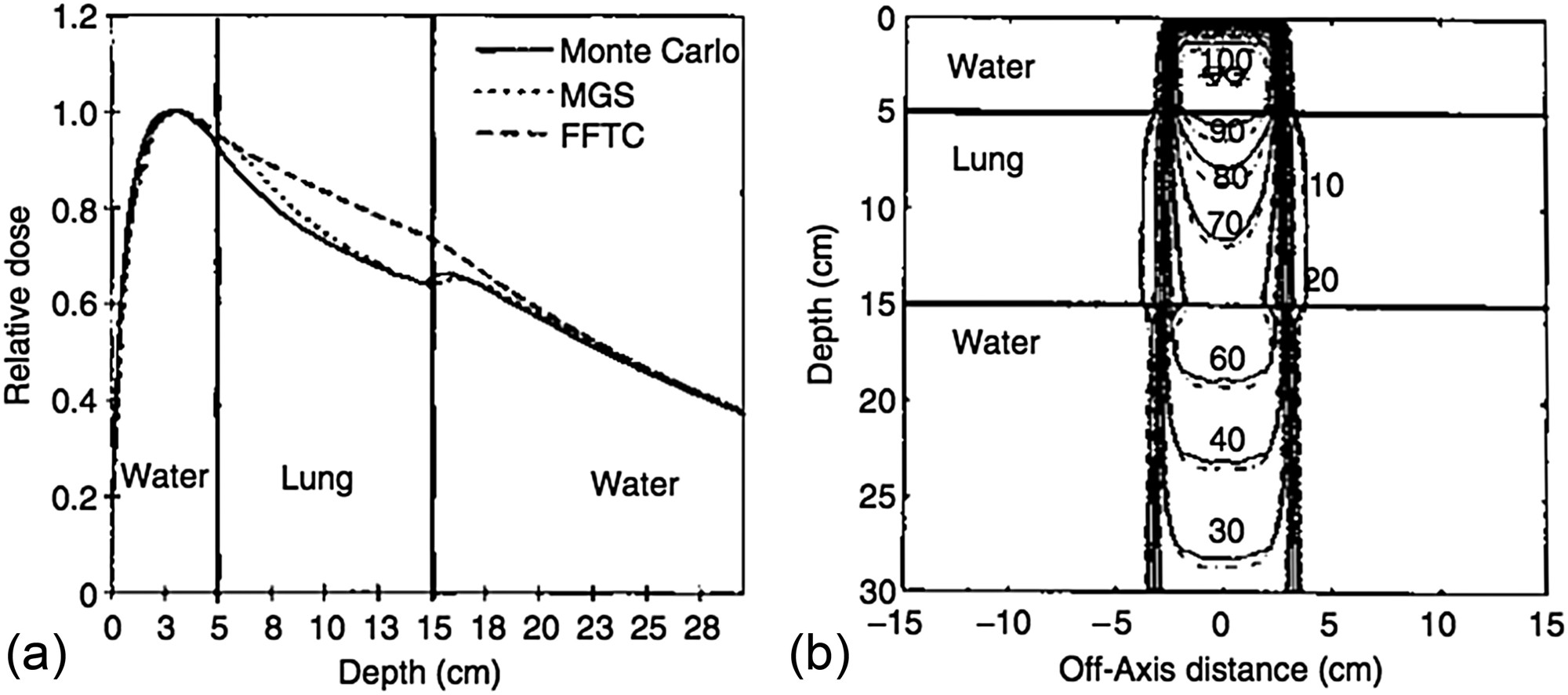

Limitaciones del Pencil Beam en Medios Heterogéneos

Bortfeld et al. (1993) ya advertían: alta precisión con el pencil beam solo es alcanzable, en principio, para fantomas homogéneos con superficies planas. Knöös et al. (1995) estudiaron en detalle las limitaciones en tejido pulmonar, comparando el modelo del sistema Helax-TMS con cálculos Monte Carlo en la geometría desafiante del mediastino. Las desviaciones en volúmenes de baja densidad aumentaron con la energía: ~3% a 4 MV, alcanzando 14% a 18 MV — resultado atribuido al desequilibrio electrónico.

El pencil beam convencional se clasifica como algoritmo tipo ‘a’ — no contabiliza adecuadamente el transporte de electrones secundarios. Su uso no se recomienda para planificación en regiones torácicas. Los detalles sobre métodos de corrección pueden encontrarse en nuestro artículo sobre métodos empíricos de cálculo de dosis.

Fast Pencil Beam: Velocidad para Optimización en Tiempo Real

El Fast Pencil Beam es una variante simplificada y acelerada del algoritmo pencil beam convolutivo, diseñada específicamente para proporcionar estimaciones de dosis en tiempo real durante los bucles iterativos de optimización inversa de IMRT y VMAT. Mientras que el pencil beam convencional ya ofrece velocidad razonable, los cientos o miles de iteraciones necesarias en la planificación inversa exigen un motor de cálculo aún más rápido — y ese es precisamente el nicho que ocupa el Fast Pencil Beam.

Principio de funcionamiento

La estrategia central del Fast Pencil Beam consiste en pre-computar tablas de consulta (lookup tables) que almacenan valores de dosis por unidad de fluencia para cada combinación relevante de profundidad, distancia lateral y tamaño de campo equivalente. Durante la optimización, en lugar de ejecutar la integral de convolución completa de la Ecuación 28.32, el algoritmo interpola directamente en esos datos tabulados. Los kernels de dispersión son reemplazados por modelos simplificados — frecuentemente gaussianas de ancho fijo o polinomios de bajo orden — que sacrifican la fidelidad del transporte lateral a cambio de una reducción drástica en el tiempo de cómputo.

Además de las lookup tables, las implementaciones típicas emplean técnicas adicionales de aceleración: muestreo disperso de la grilla de cálculo (con interpolación en los puntos intermedios), truncamiento de los kernels a distancias laterales donde la contribución es despreciable, y representación de la fluencia modulada en resolución reducida. El resultado es un algoritmo capaz de calcular una distribución de dosis completa en fracciones de segundo — viabilizando la convergencia del optimizador inverso en minutos en lugar de horas.

Papel en el flujo de trabajo clínico

En la práctica clínica, el Fast Pencil Beam no se utiliza como algoritmo de cálculo de dosis final. Su papel se limita al engine de optimización: en cada iteración de la planificación inversa, el optimizador evalúa cientos de posibles configuraciones de fluencia y necesita una respuesta rápida sobre la dosis resultante. En este contexto, una estimación con precisión de 2–5% es suficiente para guiar la convergencia del algoritmo.

Una vez que el optimizador converge hacia una solución de fluencia óptima, el cálculo de dosis final se realiza con un algoritmo de mayor fidelidad — típicamente el AAA, el Collapsed Cone Convolution (CCC) o, en sistemas más modernos, Monte Carlo o soluciones determinísticas como Acuros XB. Este enfoque en dos etapas — optimización rápida seguida de cálculo final preciso — es el estándar de facto en los sistemas de planificación contemporáneos.

Comparación con el pencil beam convencional

Las diferencias entre el Fast Pencil Beam y el pencil beam convencional no son de naturaleza conceptual, sino de implementación. Ambos se basan en la descomposición del haz en lápices elementales; la versión «fast», sin embargo, sustituye kernels físicamente detallados por aproximaciones tabuladas. En medio homogéneo, las discrepancias entre ambos son generalmente inferiores al 2–3%. En medios heterogéneos — particularmente en interfaces pulmón-tejido blando y en regiones de build-up —, el Fast Pencil Beam presenta desviaciones mayores que el pencil beam convencional, ya que las simplificaciones en los kernels reducen aún más la capacidad de modelar el desequilibrio electrónico.

Esta pérdida de precisión es clínicamente aceptable durante la optimización porque el objetivo en esa fase no es obtener la dosis final, sino encontrar el mapa de fluencia que mejor satisface las restricciones clínicas. La dosis «real» solo se evalúa después de convertir la fluencia optimizada en segmentos de MLC y recalcular con el algoritmo de referencia.

Ejemplos comerciales

El ejemplo más prominente es el sistema Eclipse (Varian), que utiliza el Fast Pencil Beam como motor de dosis durante la optimización de planes IMRT y VMAT, con recálculo final por AAA o Acuros XB. RayStation (RaySearch) emplea un enfoque similar, con un pencil beam rápido en el optimizador y CCC o Monte Carlo para el cálculo definitivo. En Pinnacle (Philips), el CCC se usa tanto en la optimización como en el cálculo final, lo que resulta en tiempos de optimización más largos, pero con consistencia de dosis a lo largo de todo el proceso.

La tendencia en los sistemas más recientes es reemplazar el Fast Pencil Beam por motores de optimización basados en GPU (Graphics Processing Unit), que permiten ejecutar algoritmos más precisos — incluyendo versiones aceleradas de CCC e incluso Monte Carlo — en tiempos compatibles con la optimización iterativa. Aun así, el Fast Pencil Beam permanece en amplio uso clínico y constituye una etapa esencial del flujo de trabajo en miles de centros de radioterapia.

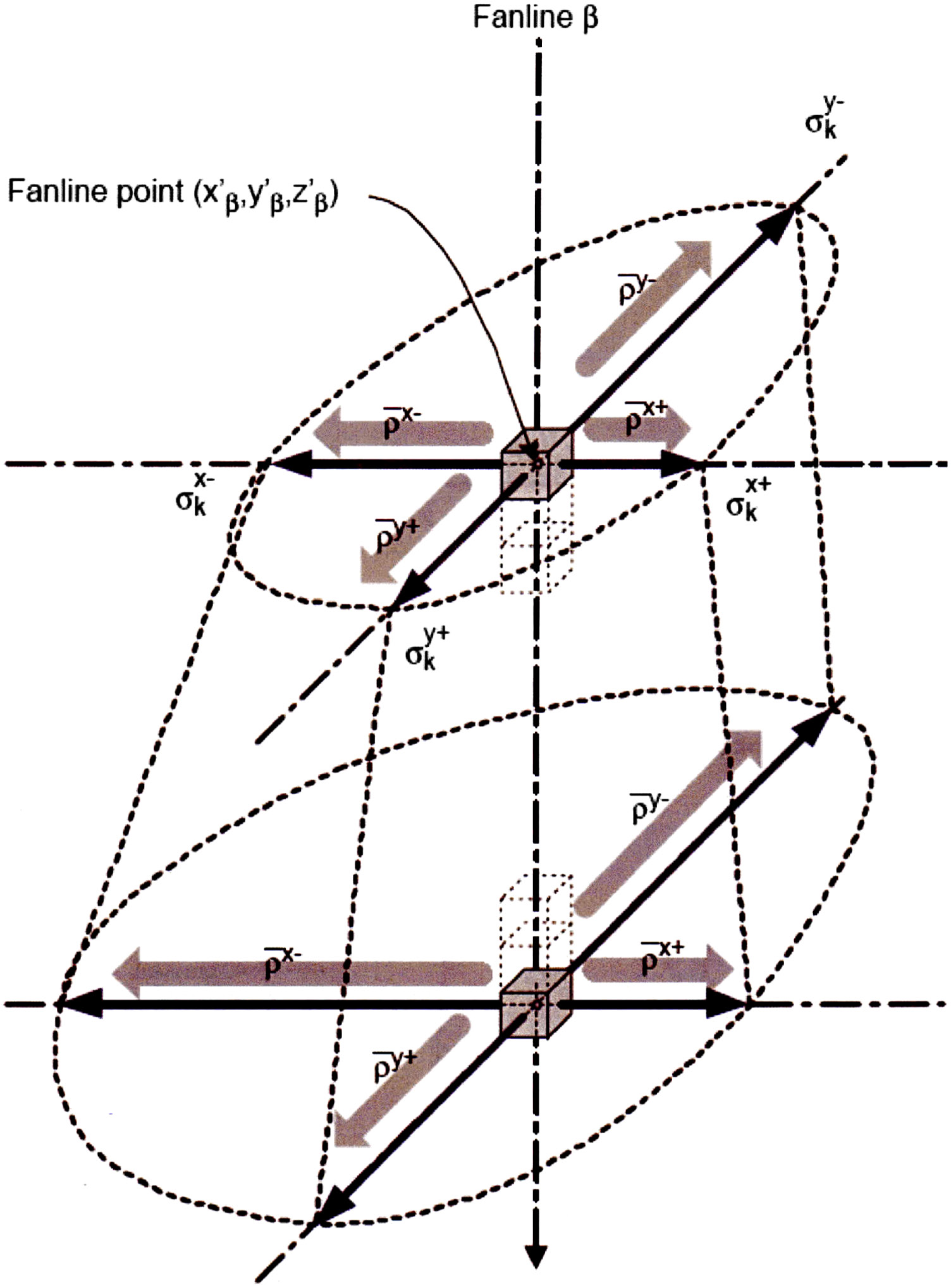

El AAA en Eclipse: Evolución del Pencil Beam

El Analytical Anisotropic Algorithm (AAA) se implementó en Eclipse (Varian) a principios de los años 2000. Se trata de un algoritmo de convolución/superposición pencil beam con tratamiento explícito y separado de componentes longitudinales y laterales, escalados según la densidad del medio.

La dosis total resulta de la suma de contribuciones de beamlets $\beta$ cubriendo toda el área del campo. En medio acuoso, la contribución de dosis en $P(x,y,z)$ de un beamlet individual $\beta$ es:

$$D_\beta(x,y,z) = I_\beta(z) \iint F_0(x’,y’) \, K_\beta(x-x’, y-y’, z) \, dx’ \, dy’ \quad (28.34)$$

La diferencia crucial respecto a la Ecuación 28.32: la deposición primaria de energía ($I_\beta$) se trata separadamente, no está incluida en el kernel de dispersión. El kernel polienergético se representó en versiones posteriores como una suma de seis funciones exponenciales radiales:

$$K_\beta(r,z) = \sum_{k=1}^{6} c_k \, \frac{1}{r} \, e^{-\mu_k r} \quad (28.35)$$

Donde $\mu_k$ define el alcance del componente de dispersión $k$ y $c_k$ es el peso relativo. En medio heterogéneo, los componentes son ponderados por la densidad relativa local y escalados lateralmente usando la longitud de camino equivalente en agua, con un enfoque recursivo que preserva el «historial» del escalado.

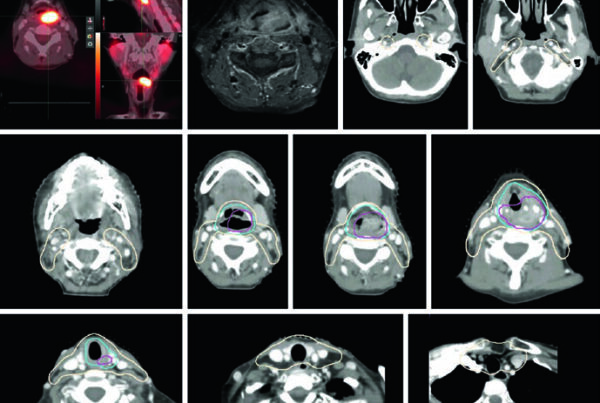

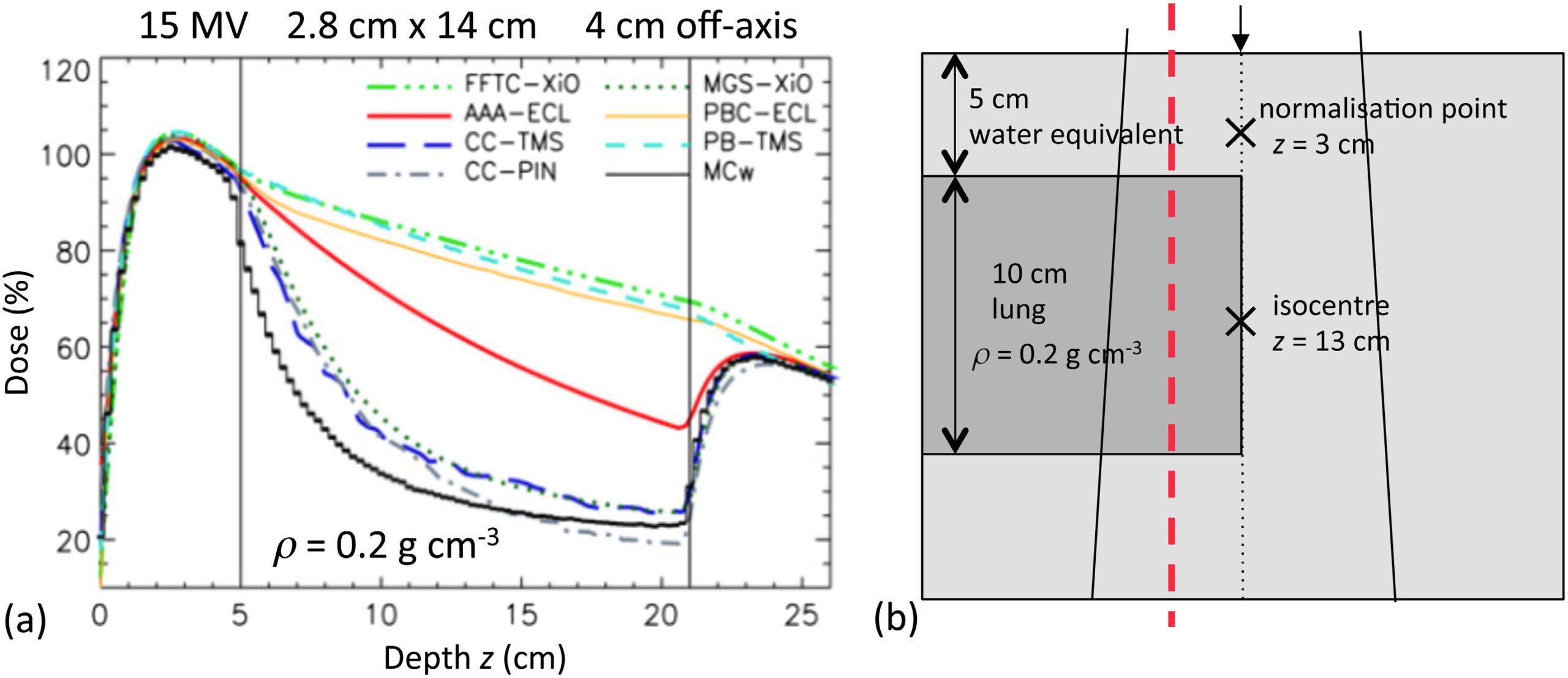

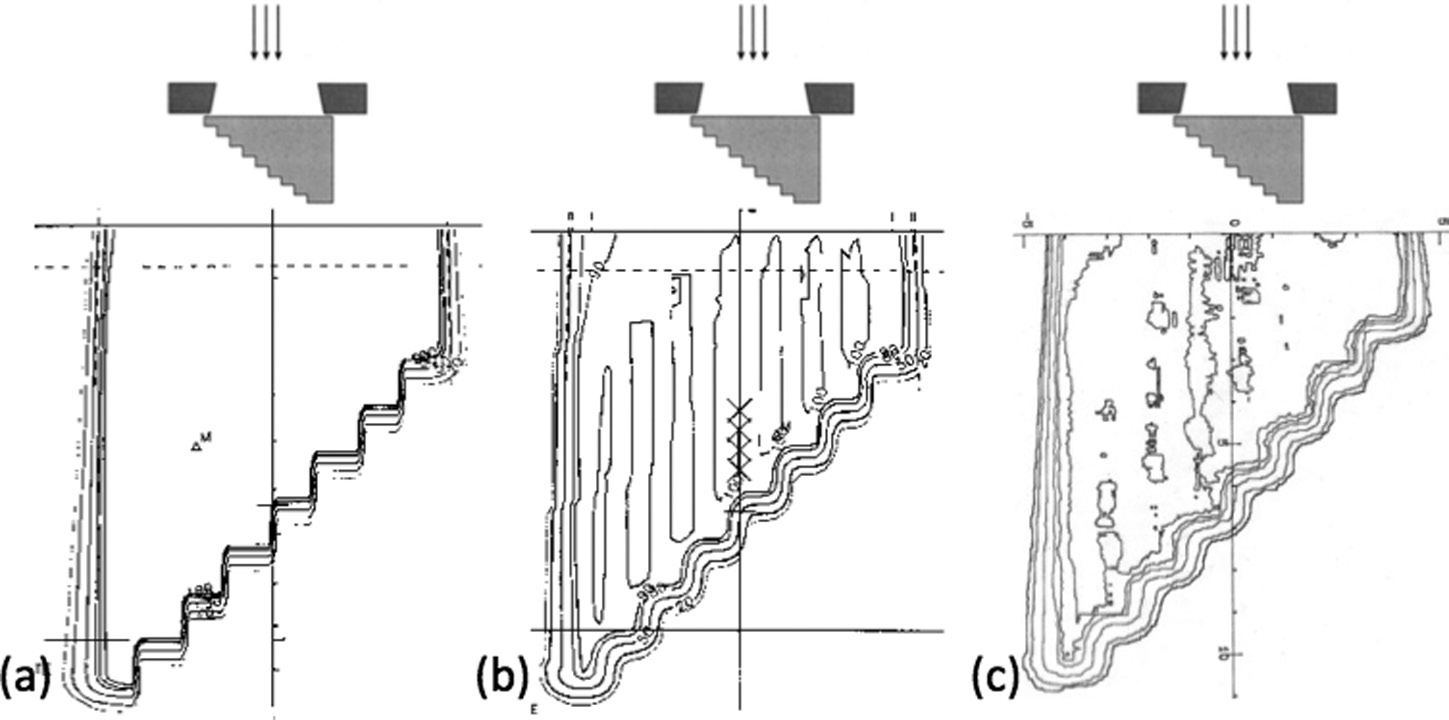

Rendimiento y Limitaciones del AAA

Comparado con el pencil beam convencional previo en Eclipse, el AAA representó una mejora significativa en la precisión del cálculo de dosis en heterogeneidades. Se considera un algoritmo tipo ‘b’ — contabiliza de forma aproximada el transporte de electrones secundarios (Knöös et al., 2006; Van Esch et al., 2006).

Sin embargo, el tratamiento del transporte electrónico no es explícito — utiliza dispersión lateral en lugar de la dispersión dirigida de los kernels puntuales. Esto puede causar sobreestimación de dosis dentro y debajo de heterogeneidades de baja densidad para campos pequeños en haces de alta energía (Fogliata et al., 2007).

La Figura 28.21 ilustra el problema: para un haz de 15 MV con campo de 2,8 cm × 14 cm atravesando 10 cm de pulmón ($\rho = 0,2$), los algoritmos tipo ‘a’ no detectan la falta de equilibrio electrónico. Los tipo ‘b’ (CCC) concuerdan con Monte Carlo. El AAA queda en posición intermedia. Para una visión completa, consulte nuestra guía completa sobre algoritmos de cálculo de dosis por fotones.

A pesar de esta limitación, el AAA es de 4 a 10 veces más rápido que un algoritmo CCC típico (Hasenbalg et al., 2007; Han et al., 2011). Para casos donde es menos preciso, la alternativa en Eclipse es el algoritmo Acuros XB.

Pencil Beam para Electrones: Modelo Fermi–Eyges

El concepto pencil beam se aplica también a partículas cargadas, pero la física cambia radicalmente. Los electrones interactúan «inmediata» y «continuamente» al entrar en el medio. El modelo de Hogstrom (1981), basado en la teoría de Fermi–Eyges, proporciona la probabilidad de encontrar el electrón en la profundidad $z$ con desplazamiento lateral $(x,y)$:

$$p(x,y,z) = \frac{1}{2\pi \sigma_{MCS}^2} \exp\left(-\frac{x^2 + y^2}{2\sigma_{MCS}^2}\right) \quad (29.1)$$

Donde $\sigma_{MCS}^2 = \frac{1}{2} \int_0^z (z-u)^2 T(u) du$ es la dispersión coulombiana múltiple acumulada.

Limitaciones críticas

La limitación más seria es la aproximación del rayo central: cada pencil se corrige para heterogeneidades solo según el material a lo largo de su rayo central, equivalente a asumir un fantoma en capas. Además, la teoría predice $\sigma_{MCS}(z)$ creciente continuamente, mientras que el comportamiento real muestra un máximo seguido de disminución. Estas limitaciones impulsaron el desarrollo de métodos Monte Carlo para cálculo de dosis en electrones.

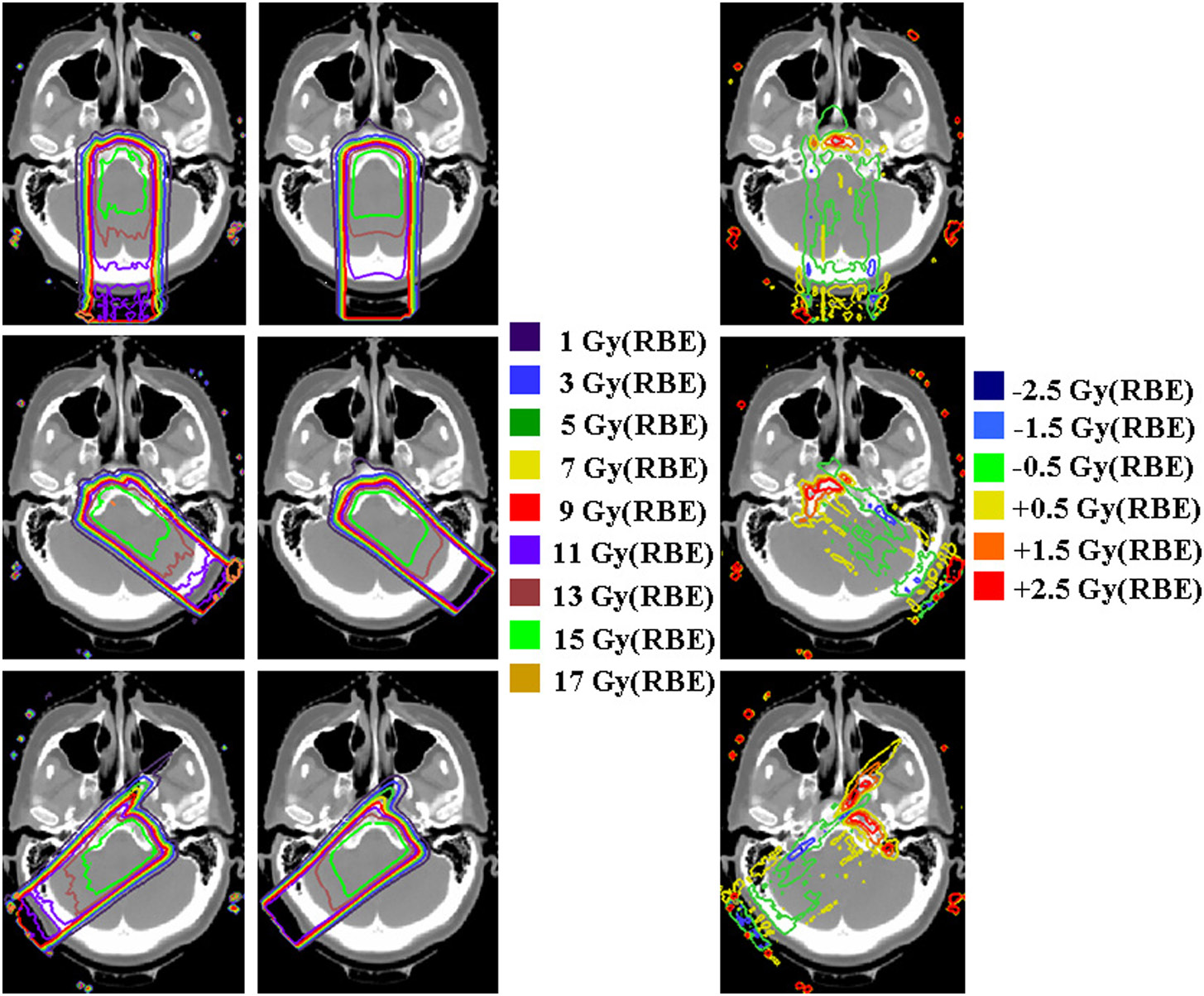

Pencil Beam para Protones

Los haces de protones de alta energía siguen principios análogos. El método más simple, ray tracing, solo contabiliza cambios en el alcance sin predecir efectos laterales. El pencil beam mejora sustancialmente la modelización al incluir la dispersión lateral, capturando la «degradación» del pico de Bragg causada por estructuras heterogéneas.

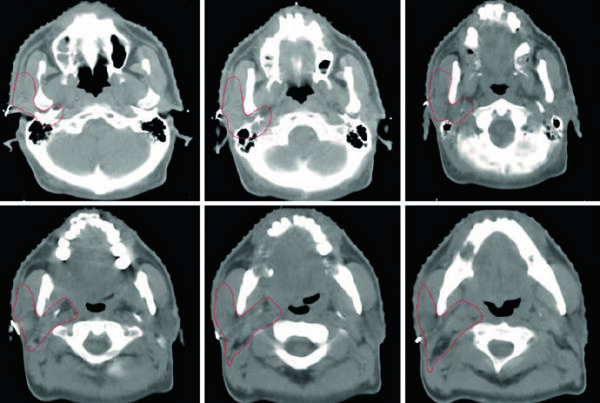

Comparaciones entre Eclipse, XiO y Pinnacle para casos de meningioma (Doolan et al., 2015) demuestran diferencias clínicamente relevantes entre algoritmos, especialmente en interfaces hueso-tejido blando.

Comparación entre Algoritmos Comerciales

| Característica | Pencil Beam | Fast Pencil Beam | AAA | CCC | Monte Carlo |

|---|---|---|---|---|---|

| Clasificación | Tipo ‘a’ | Tipo ‘a’ (simplificado) | Tipo ‘b’ (intermedio) | Tipo ‘b’ | Referencia |

| Transporte e⁻ secundarios | No explícito | No explícito | Aproximado (dispersión lateral) | Sí (vía kernels) | Sí (explícito) |

| Heterogeneidades | Escalado en profundidad | Escalado simplificado | Escalado anisotrópico (recursivo) | Density scaling 3D | Transporte completo |

| Error en pulmón (18 MV) | Hasta 14% | >14% (heterogeneidades críticas) | Intermedio (~5-8%) | ~2-3% | <1% (referencia) |

| Velocidad relativa | Muy rápido (FFT) | Ultra-rápido (lookup tables) | Rápido | 4-10× más lento que AAA | Muy lento |

| Uso principal | Cálculo final en casos simples | Motor de optimización inversa | Cálculo final (Eclipse) | Cálculo final (Pinnacle, XiO) | Referencia / cálculo final |

| TPS comerciales | Eclipse, Helax-TMS | Eclipse (optimizador IMRT/VMAT) | Eclipse (Varian) | Pinnacle, XiO, TMS | Monaco, iPlan |

Fuente: Compilado del Handbook of Radiotherapy Physics, 2nd Ed. (CRC Press, 2020)

La elección del algoritmo depende del escenario clínico. Para planificaciones de rutina sin grandes heterogeneidades, pencil beam o AAA ofrecen precisión adecuada con velocidad superior. El Fast Pencil Beam desempeña un papel fundamental entre bastidores en la optimización inversa, pero nunca debe utilizarse como cálculo de dosis final. En regiones torácicas con campos pequeños y haces de alta energía, algoritmos tipo ‘b’ como CCC — o soluciones model-based como Acuros XB o Monte Carlo — son fuertemente recomendados.

Para una visión completa de toda la trayectoria de los algoritmos de cálculo de dosis — desde los métodos empíricos hasta Monte Carlo y Acuros — consulte nuestra guía completa sobre algoritmos de cálculo de dosis por fotones.