Radiólogos e IA No Logran Identificar Rayos X Generados por IA

Un estudio publicado en la revista Radiology, conducido por investigadores de la Icahn School of Medicine at Mount Sinai en Nueva York, revela que tanto radiólogos como modelos avanzados de inteligencia artificial tienen dificultades significativas para distinguir rayos X auténticos de imágenes generadas por IA. Los resultados plantean preocupaciones serias sobre la integridad clínica y la ciberseguridad en entornos de diagnóstico por imagen.

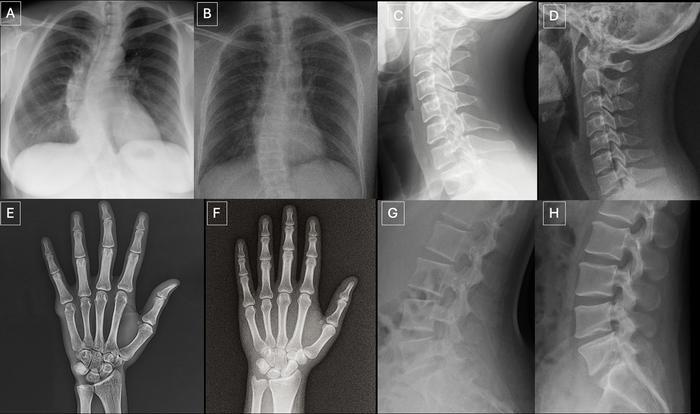

La investigación evaluó a 17 radiólogos de 12 centros en seis países, quienes revisaron 264 imágenes, la mitad de las cuales eran sintéticas. El conjunto de datos incluyó imágenes generadas por sistemas basados en ChatGPT, así como RoentGen, un modelo de difusión desarrollado por Stanford Medicine.

Solo el 41% de los Radiólogos Identificaron Imágenes Falsas Sin Aviso

Cuando los radiólogos no fueron informados de que se incluían imágenes sintéticas, solo el 41% las identificó espontáneamente. Tras ser advertidos, la exactitud promedio subió al 75%, con desempeño individual variando entre 58% y 92%. Curiosamente, el nivel de experiencia no se correlacionó con la exactitud en la detección, aunque los especialistas en musculoesquelético mostraron mejor desempeño que las demás subespecialidades.

Este resultado es preocupante porque sugiere que en la práctica clínica rutinaria — donde no hay expectativa de que las imágenes puedan ser falsas — la tasa de detección sería extremadamente baja. La mayoría de los radiólogos simplemente no esperaría encontrar una imagen sintética en su PACS.

Los Modelos de IA También Fallaron en la Detección

Los modelos multimodales de lenguaje evaluados — GPT-4o, GPT-5, Gemini 2.5 Pro y Llama 4 Maverick — alcanzaron tasas de detección entre 57% y 85%, con variabilidad comparable a la de los radiólogos humanos. El dato más alarmante: incluso el modelo que generó algunas de las imágenes fue incapaz de identificarlas consistentemente. Esto indica que la tecnología de generación ya superó la capacidad de detección de los propios creadores.

La cuestión se conecta directamente con hallazgos previos sobre IA capaz de detectar informes de radiología generados por IA — si los informes textuales ya presentan desafíos de autenticidad, las imágenes diagnósticas representan un riesgo aún mayor.

Riesgos Clínicos y Jurídicos

El autor principal, Dr. Mickael Tordjman, investigador posdoctoral en Mount Sinai, alertó sobre posibles usos maliciosos. «Esto crea una vulnerabilidad de alto riesgo para litigios fraudulentos si, por ejemplo, una fractura fabricada pudiera ser indistinguible de una real», afirmó. También advirtió sobre riesgos de ciberseguridad si imágenes manipuladas fueran introducidas en sistemas clínicos.

Los escenarios de riesgo incluyen:

- Fraude de seguros: imágenes sintéticas de lesiones inexistentes para obtener reembolsos indebidos

- Litigio médico fraudulento: fabricación de evidencia radiológica de errores médicos

- Sabotaje clínico: inserción de imágenes falsas en expedientes para comprometer diagnósticos

- Manipulación de ensayos clínicos: contaminación de datasets de investigación con datos sintéticos

Patrones Visuales y Salvaguardas Propuestas

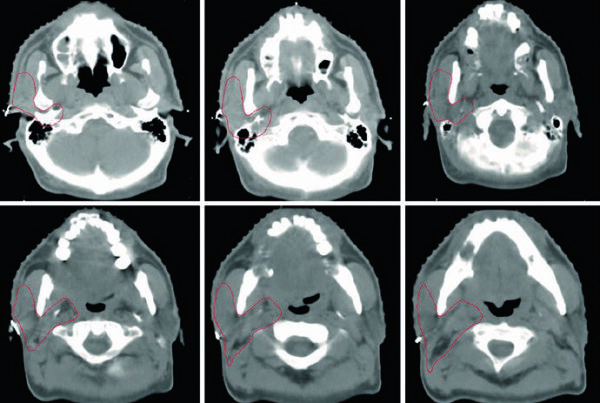

El estudio identificó patrones visuales recurrentes en imágenes sintéticas: huesos excesivamente lisos, campos pulmonares demasiado simétricos y estructuras vasculares inusualmente uniformes. Aunque útiles como pistas, estos artefactos tienden a desaparecer a medida que los modelos generativos evolucionan.

Los autores recomiendan salvaguardas técnicas como marcas de agua integradas y firmas criptográficas en el punto de captura de la imagen — esencialmente garantizando que cada imagen lleve una prueba de origen que no pueda ser falsificada. También abogan por la expansión de datasets de entrenamiento y herramientas de detección especializadas.

Implicaciones para PACS y Flujos de Trabajo

Para administradores de sistemas de imagen y especialistas en informática médica, el estudio refuerza la importancia de protocolos de autenticación de imagen integrados al PACS. Mecanismos como DICOM Digital Signatures y blockchain para trazabilidad de imágenes, aún poco adoptados, ganan relevancia ante la amenaza concreta de deepfakes radiológicos. El panorama de recursos en radiología para 2026 debería incorporar herramientas de verificación de autenticidad como componente esencial.

Perspectivas: Una Carrera Armamentista Digital

El estudio sugiere que estamos al inicio de una carrera armamentista entre generación y detección de imágenes médicas sintéticas. A medida que los modelos de difusión y los LLM multimodales se sofistican, la capacidad de crear imágenes radiológicas indistinguibles de las reales tenderá a aumentar. La respuesta deberá combinar soluciones técnicas (marcas de agua, criptografía), regulatorias (estándares de autenticación obligatorios) y educativas (capacitación de radiólogos para reconocer artefactos sintéticos).

Fuente: DOTmed Healthcare Business News