Collapsed Cone Convolution: la física detrás del cálculo de dosis moderno

El algoritmo Collapsed Cone Convolution (CCC) representa uno de los avances más significativos en el cálculo de dosis para radioterapia con fotones. Propuesto por Ahnesjö en 1989, el CCC resuelve un problema práctico que desafiaba a los físicos médicos: ¿cómo calcular dosis con precisión en medios heterogéneos sin el costo computacional prohibitivo de la superposición completa punto a punto? La respuesta está en la combinación inteligente de kernels de deposición de energía con una aproximación geométrica que colapsa la energía transportada en conos discretos. Para una visión completa de los algoritmos de cálculo de dosis, desde los métodos empíricos hasta Monte Carlo, consulte nuestra guía completa sobre algoritmos de cálculo de dosis por fotones.

En este artículo presentamos un análisis exhaustivo de los tres artículos fundamentales que definieron el CCC: los kernels de deposición de energía generados por Monte Carlo (Mackie et al., 1988), el método de convolución con conos colapsados (Ahnesjö, 1989) y la implementación práctica en sistema de planificación (Cho et al., 2012). También discutiremos las implementaciones comerciales en sistemas como Pinnacle (Philips), Oncentra (Elekta) y RayStation (RaySearch), y compararemos el CCC con otros algoritmos de cálculo de dosis.

En Este Artículo

- 1. Contexto Histórico: Por Qué el CCC Fue Necesario

- 2. Mackie 1988: Kernels Monte Carlo con EGS

- 3. Representación Analítica y Kernels Polienergéticos

- 4. Ahnesjö 1989: El Método Collapsed Cone

- 5. Divergencia del Haz e Inclinación de los Kernels

- 6. Scaling por Densidad y Heterogeneidades

- 7. Cho 2012: Implementación Práctica con Modelo de Tres Fuentes

- 8. Implementaciones Comerciales en TPS

- 9. Tabla Comparativa: CCC vs Pencil Beam vs AAA vs Monte Carlo

- 10. Limitaciones y Escenarios Críticos

- 11. Consideraciones Finales

Contexto Histórico: Por Qué el CCC Fue Necesario

En la década de 1980, el cálculo de dosis para radioterapia dependía de métodos empíricos basados en tablas de porcentaje de dosis en profundidad (PDD) y perfiles laterales medidos en agua. Estos métodos — como el algoritmo de Clarkson para integración de campos irregulares — funcionaban razonablemente para geometrías simples en medios homogéneos, pero no podían manejar la realidad anatómica de los pacientes. Tejido pulmonar, cavidades de aire, hueso cortical e implantes metálicos alteran profundamente el transporte de radiación, y los métodos empíricos aplicaban solo correcciones burdas de razón tejido-aire (TAR) o razón tejido-fantoma (TPR).

El problema fundamental era conceptual. En un medio homogéneo de agua, la dosis en cualquier punto puede calcularse por convolución: la fluencia de fotones primarios se convoluciona con un kernel que describe cómo la energía se redistribuye después de cada interacción. Mackie et al. (1985) formalizaron esto matemáticamente. Sin embargo, en medios heterogéneos, el kernel cambia de punto a punto — dependiendo de la densidad y composición del tejido entre el punto de interacción y el punto de deposición. La convolución simple se transforma en superposición, y el costo computacional sube de $n^3$ a $n^6$ operaciones, donde $n$ es el número de voxels por dimensión.

La simulación Monte Carlo completa resolvía el problema con precisión, pero en 1989 una planificación típica llevaría horas o días en el hardware disponible. Los clínicos necesitaban algo intermedio: un algoritmo que capturara la física del transporte de energía en medios heterogéneos, pero que se ejecutara en minutos. El CCC de Ahnesjö llenó ese vacío con una solución elegante — reduciendo la complejidad a $n^4 \times m$ operaciones mediante la aproximación de conos colapsados, sin sacrificar significativamente la precisión dosimétrica.

Mackie 1988: Generación de Kernels por Monte Carlo con EGS

Los kernels de deposición de energía — también llamados energy deposition point kernels o dose spread arrays — son la pieza central de cualquier algoritmo de convolución/superposición. Describen cómo la energía se distribuye en el espacio alrededor de un punto de interacción primaria de fotones. El trabajo seminal de T.R. Mackie, J.W. Scrimger, J.J. Battista (1988) estableció el método estándar para generar estos kernels usando simulación Monte Carlo.

Geometría de simulación

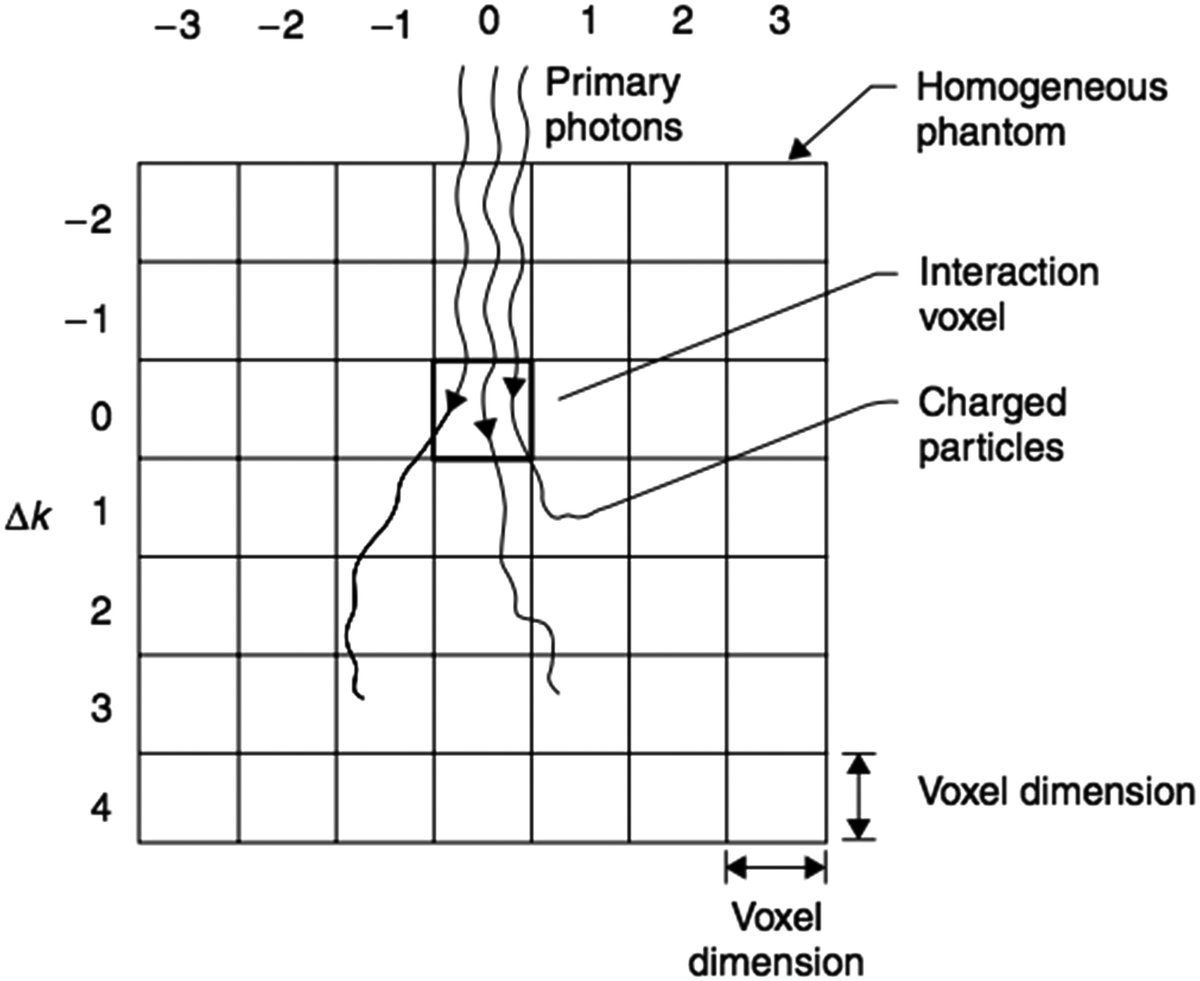

Mackie y colaboradores utilizaron el código Monte Carlo EGS (Electron Gamma Shower) con un código de usuario llamado SCASPH para simular el transporte de partículas en un fantoma esférico homogéneo de agua. La geometría se dividía en:

- Conos angulares de 3,75° de apertura (48 conos cubriendo 180°)

- 24 capas radiales concéntricas con espaciados crecientes

- Interacción forzada en el centro exacto de la esfera

Fotones monoenergéticos eran forzados a interactuar en el centro de la esfera. A partir de esa interacción primaria, todas las partículas secundarias — electrones Compton, pares electrón-positrón, fotoelectrones, electrones de aniquilación y fotones de bremsstrahlung — eran rastreadas hasta perder toda su energía cinética o escapar del fantoma. La energía depositada en cada voxel (definido por la intersección cono-capa) se registraba y acumulaba a lo largo de miles de historias.

Kernels para diferentes órdenes de scattering

Una contribución fundamental del trabajo de Mackie fue la descomposición de los kernels por orden de scattering:

- Kernel primario ($K_p$): energía depositada por partículas cargadas generadas en la interacción primaria (Compton, efecto fotoeléctrico, producción de pares)

- Kernel de primer scattering ($K_{s1}$): energía depositada después de una única interacción de dispersión del fotón secundario

- Kernel de segundo scattering ($K_{s2}$): después de dos interacciones de dispersión

- Kernel de scattering múltiple ($K_{sm}$): todos los órdenes superiores

- Kernel de bremsstrahlung y aniquilación ($K_{ba}$): fotones generados por estos procesos

Los kernels fueron calculados para fotones monoenergéticos de 0,1 a 50 MeV. Además de los kernels de deposición, el trabajo también caracterizó el transporte de partículas primarias mediante parámetros como centro efectivo del voxel, profundidad de penetración, radio efectivo y distancia lateral efectiva. Estos datos sirvieron como base de datos fundamental para todos los algoritmos de convolución/superposición posteriores, incluyendo el CCC.

Integrales de normalización

El kernel total puede descomponerse en componentes primaria y de dispersión. Las integrales de normalización satisfacen:

$$\iiint K_p(\mathbf{r})\,dV = \frac{\mu_{en}}{\mu}$$

$$\iiint K_s(\mathbf{r})\,dV = \frac{\mu – \mu_{en}}{\mu}$$

Donde $\mu$ es el coeficiente de atenuación lineal total y $\mu_{en}$ es el coeficiente de absorción lineal de energía. Estas relaciones son fundamentales para la verificación de los kernels generados y para la aplicación de correcciones de calidad del haz en implementaciones clínicas.

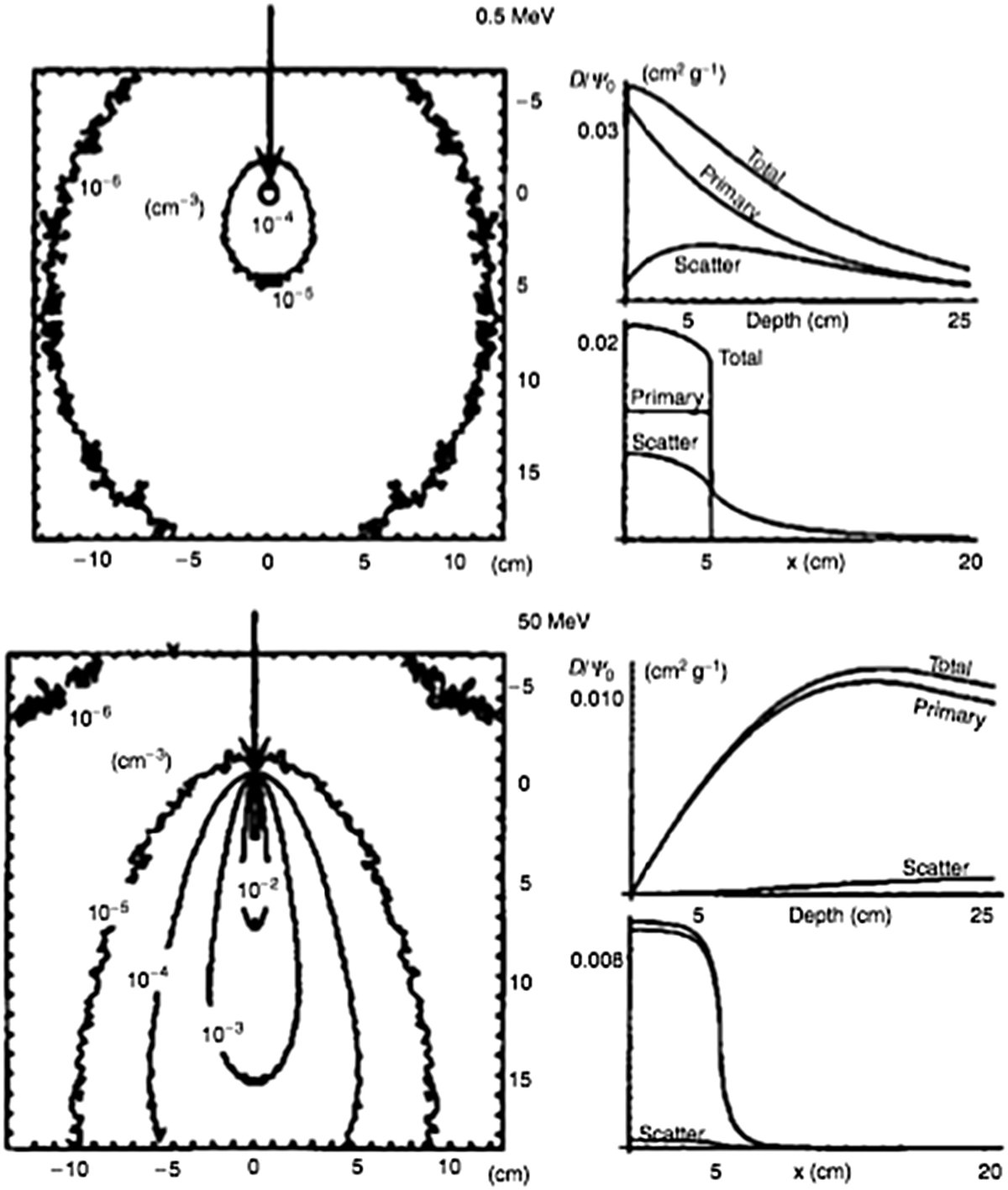

Dependencia con la energía

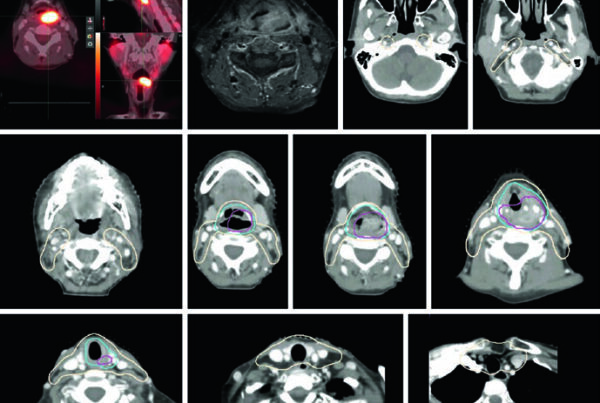

La figura ilustra kernels para 0,5 MeV y 50 MeV. La diferencia es dramática. A bajas energías (por debajo de 1 MeV), la contribución de fotones dispersados domina y el kernel es relativamente isotrópico — la energía se distribuye casi uniformemente en todas las direcciones. A altas energías (por encima de 10 MeV), el transporte de electrones se vuelve dominante y altamente direccional: la energía se deposita preferentemente en la dirección forward (misma dirección del fotón incidente), con alcances laterales significativos de los electrones secundarios.

Este cambio de comportamiento con la energía tiene consecuencias prácticas profundas. Para haces de 6 MV, donde la energía media del espectro está alrededor de 2 MeV, los kernels son moderadamente anisotrópicos y la corrección por heterogeneidades tiene importancia intermedia. Para haces de 15-18 MV, los kernels son fuertemente anisotrópicos y las fallas de algoritmos simples en pulmón y cavidades de aire se vuelven clínicamente relevantes. El CCC, al transportar energía a lo largo de direcciones discretas con scaling por densidad, captura esta anisotropía de forma significativamente mejor que los algoritmos tipo pencil beam.

Representación Analítica y Kernels Polienergéticos

Trabajar directamente con kernels tabulados para cada energía en cada ángulo es computacionalmente costoso y dificulta el cálculo recursivo. Ahnesjö y Mackie (1987) propusieron un ajuste analítico que viabilizó el CCC:

$$K(r, \theta) = \frac{A_\theta\, e^{-a_\theta r} + B_\theta\, e^{-b_\theta r}}{r^2}$$

Donde:

- $r = |\mathbf{r} – \mathbf{r}’|$ es la distancia entre el punto de interacción $\mathbf{r}’$ y el punto de deposición $\mathbf{r}$

- $\theta$ es el ángulo respecto a la dirección del fotón incidente

- $A_\theta, a_\theta, B_\theta, b_\theta$ son parámetros de ajuste que dependen de $\theta$ y del espectro energético

- El factor $1/r^2$ compensa la dispersión geométrica desde una fuente puntual

- La primera exponencial describe principalmente la deposición primaria (corto alcance); la segunda, la componente de dispersión (largo alcance)

La elegancia de esta formulación reside en la posibilidad de cálculo recursivo. Si conocemos la dosis acumulada hasta la posición $r_i$ a lo largo de una línea, la contribución hasta $r_{i+1} = r_i + \Delta r$ puede obtenerse multiplicando por la exponencial correspondiente — sin recalcular toda la integral. Esta propiedad es lo que hace al CCC computacionalmente viable.

Kernels polienergéticos para haces clínicos

Los haces clínicos no son monoenergéticos. Un haz de 6 MV contiene fotones de 0 a 6 MeV con energía media alrededor de 2 MeV. Además, el espectro cambia con la profundidad (endurecimiento del haz) y con la posición lateral (ablandamiento fuera del eje). Existen dos enfoques principales:

- Suma ponderada por espectro: kernels polienergéticos se generan por suma ponderada de los kernels monoenergéticos de Mackie, usando los pesos del espectro de fluencia incidente. Es el método más directo.

- Interpolación por profundidad: Liu et al. (1997) propusieron pre-calcular kernels polienergéticos en tres profundidades distintas (superficial, intermedia, profunda) e interpolar durante el cálculo. Esto compensa automáticamente el endurecimiento del haz sin necesidad de recalcular el espectro en cada punto.

Una alternativa refinada consiste en convolver separadamente los kernels primario y de dispersión con las respectivas fracciones TERMA: $\mu_{en}/\mu$ para el primario y $(\mu – \mu_{en})/\mu$ para la dispersión. Como cada componente es afectada de forma diferente por el cambio espectral, esta separación mejora la precisión sin costo computacional significativo.

Ahnesjö 1989: El Método Collapsed Cone Convolution

El artículo de Anders Ahnesjö, publicado en 1989 en la revista Medical Physics, es el trabajo fundacional del CCC. Ahnesjö propuso una solución elegante al problema de la superposición en medios heterogéneos, combinando tres innovaciones: ray-tracing para TERMA, kernels polienergéticos analíticos y la aproximación de cono colapsado.

Cálculo de la TERMA por ray-tracing

La TERMA (Total Energy Released per unit MAss) describe la energía total liberada por fotones en cada punto del volumen. Ahnesjö calculó la TERMA trazando rayos desde la fuente de fotones a través del volumen del paciente:

$$T(\mathbf{r}’) = \Psi(\mathbf{r}’) \cdot \frac{\mu(\mathbf{r}’)}{\rho(\mathbf{r}’)}$$

Donde $\Psi(\mathbf{r}’)$ es la fluencia energética en el punto $\mathbf{r}’$ (calculada por ray-tracing con atenuación exponencial) y $\mu/\rho$ es el coeficiente másico de atenuación del tejido en ese punto. La fluencia se atenúa a lo largo del camino considerando la composición y densidad del tejido — heterogeneidades como pulmón, hueso y aire alteran tanto la atenuación como la TERMA resultante.

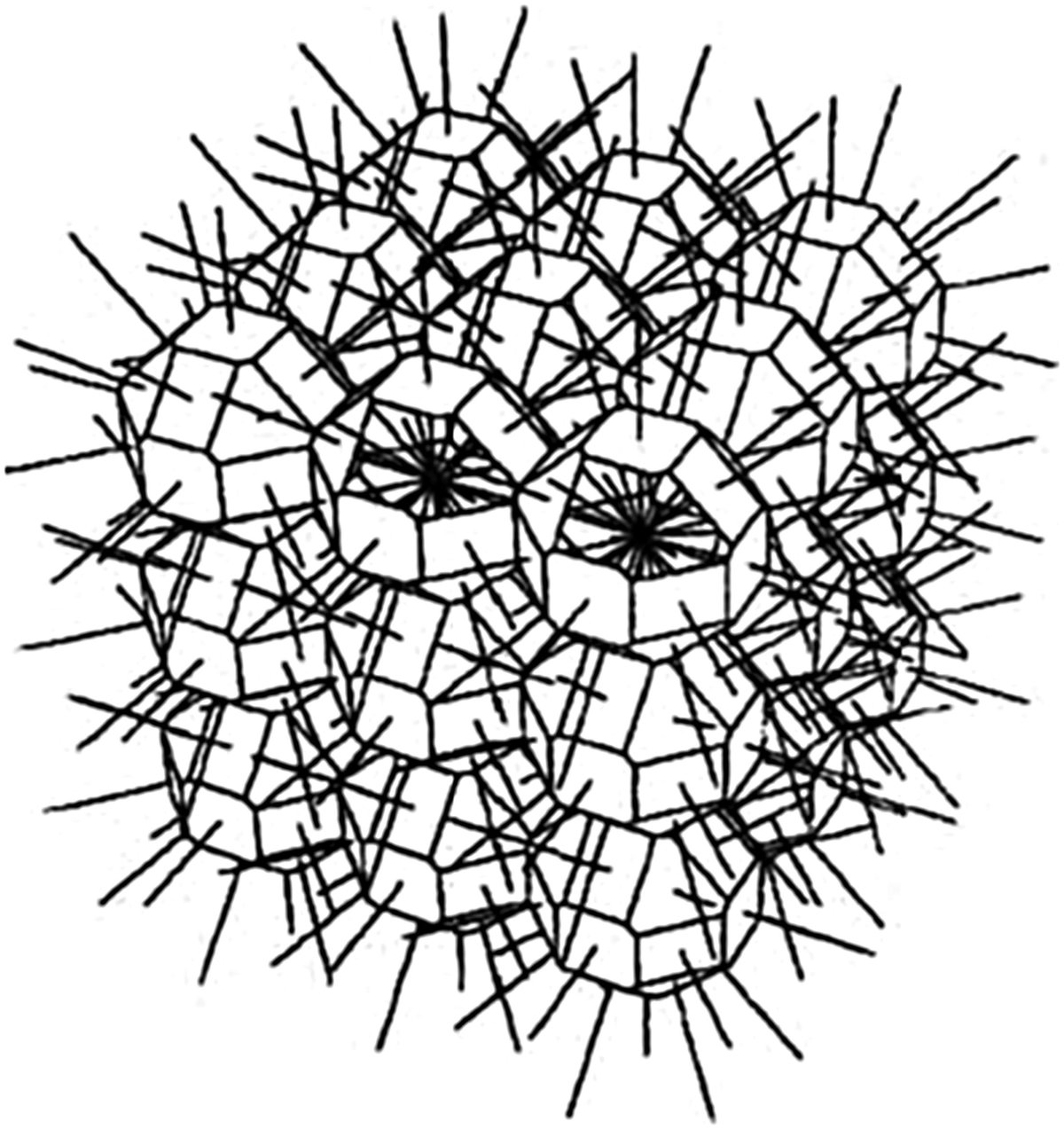

La aproximación de cono colapsado

La superposición directa requiere integrar la contribución de todos los $n^3$ voxels de interacción para cada uno de los $n^3$ voxels de deposición — $n^6$ operaciones en total, subiendo a $n^7$ con scaling variable. El CCC resuelve esto discretizando el espacio angular en $m$ direcciones fijas (típicamente 13 ejes generando 26 sentidos, o versiones más refinadas con 48 o más direcciones).

Para cada una de esas $m$ direcciones, toda la energía de un cono sólido con ángulo sólido $\Omega$ se colapsa (proyecta) sobre la línea central del cono. La energía se transporta y deposita paso a paso a lo largo de esa línea, usando la formulación analítica del kernel. En cada paso, el cálculo considera la densidad radiológica local para escalar el kernel.

La ecuación de deposición a lo largo de una dirección de cono $\hat{\Omega}_j$ puede escribirse como:

$$D_j(\mathbf{r}) = \sum_{i} T(\mathbf{r}_i’) \cdot \Delta V_i \cdot \frac{\Omega_j}{4\pi} \cdot \frac{A_\theta e^{-a_\theta d_{\rho}} + B_\theta e^{-b_\theta d_{\rho}}}{d_{\rho}^2}$$

Donde $d_{\rho}$ es la distancia radiológica (escalada por densidad) entre $\mathbf{r}_i’$ y $\mathbf{r}$, y $\Omega_j/4\pi$ es la fracción del ángulo sólido cubierta por el cono $j$. La dosis total es la suma sobre todas las direcciones:

$$D(\mathbf{r}) = \sum_{j=1}^{m} D_j(\mathbf{r})$$

Gracias a la forma exponencial de los kernels, el transporte a lo largo de cada línea puede calcularse recursivamente. Si designamos $E_j(\mathbf{r}_k)$ como la energía acumulada que llega al voxel $k$ a lo largo de la dirección $j$, la contribución del voxel siguiente $k+1$ se obtiene por:

$$E_j(\mathbf{r}_{k+1}) = E_j(\mathbf{r}_k) \cdot e^{-a_\theta \Delta d_{\rho}} + T(\mathbf{r}_k) \cdot \Delta V_k \cdot \frac{\Omega_j}{4\pi}$$

Esta recursión reduce el número total de operaciones a $n^4 \times m$, donde $n^3$ son los voxels y $n$ es la longitud típica de las líneas de transporte. En la práctica, con $m \sim 26$ a $48$ direcciones y grids de $128^3$ a $256^3$ voxels, el cálculo completo toma de segundos a pocos minutos en hardware moderno.

Conservación de energía en el CCC

La aproximación de cono colapsado preserva la conservación de energía por construcción. Toda la energía emitida en cada ángulo sólido se atribuye a la línea central del cono correspondiente. No hay pérdida ni ganancia neta — la energía total depositada en el volumen es igual a la energía total liberada (TERMA integrada), respetando las fracciones de escape cuando la energía sale del volumen del paciente.

Validación original

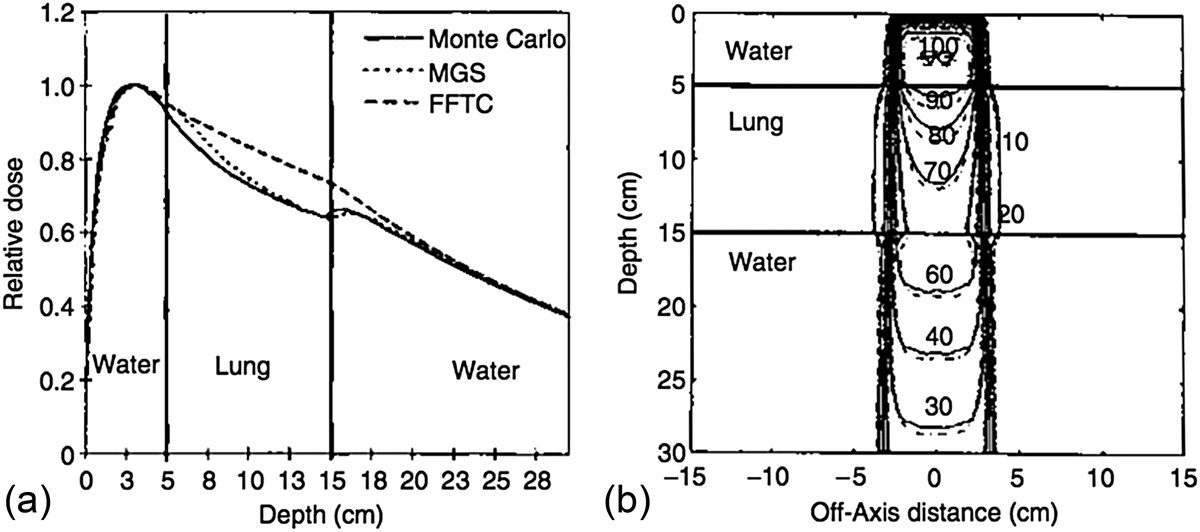

Ahnesjö validó el CCC para potenciales de aceleración de 4, 6, 10, 15 y 24 MeV en dos geometrías:

- Pila de capas de tejidos: agua + pulmón + agua, probando la capacidad del CCC de manejar interfaces de densidad

- Fantoma mediastinal: corcho (simulando pulmón) y agua, reproduciendo una geometría clínicamente relevante

Las distribuciones de dosis calculadas por el CCC fueron comparadas con simulaciones de referencia usando el código Monte Carlo EGS4. La concordancia fue excelente en ambas geometrías y en todo el rango de energía probado. Ahnesjö demostró que el número de operaciones es proporcional al número de puntos de cálculo — estableciendo viabilidad clínica. El artículo original señala que el CCC puede modelar tanto el transporte lateral de electrones en interfaces como la atenuación diferencial en medios de densidades distintas, superando a los algoritmos basados en corrección primario-dispersión disponibles en la época.

Divergencia del Haz e Inclinación de los Kernels

Un haz clínico real diverge desde la fuente. Esta divergencia modifica no solo la fluencia (ley del inverso del cuadrado), sino también la dirección de los kernels: rigurosamente, los kernels fuera del eje deben inclinarse para acompañar la divergencia. En la práctica, Sharpe y Battista (1993) demostraron que, para la mayoría de los casos clínicos, mantener los kernels paralelos al eje central es aceptable.

¿Cuándo deja de funcionar? A distancias fuente-superficie cortas, campos grandes y altas energías. Sustituir un kernel inclinado por uno paralelo aumenta su contribución al eje del haz, sobreestimando el PDD on-axis. Papanikolaou et al. (1993) y Liu et al. (1997) propusieron como compensación aplicar la corrección del inverso del cuadrado en los puntos de deposición en lugar de en los puntos de interacción primaria. Ahnesjö et al. (2005) adoptaron un enfoque más explícito: usar la forma analítica de los kernels con parámetros de ajuste dependientes del ángulo de inclinación.

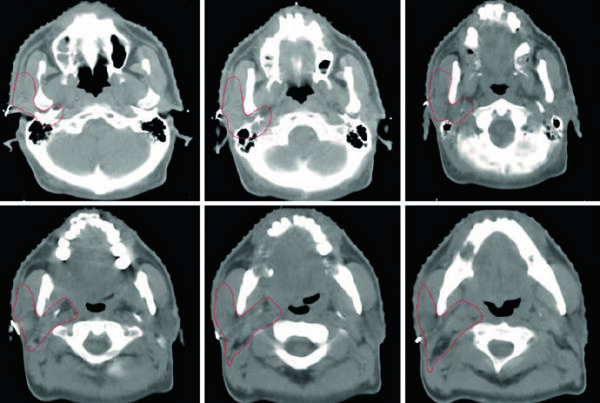

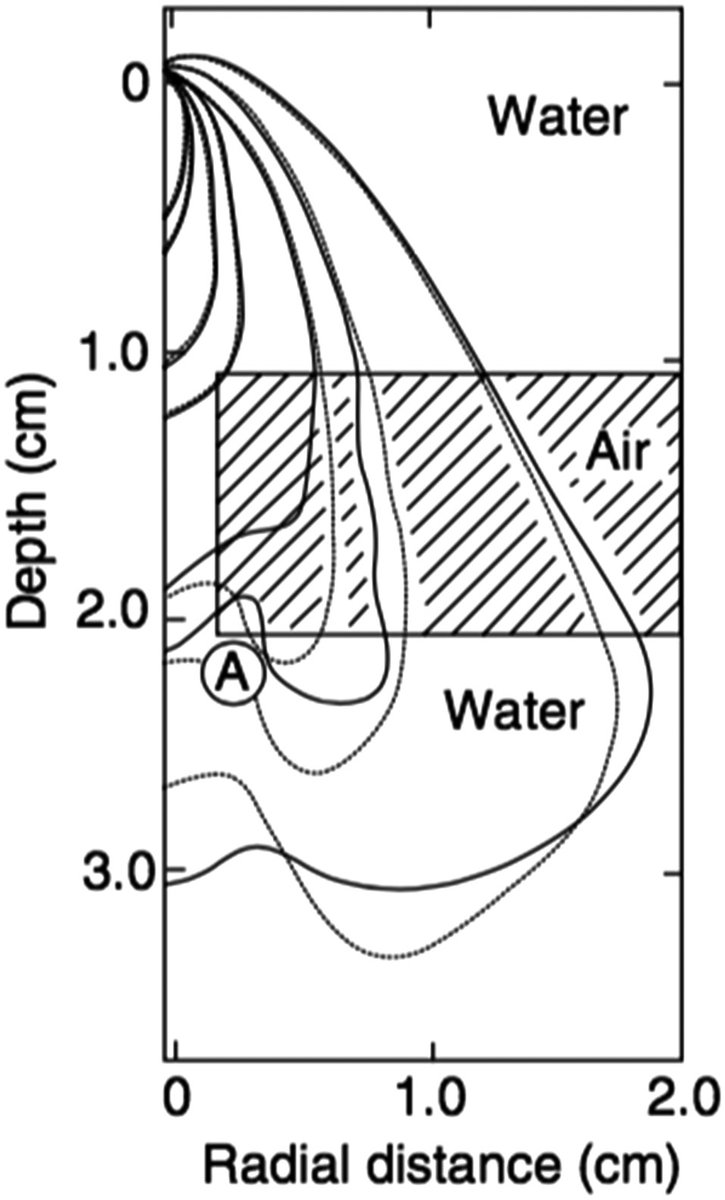

Scaling por Densidad y Heterogeneidades Tisulares

El tratamiento de heterogeneidades es donde el CCC se diferencia fundamentalmente de los algoritmos más simples. Si el medio tiene densidad diferente del agua, el teorema de O’Connor permite obtener la misma distribución de dosis escalando todas las dimensiones del fantoma proporcionalmente. En la práctica, esto equivale a sustituir todas las distancias en la ecuación de convolución por las distancias radiológicas equivalentes.

La ecuación general de convolución en medio homogéneo es:

$$D(\mathbf{r}) = \iiint T(\mathbf{r}’) \cdot K(\mathbf{r} – \mathbf{r}’)\,d^3\mathbf{r}’$$

En medios heterogéneos, las distancias se escalan según la densidad local. Tres regiones deben considerarse por separado:

- La densidad $\rho_1$ entre la superficie y $\mathbf{r}’$ — que modifica la fluencia $\Psi(\mathbf{r}’)$ y por tanto la TERMA

- La densidad del medio en $\mathbf{r}’$ — que modifica la TERMA vía $\mu/\rho$

- La densidad $\rho_2$ entre $\mathbf{r}’$ y $\mathbf{r}$ — que modifica el kernel a $K(\rho_2 \cdot |\mathbf{r} – \mathbf{r}’|)$

En el CCC, este scaling se aplica naturalmente a lo largo de cada línea de transporte. La distancia radiológica $d_\rho$ acumula la densidad relativa voxel a voxel: $d_\rho = \sum_i \rho_i \cdot \Delta s_i$, donde $\Delta s_i$ es la longitud geométrica en el voxel $i$ y $\rho_i$ es su densidad relativa al agua. Esta acumulación permite que el kernel exponencial se ajuste automáticamente: en pulmón ($\rho \approx 0,3$), la distancia radiológica crece más lentamente que la distancia geométrica, haciendo que el kernel decaiga más lentamente y la energía penetre más profundamente — exactamente lo que ocurre físicamente.

Incluso con scaling completo, la ecuación de convolución en medio heterogéneo permanece aproximada. Para el kernel primario, el scaling rectilíneo no es exacto respecto al scattering múltiple de electrones secundarios. Para el kernel de dispersión, el scaling rectilíneo solo es riguroso para la componente de primer scattering. Mackie et al. (1985) sugirieron separar el kernel de primer scattering del de scattering múltiple, escalando este último con base en un valor de densidad promedio. Como la componente de scattering múltiple es una fracción pequeña de la dosis total, usar el mismo valor de densidad para toda la dispersión también es aceptable en la práctica clínica.

Cho 2012: Implementación Práctica con Modelo de Tres Fuentes

El artículo de Woong Cho, Kwangzoo Chung y colaboradores (2012), publicado en el Journal of the Korean Physical Society, detalla cómo transformar la teoría del CCC en un sistema de planificación funcional. Mientras Ahnesjö definió el framework matemático, Cho demostró los detalles prácticos de la implementación.

Modelo de fluencia con tres fuentes

El primer desafío práctico es determinar la fluencia de fotones que entra en el paciente. Cho utilizó un modelo de tres fuentes:

- Fuente principal (target): fotones de bremsstrahlung generados en el blanco del acelerador lineal. La distribución angular y energética se caracteriza por parámetros ajustados a partir de medidas de PDD y perfiles en agua.

- Dispersión por colimador primario: fotones que interactúan con las mandíbulas y el colimador primario antes de alcanzar al paciente. Contribuyen al ensanchamiento de la fluencia fuera del campo definido.

- Dispersión adicional por el cabezal (gantry): fotones dispersados por el filtro ecualizador, bandeja de accesorios y otras estructuras del cabezal. Contribuyen a la dosis fuera del campo y a la forma de los perfiles laterales.

Este modelo de múltiples fuentes es más preciso que el modelo de fuente puntual simple, especialmente para campos grandes y para reproducir el efecto horn (aumento de la fluencia en los bordes del campo causado por el filtro ecualizador cónico). Los parámetros del modelo se ajustan durante el commissioning del acelerador, usando medidas de PDD, perfiles laterales y factores de output para diferentes tamaños de campo.

Cálculo de la TERMA con efectos físicos

La TERMA en el trabajo de Cho incorpora varios efectos físicos que se ignoran en implementaciones simplificadas:

- Espectro polienergético: la atenuación se calcula usando coeficientes dependientes de la energía, ponderados por el espectro local

- Efecto horn: la variación radial de la fluencia causada por el filtro ecualizador cónico

- Ablandamiento del haz (beam softening): la energía media del espectro disminuye fuera del eje y aumenta con la profundidad

- Transmisión por MLC: la atenuación por las láminas del colimador multilámina, incluyendo transmisión interleaf y tongue-and-groove

- Atenuación en el medio: la reducción exponencial de la fluencia al atravesar el paciente, calculada por ray-tracing voxel a voxel

Convolución con líneas de cono colapsado

La dosis fue calculada por convolución de la TERMA con un kernel polienergético, aproximado por decenas de líneas de conos colapsados. Cho implementó típicamente 26 a 48 direcciones discretas. En cada dirección, la deposición de energía sigue la formulación recursiva descrita en la sección sobre Ahnesjö, con scaling por densidad voxel a voxel.

Validación contra dosimetría de película

La validación experimental de Cho es particularmente relevante porque utiliza dosimetría de película en condiciones realistas:

- PDDs (Percentage Depth Dose): calculados y medidos para campos de 5×5 a 20×20 cm² en energías de 6 y 15 MV

- Perfiles laterales: en múltiples profundidades, verificando penumbra, uniformidad y dosis fuera del campo

- Comparación con pencil beam: el CCC fue comparado también con un algoritmo pencil beam implementado en el mismo sistema

Los resultados mostraron concordancia dentro del 2% entre CCC y medidas de película para la gran mayoría de los puntos, con excepción de la región de build-up. En esta región (primeros milímetros), la modelización empírica de la contaminación electrónica y la transición al equilibrio electrónico son difíciles de capturar analíticamente, resultando en discrepancias mayores. Cho observó que el CCC presentó un desempeño significativamente superior al pencil beam en situaciones con heterogeneidades, confirmando la ventaja teórica prevista por Ahnesjö.

Implementaciones Comerciales en TPS

El CCC fue adoptado por diversos fabricantes de sistemas de planificación de tratamiento (TPS). Cada implementación tiene particularidades, pero todas siguen el framework establecido por Mackie, Ahnesjö y validado por Cho:

Philips Pinnacle³

El Pinnacle fue el primer TPS comercial en implementar el CCC como algoritmo principal de cálculo de dosis. Desarrollado a partir de los trabajos originales de Mackie et al. en la Universidad de Wisconsin, el Pinnacle usa kernels de Mackie con la formulación de cono colapsado de Ahnesjö. Históricamente considerado el «estándar de oro» entre los algoritmos de convolución/superposición, el Pinnacle usa típicamente 26 a 80 direcciones de cono, con opción de aumentar para geometrías complejas.

Elekta Oncentra (ex-Helax-TMS)

El Oncentra Masterplan tiene conexión directa con Ahnesjö, quien participó en el desarrollo del Helax-TMS en Suecia. La implementación sigue fielmente el artículo original de 1989. Cuando Elekta adquirió Nucletron e integró Helax, el CCC del Oncentra se mantuvo como algoritmo de referencia.

RayStation (RaySearch Laboratories)

El RayStation ofrece tanto CCC como Monte Carlo. El CCC del RayStation es una implementación moderna que aprovecha paralelización en múltiples cores y optimizaciones algorítmicas para alcanzar tiempos de cálculo de segundos en grids típicos. Se utiliza frecuentemente como algoritmo de cálculo rápido durante la optimización inversa de IMRT/VMAT, con verificación final por Monte Carlo.

XiO y Monaco (Elekta)

El XiO (originalmente CMS Focus) utilizó CCC como algoritmo principal durante muchos años. El Monaco, sucesor del XiO, migró a Monte Carlo basado en GPU como algoritmo primario, pero aún utiliza principios de convolución/superposición en módulos específicos.

ISOgray (DOSIsoft)

El ISOgray implementa CCC con una formulación cercana a la original de Ahnesjö, siendo ampliamente utilizado en Europa, particularmente en Francia y los países francófonos.

Contaminación electrónica y dosis de salida

La convolución de kernels puntuales abarca todos los voxels del volumen del paciente, permitiendo modelar la oblicuidad de superficie. Sin embargo, la contaminación electrónica proveniente del cabezal y del aire no es capturada por los kernels. Esto se trata mediante una componente empírica adicional, dependiente de SSD, tamaño de campo y distancia off-axis, que decrece exponencialmente desde la superficie hasta el alcance máximo de los electrones contaminantes. En la salida del paciente, como no hay contribución de kernel del aire, existe una ligera sobreestimación de la dosis — un efecto menor en la mayoría de los casos clínicos.

Tabla Comparativa: CCC vs Pencil Beam vs AAA vs Monte Carlo

La tabla siguiente compara los principales algoritmos de cálculo de dosis para fotones disponibles en sistemas de planificación comerciales. La inclusión del AAA (Analytical Anisotropic Algorithm) de Varian y del Acuros XB complementa la comparación con algoritmos ampliamente utilizados en la práctica clínica.

| Característica | Pencil Beam | CCC / Superposición | AAA (Varian) | Acuros XB | Monte Carlo |

|---|---|---|---|---|---|

| Base teórica | Convolución 2D con kernels invariantes | Superposición 3D con conos colapsados | Superposición con kernels anisotrópicos separados | Ecuación de transporte de Boltzmann (LBTE) | Simulación estocástica partícula por partícula |

| Orden de cálculo | $n^3$ (conv. 2D) | $n^4 \times m$ | $n^4 \times m’$ | Determinístico, proporcional a $n^3$ | Estocástico ($N_{hist}$ partículas) |

| Heterogeneidades | Corrección tipo-a (escala profundidad) | Scaling por densidad en 3D | Scaling por densidad con kernels separados | Transporte explícito en multi-material | Transporte explícito, exacto |

| Transporte electrónico lateral | No modela | Aproximado (scaling rectilíneo) | Aproximado (mejor que PB) | Sí (resolución determinística) | Sí (completo) |

| Penumbra en pulmón | Subestima ensanchamiento | Razonable (±3-5%) | Razonable (±2-4%) | Precisa (±1-2%) | Exacta (referencia) |

| Dosis en interfaz aire-tejido | Imprecisa | Buena para mayoría de casos | Buena para mayoría de casos | Precisa | Exacta |

| Build-up | Empírico | Empírico (±2-5%) | Empírico (±2-5%) | Mejor (±1-3%) | Exacto |

| Velocidad típica | Segundos | Segundos a minutos | Segundos a minutos | Minutos | Minutos a horas |

| GPU / paralelización | No necesario | Soportado (RayStation, Monaco) | Soportado (Eclipse) | Sí (Eclipse) | Esencial (Monaco, RayStation) |

| TPS comerciales | Eclipse (PBC, descontinuado) | Pinnacle, Oncentra, RayStation, XiO | Eclipse (Varian) | Eclipse (Varian) | Monaco, RayStation, PRIMO |

*Acuros XB usa el método de transporte determinístico LBTE (Linear Boltzmann Transport Equation), no Monte Carlo puro, pero alcanza precisión comparable en la mayoría de los escenarios clínicos. Para profundizar sobre Monte Carlo, vea nuestra guía sobre Monte Carlo en radioterapia y el artículo sobre aplicaciones de Monte Carlo para fotones.

Limitaciones y Escenarios Críticos del CCC

A pesar de su robustez, el CCC presenta limitaciones conocidas que el físico médico debe considerar:

Falta de equilibrio electrónico en pulmón

En haces de alta energía (15-18 MV) atravesando pulmón, el CCC subestima el ensanchamiento lateral de la penumbra. Arnfield et al. (2000) demostraron discrepancias del 3-5% en regiones donde falta equilibrio de partículas cargadas (CPE). La razón es que el scaling rectilíneo del kernel asume que los electrones secundarios siguen trayectorias rectas escaladas por la densidad — pero en realidad, en tejido de baja densidad, los electrones sufren scattering múltiple y recorren caminos más tortuosos de lo que el modelo predice. Este efecto es más pronunciado para campos pequeños en alta energía.

Región de build-up

Cho et al. (2012) documentaron discrepancias superiores al 2% en la región de build-up. La modelización de la contaminación electrónica es empírica y la transición al equilibrio electrónico es difícil de capturar con la formulación analítica de los kernels. En la práctica clínica, la dosis en el build-up rara vez es el parámetro dosimétrico determinante — pero en tratamientos superficiales o con bolus, esta limitación puede ser relevante.

Interfaces de alta densidad

En interfaces con materiales de alta densidad (prótesis metálicas, implantes dentales, clips quirúrgicos), el CCC puede presentar artefactos de dosis en las primeras capas de tejido después del material denso. El scaling por densidad funciona razonablemente para tejidos biológicos ($\rho$ de 0,001 a 1,85 g/cm³), pero los coeficientes de atenuación de metales difieren significativamente de los del agua, y la composición atómica altera el espectro de partículas secundarias.

Discretización angular

El número de direcciones de cono ($m$) afecta tanto la precisión como el tiempo de cálculo. Con solo 26 direcciones, artefactos de «ray effect» pueden aparecer en regiones distantes del isocentro. Implementaciones modernas usan 48 a 80 direcciones para minimizar estos artefactos, al costo de mayor tiempo de cálculo. La elección del número de direcciones es un compromiso entre resolución angular y velocidad.

Consideraciones Finales

El Collapsed Cone Convolution equilibra precisión y eficiencia de una forma que pocos algoritmos logran. Tres décadas de literatura científica y práctica clínica sustentan su posición como uno de los algoritmos más utilizados en radioterapia.

Los kernels de deposición generados por Monte Carlo (Mackie 1988) proporcionan la base física — sin esos datos cuidadosamente simulados en geometría esférica con el código EGS, ningún algoritmo de convolución sería posible. La formulación analítica polienergética y la aproximación de conos colapsados (Ahnesjö 1989) transformaron el concepto teórico en algoritmo computacionalmente viable, reduciendo la complejidad de $n^6$ a $n^4 \times m$ y demostrando concordancia con EGS4 en geometrías heterogéneas de 4 a 24 MeV. Y las implementaciones prácticas con modelos de múltiples fuentes (Cho 2012) demuestran que el CCC, cuando correctamente comisionado con TERMA realista incluyendo efecto horn, ablandamiento y transmisión MLC, concuerda con medidas de película dentro del 2% para la mayoría de los escenarios clínicos.

Para escenarios desafiantes — pulmón con haces de alta energía, interfaces aire-tejido, campos pequeños sin equilibrio electrónico — el físico médico debe conocer las limitaciones del CCC y considerar algoritmos más sofisticados como Monte Carlo o Acuros XB. Pero para la rutina diaria de la radioterapia, desde 3D-CRT hasta IMRT y VMAT, el CCC sigue siendo una de las opciones más robustas disponibles.

El concepto de superposición y TERMA es fundamental para entender cómo opera el CCC — la TERMA proporciona la distribución de energía total liberada, y el kernel describe cómo esa energía se redistribuye en el medio. Para una visión abarcadora de todos los algoritmos disponibles, consulte nuestro hub sobre algoritmos de cálculo de dosis por fotones.

Referencias Principales

- Mackie TR, Scrimger JW, Battista JJ. A convolution method of calculating dose for 15-MV x rays. Med Phys. 1985;12(2):188-196.

- Mackie TR, Bielajew AF, Rogers DWO, Battista JJ. Generation of photon energy deposition kernels using the EGS Monte Carlo code. Phys Med Biol. 1988;33(1):1-20.

- Ahnesjö A. Collapsed cone convolution of radiant energy for photon dose calculation in heterogeneous media. Med Phys. 1989;16(4):577-592.

- Ahnesjö A, Aspradakis MM. Dose calculations for external photon beams in radiotherapy. Phys Med Biol. 1999;44(11):R99-R155.

- Cho W, Chung K, et al. Practical implementation of a collapsed cone convolution algorithm for a radiation treatment planning system. J Korean Phys Soc. 2012;61(12):2073-2083.

- Arnfield MR, Siantar CH, Siebers J, et al. The impact of electron transport on the accuracy of computed dose. Med Phys. 2000;27(6):1266-1274.