Quando alguém descreve o collapsed cone apenas como “um algoritmo intermediário entre pencil beam e Monte Carlo”, quase sempre está apagando justamente o que fez esse método durar. O CCC não sobreviveu por costume. Ele sobreviveu porque resolveu um problema real da clínica: levar espalhamento tridimensional e heterogeneidade a sério sem jogar o tempo de cálculo para fora da rotina.

Essa é a razão de ele continuar aparecendo em discussões atuais, inclusive dentro de TPS comerciais modernos. A ideia central segue forte: calcular a energia liberada localmente, redistribuí-la com base física consistente e fazer isso rápido o suficiente para que o físico consiga planejar, revisar e otimizar sem transformar cada caso em um experimento computacional.

Vale olhar para o método desse jeito porque o collapsed cone não é só uma etapa histórica. Ele é uma das respostas mais influentes já dadas à tensão permanente entre fidelidade física e viabilidade operacional.

Neste Artigo

- 1. O problema que o CCC veio resolver

- 2. O que a ideia de Ahnesjö faz

- 3. O papel da TERMA

- 4. O papel dos kernels de Mackie

- 5. A forma analítica dos kernels

- 6. O que o handbook ajuda a enxergar

- 7. Por que o ganho computacional foi tão decisivo

- 8. Por que isso foi tão importante em pulmão

- 9. Da literatura para os TPS comerciais

- 10. O elo com o RayStation

- 11. O que o CCC continua ensinando mesmo na era do Acuros e do MC

- 12. O artigo de Cho e a implementação prática

- 13. O que o collapsed cone não é

- 14. Onde ele continua fazendo sentido

O problema que o CCC veio resolver

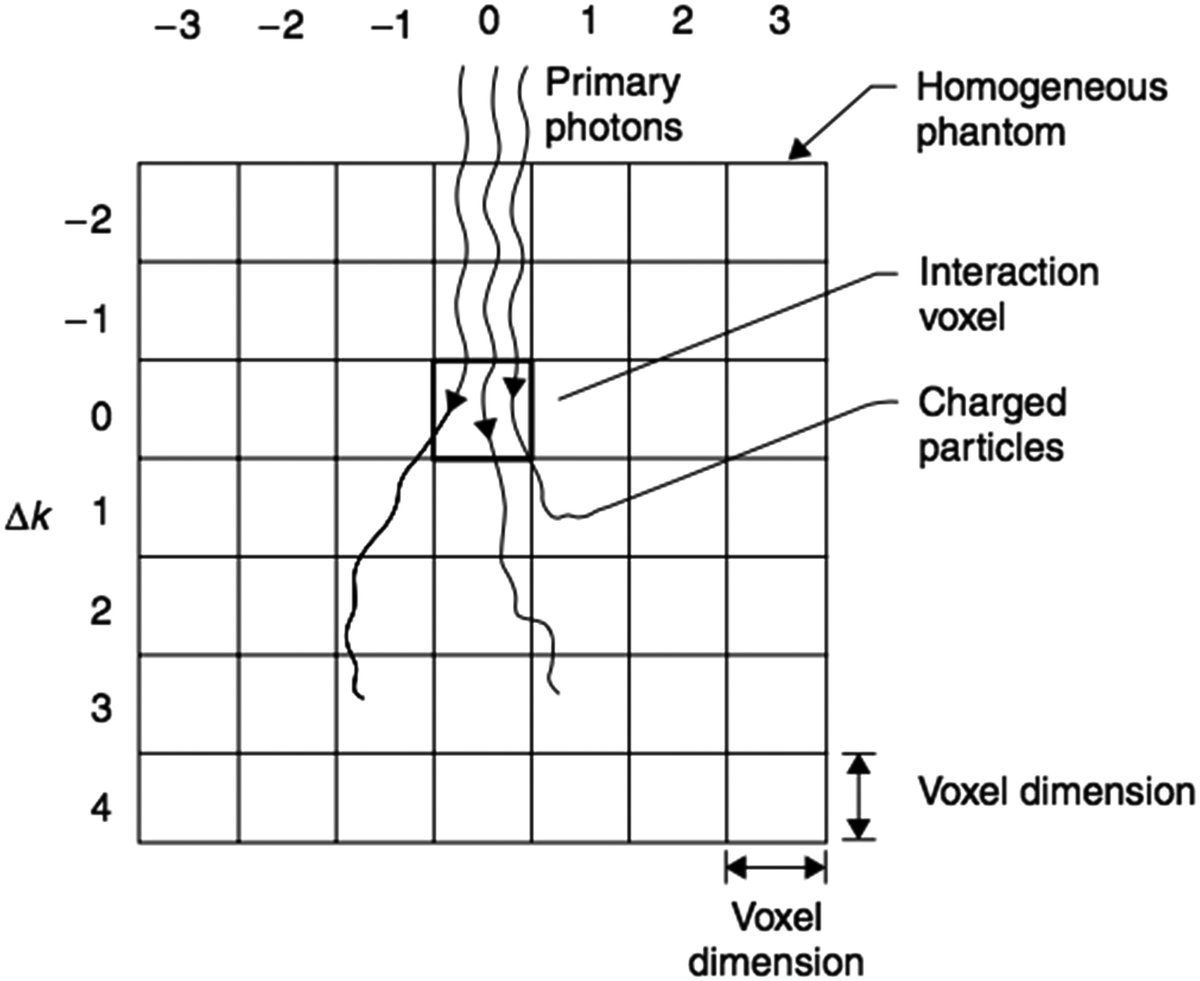

Os métodos de convolução/superposição já representavam um avanço importante sobre os algoritmos mais simplificados de pencil beam. A ideia fundamental era clara: a dose em um ponto pode ser construída a partir da energia liberada em pontos vizinhos e de um kernel que descreve como essa energia se espalha e se deposita.

Em forma compacta:

Onde:

- T(r’) representa uma grandeza ligada à energia liberada localmente, frequentemente associada a TERMA;

- K representa o kernel de deposição de energia.

O problema é que, em três dimensões e em meios heterogêneos, a superposição completa pode se tornar muito custosa. É preciso considerar muitas contribuições possíveis para cada voxel, e o número de operações cresce rapidamente.

Foi exatamente esse gargalo que motivou o trabalho clássico de Ahnesjö em 1989.

O que a ideia de Ahnesjö faz

Segundo a nota local sobre o artigo de Ahnesjö, o método de collapsed cone convolution parte do cálculo da TERMA por ray tracing e usa kernels poli-energéticos derivados de um banco de dados de kernels monoenergéticos. A grande sacada está em como a energia é transportada:

em vez de tratar a contribuição angular completa do kernel em toda sua granularidade tridimensional, o método agrupa a energia em cones de igual ângulo sólido e colapsa essa energia ao longo das linhas centrais desses cones.

Essa formulação reduz enormemente o número de operações e ainda permite incorporar heterogeneidades de modo muito mais respeitável do que métodos mais simples.

Em termos editoriais, a ideia pode ser resumida assim:

Não é a equação original formal do artigo, mas é uma forma útil de mostrar ao leitor o mecanismo essencial: a energia é redistribuída em direções discretas escolhidas de modo a preservar o conteúdo físico relevante sem pagar o custo integral da superposição total.

O papel da TERMA

Para entender o CCC, é preciso falar de TERMA sem transformar o texto em aula árida.

TERMA é a energia total liberada por unidade de massa a partir das interações dos fótons primários no meio. Em muitos esquemas de convolução/superposição, ela funciona como a “fonte local” de energia que será depois espalhada pelo kernel.

Na síntese local do artigo de Ahnesjö, a TERMA é calculada por ray tracing do feixe através do paciente, enquanto a redistribuição da energia usa kernels de deposição derivados de uma base Monte Carlo. Esse acoplamento já mostra a força do método:

- a atenuação e a energia liberada são tratadas localmente;

- o espalhamento é tratado com kernels fisicamente fundamentados;

- a computação é tornada viável pelo colapso em cones.

O papel dos kernels de Mackie

A história do collapsed cone não fica completa sem o trabalho de Mackie et al. sobre kernels de deposição de energia gerados com EGS. A nota local resume bem por que esse artigo importa: ele fornece a base física para métodos que calculam dose a partir da convolução da fluência com kernels que descrevem o transporte e a deposição de energia de partículas secundárias.

Em outras palavras, Mackie ajuda a construir a matéria-prima física; Ahnesjö ajuda a tornar o uso clínico dessa matéria-prima computacionalmente viável.

Essa combinação explica por que o CCC se tornou tão influente. Ele não inventa a ideia de kernel de deposição, mas inventa uma forma extremamente eficiente de usar essa ideia em um contexto de planejamento real.

A forma analítica dos kernels

Na nota local de Ahnesjö, os kernels poli-energéticos são descritos por uma expressão analítica do tipo:

Os coeficientes dependem da energia e do ângulo, e a presença de termos exponenciais sobre r² ajuda a capturar o comportamento do espalhamento e da atenuação.

Essa representação analítica é importante por dois motivos.

Primeiro, porque facilita o cálculo recursivo ao longo das direções discretas escolhidas.

Segundo, porque mostra que o CCC não é apenas um truque geométrico de amostragem. Ele depende de uma descrição matemática do kernel que preserve suficientemente bem a física do problema.

O que o handbook ajuda a enxergar

O handbook-part-f-dose-calculation resume muito bem a motivação computacional do método. O texto observa que, em vez de contabilizar sistematicamente todas as contribuições de todos os voxels em todas as direções, o collapsed cone passa a amostrar preferencialmente vizinhanças relevantes ao longo de um conjunto finito de linhas ou “pipes”. Em seguida, a energia emitida pelos voxels vizinhos é colapsada nessas direções médias, preservando o transporte total.

É nesse ponto que o nome faz sentido de verdade. O algoritmo trabalha com cones de transporte, mas colapsa a energia nesses eixos médios para ganhar velocidade sem abandonar a ideia de um espalhamento tridimensional.

O mesmo texto destaca algo muito importante para a prática clínica: em contraste com superposition methods que assumem deposição local da energia e ignoram o transporte dos elétrons secundários, implementações derivadas do CCC conseguem representar com razoável precisão tanto o alargamento de penumbra quanto a redução de dose no eixo de feixes de alta energia que atravessam pulmão.

Essa frase resume bem o lugar do método na história. O CCC foi uma maneira eficiente de devolver à clínica uma parte da física que os algoritmos mais simples estavam perdendo.

Por que o ganho computacional foi tão decisivo

Hoje é fácil subestimar o impacto desse tipo de otimização porque o hardware disponível é muito melhor. Mas a história do CCC só faz sentido quando se lembra do problema computacional que ele enfrentava. A superposição tridimensional completa em meios heterogêneos é cara. O collapsed cone reduziu esse custo justamente porque trocou uma integração muito mais extensa por uma amostragem angular fisicamente controlada.

O handbook resume esse ganho de forma muito clara ao explicar que, em vez de considerar sistematicamente todos os voxels que teoricamente contribuem para a dose em cada ponto, o método passa a calcular contribuições ao longo de um número limitado de direções. A energia é então normalizada e colapsada nesses eixos médios.

Em linguagem clínica, isso significa:

- menos custo;

- manutenção de física relevante;

- viabilidade de uso rotineiro em TPS.

Sem esse equilíbrio, o método teria sido apenas uma ideia elegante de paper. Com ele, virou pilar de software clínico.

Por que isso foi tão importante em pulmão

Pulmão sempre foi um teste muito exigente para algoritmos de dose. A baixa densidade altera o transporte de partículas carregadas, alarga penumbra e muda a forma como a dose se reorganiza dentro e depois da heterogeneidade.

O handbook destaca justamente que implementações de CCC conseguem capturar com boa razoabilidade:

- o alargamento da penumbra em baixa densidade;

- a redução de dose ao longo do eixo do feixe dentro do pulmão.

Essa é uma diferença crucial em relação a muitos algoritmos de pencil beam mais simples, que tendem a tratar a heterogeneidade sobretudo como correção de profundidade.

É por isso que o CCC permaneceu tão central na prática comercial. Ele oferece uma melhoria física real em um dos cenários mais sensíveis da clínica, mas sem o custo integral do Monte Carlo.

Da literatura para os TPS comerciais

O próprio handbook menciona que métodos CCC e derivados foram implementados com sucesso em vários TPS clínicos, incluindo plataformas que evoluíram ao longo do tempo para soluções comerciais bem conhecidas. O texto também menciona explicitamente RayStation entre os exemplos mais recentes.

Essa continuidade é reveladora. Um algoritmo só sobrevive tanto tempo em ambiente clínico quando entrega três coisas ao mesmo tempo:

- base física suficientemente forte;

- comportamento estável em ampla faixa de casos;

- custo computacional compatível com a rotina.

O CCC cumpre exatamente esse papel. Por isso ele continua aparecendo em sistemas modernos, mesmo ao lado de métodos mais pesados.

O elo com o RayStation

No caso do RayStation, o white paper oficial descreve o motor clínico de fótons como baseado nos princípios de collapsed cone convolution superposition. A sequência resumida inclui:

- modelo multi-fonte para fluência;

- ray tracing divergente;

- kernels EGSnrc para espalhamento;

- cálculo separado de contaminação eletrônica.

Esse resumo é importante porque mostra como a tradição do CCC foi incorporada a uma arquitetura comercial moderna. O método histórico não aparece isolado; ele é combinado com:

- modelagem mais rica do cabeçote;

- descrição de MLC, leaf tips e tongue-and-groove;

- integração com fluxo de otimização e planejamento contemporâneo.

Em outras palavras, o CCC clínico moderno não é apenas a cópia do paper clássico. É a continuação industrialmente refinada de uma ideia central.

O que o CCC continua ensinando mesmo na era do Acuros e do MC

Mesmo com a presença crescente de transporte determinístico e Monte Carlo, o CCC continua ensinando uma lição importante: em radioterapia, uma boa solução nem sempre é a mais completa do ponto de vista físico absoluto. Às vezes, a melhor solução é a que captura o fenômeno dominante com fidelidade suficiente e custo viável.

É exatamente por isso que o método envelheceu tão bem. Ele se sustenta porque responde a uma pergunta clínica útil:

quanto de física eu consigo trazer para o cálculo sem perder a rotina?

Essa pergunta continua atual. E o collapsed cone continua sendo uma das respostas mais convincentes já dadas a ela.

O artigo de Cho e a implementação prática

A nota local sobre Cho et al. (2012) é útil porque mostra uma camada intermediária entre o artigo histórico de Ahnesjö e os TPS comerciais maduros. O trabalho descreve a implementação prática de um algoritmo CCC em um sistema de planejamento, usando:

- modelo de três fontes para a fluência de fótons;

- cálculo de TERMA com espectro poli-energético, atenuação, horn effect, hardening e transmissão;

- kernel poli-energético aproximado por dezenas de linhas de cones colapsados.

Esse artigo é valioso editorialmente porque mostra que o CCC não ficou preso ao plano conceitual. Ele se tornou uma linguagem prática de implementação em TPS.

O que o collapsed cone não é

Parte da longevidade do CCC vem do fato de ele ser frequentemente mal resumido. Por isso vale dizer claramente o que ele não é.

Ele não é:

- um pencil beam levemente corrigido;

- um Monte Carlo disfarçado;

- uma solução exata do transporte;

- um método antigo preservado por inércia.

Ele é:

- um método de convolução/superposição com forte base física;

- uma solução computacionalmente eficiente para meios heterogêneos;

- um algoritmo particularmente bom em representar espalhamento e penumbra com custo clínico viável.

Onde ele continua fazendo sentido

O CCC continua muito forte quando o serviço precisa de:

- cálculo clínico rápido;

- boa resposta em heterogeneidades relevantes;

- robustez em ampla gama de técnicas e máquinas;

- plataforma previsível para rotina.

Ele tende a ser menos convincente quando a pergunta clínica exige um tratamento ainda mais explícito da física em cenários extremos, especialmente quando o serviço dispõe de Monte Carlo bem validado e o custo adicional faz sentido.

Mas essa observação precisa ser lida com cuidado. Em muitos cenários, a diferença entre CCC e métodos mais pesados não muda a conduta clínica. Em outros, muda. O mérito do CCC está justamente em ter ampliado, por décadas, a faixa de casos em que um motor analítico ainda consegue entregar física suficiente.

É aí que o collapsed cone continua merecendo espaço em qualquer discussão séria sobre algoritmos comerciais. Com Mackie, a área ganhou kernels de deposição derivados de Monte Carlo. Com Ahnesjö, ganhou uma forma engenhosa de transportar essa energia em meios heterogêneos sem tornar o cálculo impraticável. Com implementações posteriores, como as descritas por Cho e pelos fabricantes, essa linha evoluiu até virar motor clínico de rotina.

Se hoje ainda faz sentido estudá-lo em detalhe, não é por nostalgia. É porque ele continua explicando, melhor do que muito discurso moderno, como fazer física relevante caber no tempo da clínica.