O AAA ficou tanto tempo no centro da rotina clínica que muita gente passou a tratá-lo como uma espécie de padrão implícito. Quando ele aparece na conversa, normalmente vem acompanhado da mesma frase: mais forte que o pencil beam, mais leve que os motores de transporte explícito. Isso ajuda pouco. Define o algoritmo por posição de mercado, não por mecanismo.

Se a ideia é entender por que ele ainda aparece em discussões sérias de comissionamento, heterogeneidade e revisão de plano, vale desmontar o motor de verdade. No Eclipse, o Anisotropic Analytical Algorithm é menos interessante como slogan e mais interessante como engenharia: ele tenta ganhar física suficiente para a rotina pesada de fótons sem empurrar o cálculo para um custo operacional alto demais.

Para enxergar isso com clareza, dá para separar o problema em três camadas:

- como o feixe é modelado antes de entrar no paciente;

- como o campo amplo é decomposto em beamlets;

- como a deposição lateral e longitudinal de energia é tratada em meios heterogêneos.

O ponto aqui não é repetir que o AAA “corrige heterogeneidade”. É mostrar o que ele realmente faz, onde ele continua muito competente e em que situações o próprio material da Varian já sugere leitura mais cautelosa.

Neste Artigo

- 1. O que o AAA é, afinal

- 2. A base do algoritmo não começa no paciente

- 3. Beamlets: a unidade de trabalho do AAA

- 4. A expressão central do AAA

- 5. Profundidade radiológica: onde a heterogeneidade entra de verdade

- 6. O kernel lateral e o sentido de “anisotrópico”

- 7. A importância da energia, não só da dose

- 8. Como o algoritmo trata componentes diferentes do feixe

- 9. Onde o AAA é forte na clínica

- 10. Onde a própria Varian recomenda cautela

- 11. Resolução de grade não é detalhe

- 12. AAA não é Acuros em versão mais leve

- 13. Quando o AAA ainda é a escolha certa

O que o AAA é, afinal

Na documentação do Eclipse 17.0, o AAA é descrito como um algoritmo 3D pencil beam convolution/superposition. Essa definição, que às vezes passa despercebida, é uma das mais importantes para interpretar seu comportamento.

O AAA não pertence à família do transporte explícito, como Acuros XB. Ele ainda pertence à genealogia do pencil beam, mas a uma versão muito mais sofisticada dessa escola. Em vez de depender de correções simplificadas para representar espalhamento e heterogeneidade, ele usa:

- modelagem de fonte baseada em componentes distintos do feixe;

- kernels derivados de Monte Carlo;

- decomposição do campo em beamlets;

- escalonamento radiológico e tratamento anisotrópico do espalhamento.

Em outras palavras, o AAA vive no território intermediário entre a simplicidade operacional do pencil beam clássico e a física mais explícita de algoritmos como Acuros ou Monte Carlo. É justamente por isso que ele se tornou tão importante na prática clínica: ele oferece mais física do que os modelos antigos, mas sem o custo computacional dos métodos mais completos.

A base do algoritmo não começa no paciente

Um erro comum ao explicar o AAA é começar pela deposição de dose dentro do corpo, como se a física do problema nascesse na entrada da pele. Não nasce. Antes de qualquer convolução, o algoritmo precisa descrever o feixe clínico.

No Eclipse, AAA e Acuros XB compartilham o mesmo photon beam source model. Isso significa que há uma camada comum de modelagem do cabeçote e da fluência incidente no paciente, construída a partir de dados de configuração e medições. Essa modelagem separa pelo menos quatro contribuições relevantes:

- fonte primária de fótons;

- segunda fonte, representando fótons extra-focais;

- contaminação eletrônica;

- espalhamento associado a modificadores como wedges.

Essa separação é mais importante do que parece. Ela reconhece que o feixe clínico não é um bloco uniforme de fótons com um único comportamento lateral. A parte primária, a parte extra-focal e a contaminação eletrônica têm distribuições espaciais e espectrais diferentes. Quando o algoritmo trata esses componentes de forma separada, ele melhora a descrição do campo antes mesmo de começar a calcular a deposição em profundidade.

Na prática, isso ajuda a explicar por que o AAA oferece um salto tão perceptível em relação a modelos mais simples. Não se trata apenas de ter “mais correções”. Trata-se de partir de uma representação mais física do feixe.

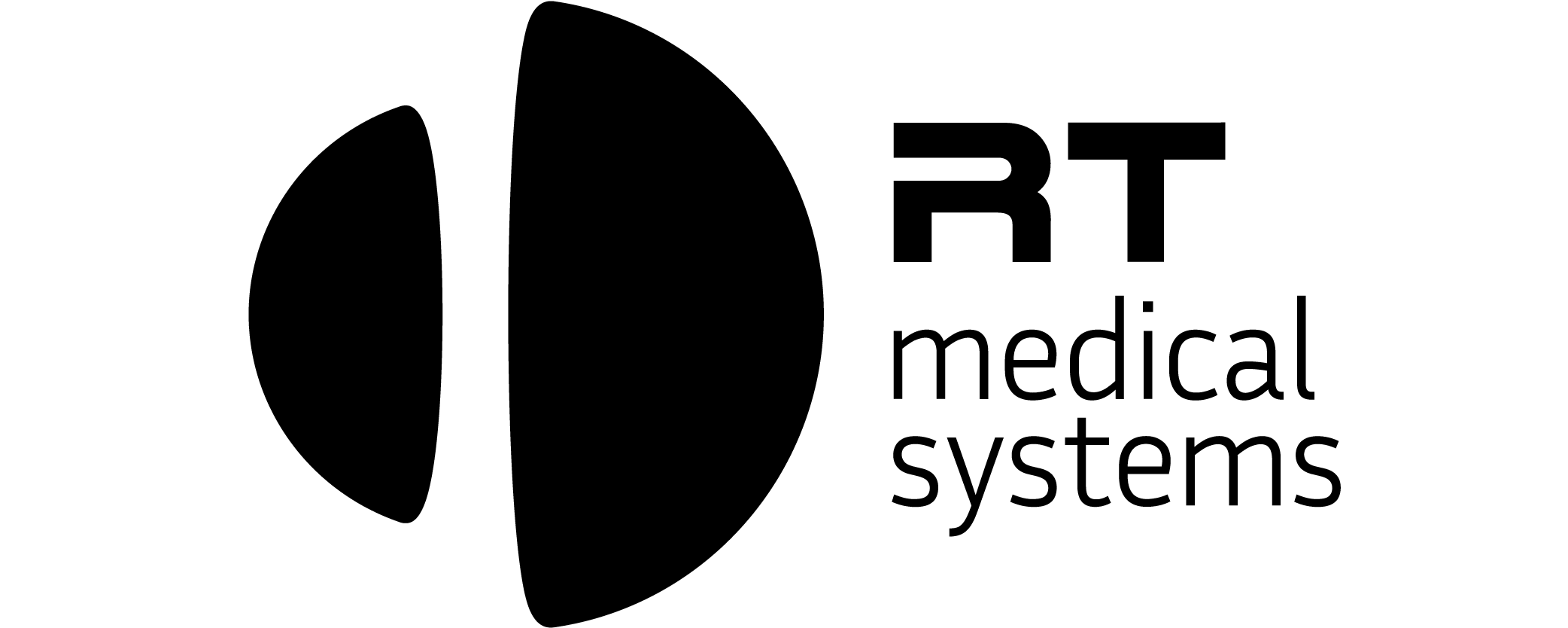

Beamlets: a unidade de trabalho do AAA

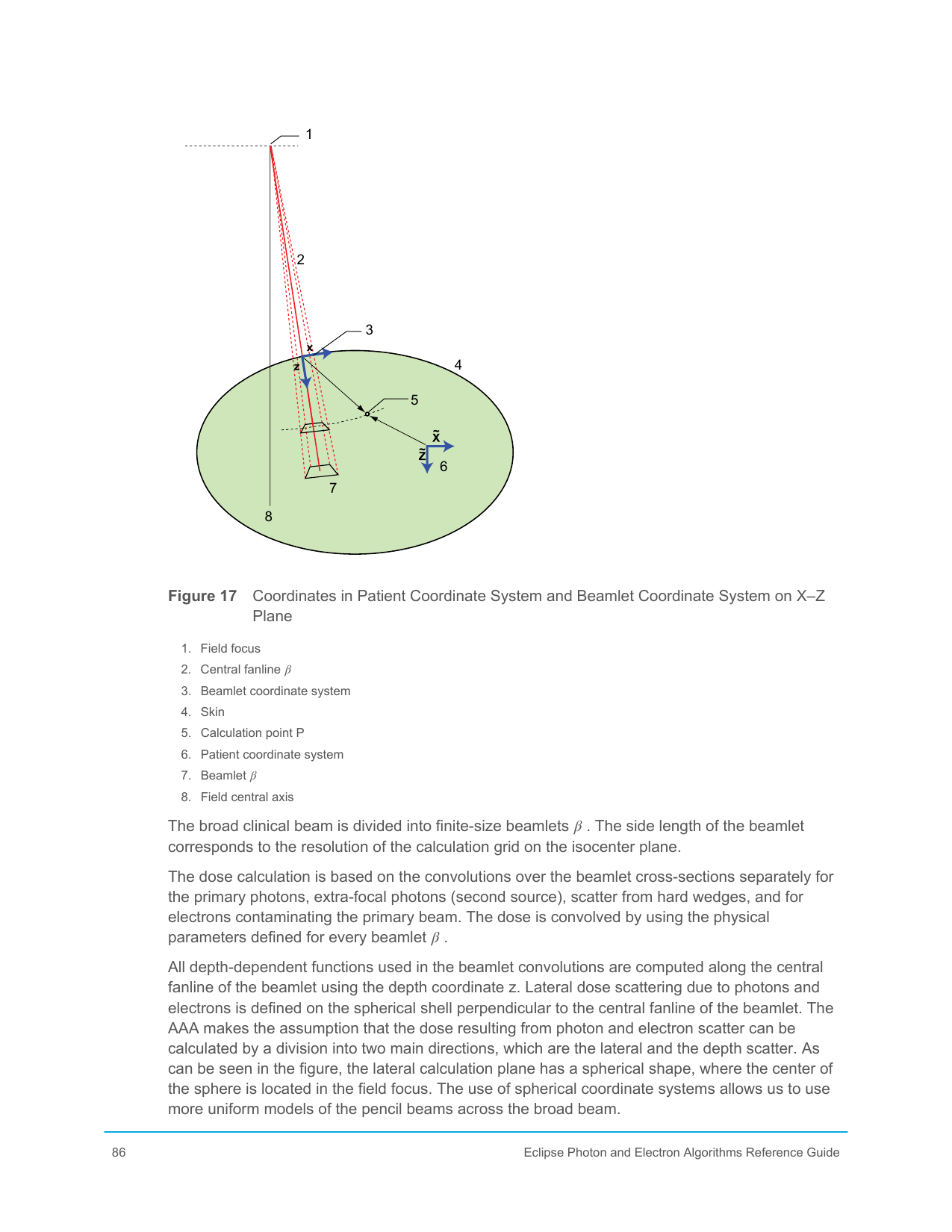

Depois que a fluência clínica é modelada, o campo amplo é dividido em beamlets finitos. A figura clássica do manual da Varian, já extraída localmente, ajuda muito a visualizar essa etapa:

Cada beamlet funciona como uma unidade local de cálculo. Em vez de tentar tratar todo o campo de uma vez, o AAA soma a contribuição de vários pequenos elementos de feixe. Essa abordagem preserva a lógica da família pencil beam, mas a torna muito mais rica quando combinada com kernels derivados de Monte Carlo e com um tratamento anisotrópico da heterogeneidade.

No manual, a largura lateral de cada beamlet corresponde à resolução da grade de cálculo no plano do isocentro. Isso já revela uma dependência prática importante: a resolução escolhida não é apenas um detalhe de visualização. Ela participa da forma como o campo é discretizado internamente.

Cada beamlet carrega:

- sua fluência local;

- sua composição espectral;

- sua posição geométrica;

- os parâmetros necessários para descrever deposição longitudinal e espalhamento lateral.

A dose em um ponto qualquer do paciente é obtida pela superposição das contribuições de todos os beamlets que alcançam esse ponto. Essa arquitetura ajuda a entender por que o algoritmo escala relativamente bem em velocidade e por que ele continua suficientemente flexível para campos complexos.

A expressão central do AAA

O manual da Varian apresenta a energia associada a um beamlet por uma expressão da forma:

Essa equação é uma excelente porta de entrada editorial porque condensa quase tudo o que importa no algoritmo.

\Phi_\beta: a fluência do beamlet

É a parte que representa quanta radiação aquele beamlet carrega. Aqui entram os efeitos da modelagem de fonte, da colimação e da modulação do feixe.

I_\beta(z,\rho): deposição longitudinal

Essa função representa a energia depositada ao longo da profundidade para aquele beamlet, levando em conta a densidade do meio. Ela ajuda a capturar atenuação e o comportamento longitudinal do feixe.

K_\beta(X,Y,Z): espalhamento lateral

É o kernel responsável por distribuir lateralmente a energia. Essa é uma das peças que fazem o AAA sair do território do pencil beam simples e entrar em uma formulação muito mais robusta.

O mais importante aqui é perceber que o AAA não calcula dose como uma única correção aplicada ao feixe inteiro. Ele combina uma descrição local da fluência com uma descrição local da deposição longitudinal e uma descrição local do espalhamento lateral.

Profundidade radiológica: onde a heterogeneidade entra de verdade

Uma das chaves do AAA é a forma como ele trata o percurso do feixe em meios heterogêneos. Em vez de trabalhar apenas com profundidade geométrica, o algoritmo usa profundidade radiológica:

Essa expressão parece simples, mas ela traduz uma ideia importante. O algoritmo tenta reescrever um caminho em tecido heterogêneo como um equivalente em água, ponderando o percurso pela densidade eletrônica relativa.

É justamente isso que permite ao AAA melhorar muito em relação a métodos mais antigos. O feixe não “vê” apenas quantos centímetros percorreu; ele “vê” quantos centímetros radiológicos percorreu.

Mas aqui também aparece uma limitação conceitual. A profundidade radiológica resolve uma parte do problema de heterogeneidade, principalmente ao longo da direção principal do feixe. Ela não resolve sozinha toda a física lateral associada à perda de equilíbrio eletrônico e à redistribuição de dose em interfaces complexas. O AAA avança muito quando introduz anisotropia lateral, mas ainda trabalha dentro do universo de kernels escalados, não de transporte explícito.

O kernel lateral e o sentido de “anisotrópico”

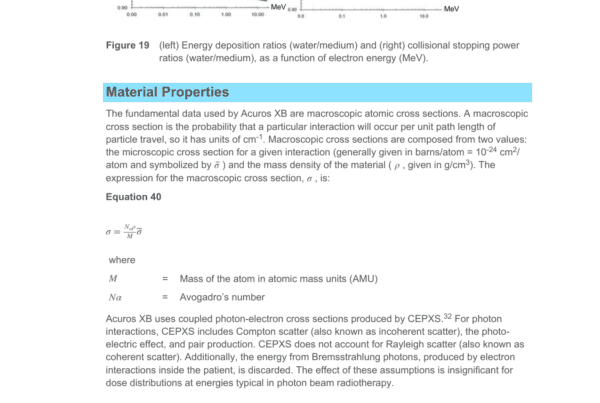

O texto do manual deixa claro que o AAA usa scatter kernels derivados de EGSnrc para fótons monoenergéticos em água e constrói kernels poli-energéticos por combinação ponderada. Em seguida, esses kernels são escalados de acordo com a densidade dos tecidos reais do paciente.

O kernel lateral do AAA é representado como soma de seis funções exponenciais:

Essa forma é importante por dois motivos.

O primeiro é computacional. Ela permite convolução analítica eficiente, que era uma das metas centrais do algoritmo: preservar velocidade clínica.

O segundo é físico. Ao usar várias exponenciais, o algoritmo representa diferentes escalas de espalhamento lateral. Em vez de supor uma única largura de dispersão, ele monta uma combinação de componentes curtas, intermediárias e longas.

O adjetivo anisotrópico no nome do algoritmo não é decorativo. Ele expressa a tentativa de tratar heterogeneidade em múltiplas direções laterais ao redor do sítio de interação, em vez de assumir um comportamento isotrópico simplificado. O manual inclusive descreve o uso de múltiplas direções laterais para a avaliação do espalhamento.

Isso ajuda a entender por que o AAA foi considerado, historicamente, um avanço muito relevante dentro da família dos algoritmos analíticos. Ele reconhece que a heterogeneidade não é apenas um fator de escala na profundidade. Ela altera a distribuição espacial da dose.

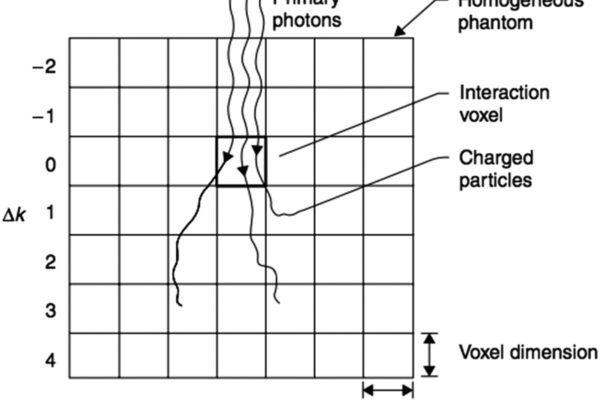

A importância da energia, não só da dose

Outro ponto conceitual elegante do AAA é que a convolução é formulada em termos de energia, não diretamente em termos de dose. A própria documentação da Varian destaca isso como vantagem, porque a convolução em energia ajuda a conservar melhor a quantidade transportada em cenários heterogêneos complexos.

Depois dessa etapa, a energia é convertida em dose usando a chamada scaled-water approximation.

Esse detalhe costuma sumir em explicações resumidas, mas vale ser preservado porque ajuda a separar o AAA de modelos mais ingênuos. O algoritmo não está apenas “espalhando dose”; ele está tentando transportar e redistribuir energia de uma forma fisicamente mais consistente antes da conversão final.

Como o algoritmo trata componentes diferentes do feixe

Na prática clínica, um campo de fótons não é apenas fóton primário. O AAA calcula separadamente:

- a componente primária;

- a componente extra-focal;

- o espalhamento de wedges;

- a contaminação eletrônica.

Essa separação melhora especialmente:

- dose de superfície;

- penumbra;

- descrição de regiões próximas à borda do campo;

- comportamento de campos modificados por acessórios.

O manual destaca, por exemplo, que a contaminação eletrônica é modelada por uma curva dependente da profundidade radiológica e por parâmetros laterais próprios. Essa sofisticação é uma das razões pelas quais o AAA funciona muito melhor do que um pencil beam simplificado em regiões onde o comportamento da superfície e da parte mais rasa do feixe importa.

Ao mesmo tempo, a presença explícita de vários componentes lembra uma verdade prática: algoritmo de dose bom depende de beam model bom. Se a configuração da fonte, dos parâmetros de contaminação eletrônica e dos dados de feixe for ruim, o problema não será resolvido por “ser AAA”.

Onde o AAA é forte na clínica

O AAA continua sendo um algoritmo muito competente em grande parte da rotina de fótons. Sua força está na combinação de:

- boa modelagem de fonte;

- tratamento anisotrópico do espalhamento;

- kernels derivados de Monte Carlo;

- tempo de cálculo compatível com planejamento e otimização clínica.

Ele costuma responder muito bem em:

- casos convencionais de 3D-CRT;

- grande parte dos cenários de IMRT e VMAT;

- heterogeneidades moderadas;

- situações em que a melhoria em relação ao pencil beam é mais importante do que o ganho marginal de motores ainda mais físicos.

Esse é o motivo de o AAA ter ocupado por tanto tempo um espaço tão sólido no fluxo clínico. Ele entrega um patamar de fidelidade física que, para muitos casos, já muda a decisão clínica em relação aos algoritmos antigos, sem impor o custo mais alto de transporte explícito.

Onde a própria Varian recomenda cautela

O mais saudável ao discutir um algoritmo comercial é prestar atenção não só nas suas virtudes, mas também nas fraquezas que o próprio fabricante reconhece.

No guia do Eclipse, a Varian destaca explicitamente limitações conhecidas do AAA, especialmente em pulmão. Há um aviso direto de que, quando o feixe atravessa tecido pulmonar, o algoritmo tende a superestimar a dose na interface onde o feixe sai do pulmão e volta ao tecido mole. O efeito fica mais pronunciado à medida que a profundidade da interface aumenta.

Esse ponto merece ser lido com calma. Não se trata de um erro aleatório. Trata-se de uma limitação estrutural ligada ao tipo de aproximação que o algoritmo usa para representar transporte e espalhamento em meio muito heterogêneo.

O manual também menciona diferenças de desempenho em:

- energias e tamanhos de campo específicos no pulmão;

- campos estáticos com MLC em certas condições;

- wedges duros;

- cenários com suportes e estruturas de alta densidade.

Isso é exatamente o tipo de informação que deveria orientar a prática clínica. Um algoritmo não precisa ser descartado para que suas fraquezas sejam levadas a sério. O que não faz sentido é usar um motor baseado em kernels escalados em um caso crítico de heterogeneidade forte e depois se surpreender quando outro motor mais físico mostrar deslocamento relevante de dose.

Resolução de grade não é detalhe

O guia do Eclipse também chama atenção para algo que muita gente trata como aspecto apenas operacional: a resolução da grade.

No AAA, a resolução pode variar tipicamente entre 1 e 5 mm, e a dose é inicialmente calculada em uma matriz divergente antes de ser convertida para a grade de saída. Além disso, a relação entre resolução definida, pixel spacing e separação entre cortes influencia a forma como a dose é amostrada.

Isso tem consequência real. Em regiões de alto gradiente ou em campos pequenos, o comportamento aparente do algoritmo pode mudar bastante conforme o grid. Em outras palavras, parte do que às vezes é descrito como “diferença entre algoritmos” é, na verdade, diferença entre discretizações do mesmo problema.

Para um físico, isso tem uma implicação metodológica clara: não se compara AAA com outro motor sério mantendo descuido com resolução, slice spacing e parâmetros de amostragem.

AAA não é Acuros em versão mais leve

Uma confusão recorrente é pensar no AAA como se ele fosse apenas um Acuros menos refinado. Não é isso.

Os dois algoritmos compartilham parte da modelagem de fonte, mas pertencem a famílias conceituais diferentes:

| Aspecto | AAA | Acuros XB |

|---|---|---|

| Família | Convolução/superposição baseada em beamlets | Solução numérica da LBTE |

| Base física principal | Kernels derivados de Monte Carlo e escalonamento radiológico | Transporte explícito discretizado em espaço, energia e ângulo |

| Grandeza de imagem mais central | Densidade eletrônica | Densidade de massa e composição material |

| Fraqueza clássica | Interfaces heterogêneas fortes, especialmente pulmão | Dependência de discretização e material mapping |

Essa diferença conceitual precisa ser preservada porque ela muda a interpretação do caso e a forma de validar o resultado.

Quando o AAA ainda é a escolha certa

Há uma tentação contemporânea de tratar algoritmos mais antigos como se fossem automaticamente inferiores em qualquer situação. Isso é um erro de leitura.

O AAA ainda faz muito sentido quando:

- o caso não é dominado por heterogeneidades extremas;

- o fluxo clínico exige velocidade sem abrir mão de física robusta;

- a instituição conhece bem o comportamento do seu beam model;

- a comparação com motores mais físicos não muda a decisão clínica de forma relevante.

Em outras palavras, AAA continua sendo um algoritmo clinicamente muito valioso. O problema nunca foi o algoritmo em si. O problema aparece quando ele é lido como se fosse capaz de responder com a mesma robustez a qualquer cenário físico.

No fim, é isso que mantém o AAA relevante. Ele não é um algoritmo “antigo que sobrou”. Ele é um compromisso muito bem montado entre modelagem de fonte, kernels derivados de Monte Carlo, velocidade clínica e uma forma mais séria de lidar com heterogeneidade do que o pencil beam clássico conseguia oferecer.

Também é isso que explica seus limites. Em pulmão, interfaces fortes e situações em que o transporte lateral pesa demais, o AAA deixa claro que ainda pertence ao mundo dos kernels escalados. Ele pode ir longe dentro dessa família, mas não vira transporte explícito por aproximação.

Ler o algoritmo desse jeito ajuda mais do que repetir rótulo. Ajuda a decidir quando ele ainda é a escolha certa, quando vale recalcular com um motor mais físico e, principalmente, que tipo de discrepância deve ser tratada como limitação esperada, não como surpresa de TPS.