Em água quase homogênea, muito algoritmo comercial parece mais parecido do que realmente é. A diferença aparece quando o feixe cruza pulmão, pega reentrada depois de uma cavidade aérea, atravessa osso denso ou encosta em metal. É aí que a física simplificada começa a cobrar a conta.

Por isso, a comparação que interessa não é “qual TPS parece mais sofisticado”, mas o que acontece quando a dose precisa atravessar:

- pulmão de baixa densidade;

- interfaces ar-tecido;

- osso cortical;

- implantes e materiais de alto Z;

- pequenos campos modulados em geometrias irregulares.

Este artigo organiza o problema por cenário clínico. A pergunta útil não é quem vence uma disputa abstrata entre Pencil Beam, AAA, collapsed cone, Acuros XB e Monte Carlo. A pergunta útil é outra: que hipótese de cada família começa a quebrar quando o meio deixa de parecer água quase homogênea.

Neste Artigo

- 1. Pulmão: o grande teste de honestidade dos algoritmos

- 2. Interfaces ar-tecido: onde a física lateral pesa muito

- 3. Heterogeneidade não é só diferença de dose máxima

- 4. Osso: onde a discussão deixa de ser só heterogeneidade e vira material

- 5. Metal e materiais de alto Z: quando o problema fica ainda menos “água-like”

- 6. Imagem ruim pode mascarar ou amplificar diferença algorítmica

- 7. Pequenos campos: quando a simplificação cobra mais caro

- 8. O que cada família tende a enxergar melhor

- 9. O erro clássico: culpar o algoritmo quando o problema é outro

- 10. Como ler heterogeneidade com mais maturidade

- 11. O que muda quando a heterogeneidade encontra modulação

Pulmão: o grande teste de honestidade dos algoritmos

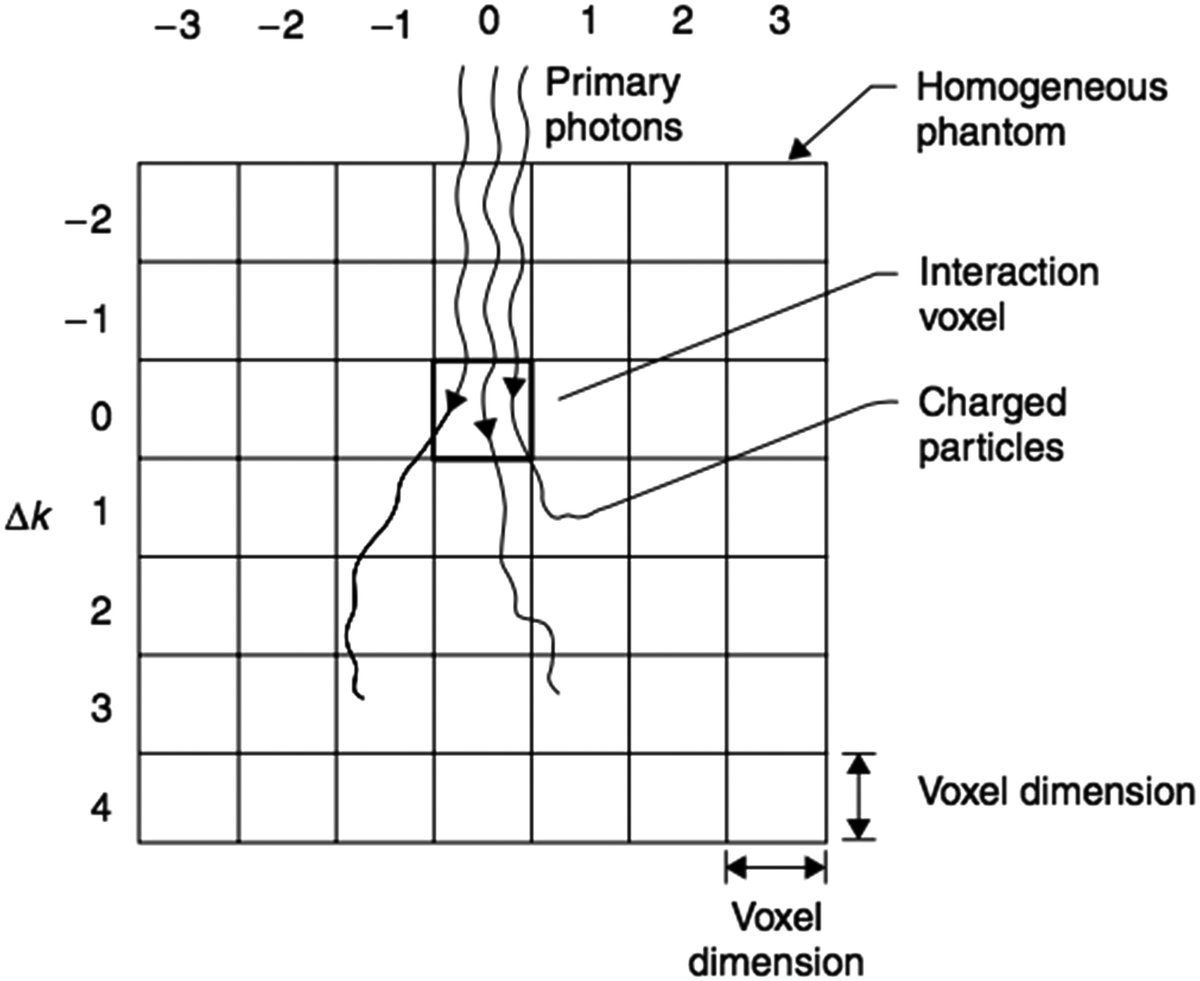

O pulmão continua sendo um dos melhores estresses para qualquer motor de dose. A baixa densidade altera o transporte de partículas carregadas, amplia penumbra, muda equilíbrio eletrônico e faz a reentrada em tecido mole se tornar especialmente sensível ao modelo usado.

Pencil Beam

O Pencil Beam clássico sofre aqui porque sua força está em correções ao longo do eixo principal do feixe, não em um tratamento lateral robusto da heterogeneidade. Em pulmão, essa diferença cobra preço rápido:

- sub ou superestimação dependente do caso;

- dificuldade de representar adequadamente o alargamento lateral;

- fragilidade maior em campos pequenos.

O problema de fundo é que o algoritmo tenta resolver um fenômeno fortemente tridimensional com uma física lateral simplificada.

AAA

O AAA melhora muito o quadro porque incorpora:

- beamlets;

- kernels derivados de Monte Carlo;

- profundidade radiológica;

- tratamento anisotrópico do espalhamento.

Mas o próprio manual da Varian admite limitações claras em pulmão. Para 4–6 MV e campos ≥ 5×5 cm², o algoritmo tende a subestimar dose no pulmão e superestimar dose em tecido equivalente à água após o pulmão. Em energias mais altas (10–20 MV) e campos ≤ 5×5 cm², ele tende a superestimar a dose no pulmão, com erro aumentando à medida que o campo e a densidade pulmonar diminuem.

O texto do Handbook of Radiotherapy Physics reforça essa leitura ao comentar benchmarks em que o AAA sobrestimava a dose pulmonar em feixes pequenos e de alta energia.

Collapsed cone

Métodos de collapsed cone foram exatamente uma resposta a parte desse problema. O handbook destaca que implementações da família CCC conseguem, com boa precisão, representar:

- alargamento de penumbra;

- redução de dose no eixo do feixe em pulmão.

Isso já coloca o CCC em um patamar fisicamente mais forte do que o Pencil Beam mais clássico em baixa densidade.

Acuros XB e Monte Carlo

Em pulmão, é aqui que a diferença de família algorítmica fica mais nítida. O handbook cita comparações entre EGSnrc, Acuros XB e AAA em fantoma com heterogeneidade de baixa densidade, mostrando boa concordância entre Acuros XB e EGSnrc em uma situação extrema, enquanto o AAA falha em reproduzir adequadamente a dose dentro e abaixo da heterogeneidade.

Em outras palavras: pulmão é um cenário em que motores baseados em transporte explícito ou Monte Carlo costumam mostrar seu ganho de forma mais clara.

Interfaces ar-tecido: onde a física lateral pesa muito

Cavidades aéreas, seios paranasais, vias aéreas e outras interfaces entre ar e tecido expõem a limitação de algoritmos que tratam heterogeneidade principalmente como correção longitudinal.

O que o Pencil Beam tende a fazer mal

Interfaces ar-tecido desafiam o Pencil Beam por causa da perda e da recuperação de equilíbrio eletrônico. Quando o algoritmo não representa com boa fidelidade o transporte lateral das partículas secundárias, a dose na interface e logo depois dela tende a ser menos confiável.

Onde AAA melhora e onde ainda sofre

O AAA melhora significativamente em relação ao Pencil Beam porque já trata múltiplas direções laterais via kernels anisotrópicos. Mas ainda permanece na família dos kernels escalados. Isso significa que a descrição da interface continua mediada por uma aproximação, não por transporte explícito.

Onde Acuros e MC ganham terreno

Interfaces ar-tecido são um dos cenários em que a formulação do Acuros XB e do Monte Carlo deixa de ser vantagem teórica e vira vantagem prática. Quando a pergunta clínica depende de como a dose se reorganiza localmente depois de atravessar o ar, a solução explícita do transporte tende a ser mais convincente.

Heterogeneidade não é só diferença de dose máxima

Um erro frequente ao comparar algoritmos em meios heterogêneos é olhar apenas para um número agregado, como dose máxima, média ou mesmo uma leitura simplificada de cobertura. Muitas das diferenças mais relevantes aparecem de outra forma:

- deslocamento de penumbra;

- mudança no gradiente distal;

- reorganização da dose na interface;

- alteração local em regiões pequenas, mesmo quando o DVH global muda pouco.

Isso é particularmente importante em pulmão e cavidades aéreas. Dois algoritmos podem parecer “parecidos” em métricas globais e, ainda assim, discordar exatamente na região que concentra o risco clínico.

Osso: onde a discussão deixa de ser só heterogeneidade e vira material

Se o pulmão é o teste clássico da baixa densidade, o osso é o teste clássico da materialidade do problema. Aqui, já não basta tratar o voxel como água com densidade diferente. A composição do material começa a importar mais visivelmente.

O que isso significa para algoritmos mais antigos

Algoritmos que tratam o meio principalmente por escalonamento equivalente à água tendem a capturar parte do efeito, mas não toda a diferença material.

O que isso significa para o Acuros XB

No Acuros XB, o CT to material mapping e a densidade de massa colocam o osso em outro patamar de descrição física. É por isso que, no debate dose to medium versus dose to water, o osso aparece repetidamente como o material biológico em que a diferença deixa de ser pequena.

O que isso significa para o RayStation

O próprio RayStation alerta que, ao comparar motores diferentes, a discrepância entre convenções de dose pode ficar relativamente grande em osso, na ordem de 10%. Esse dado é importante porque mostra que parte da divergência entre algoritmos em osso não vem apenas do transporte em si, mas também da forma de reportar a dose.

Metal e materiais de alto Z: quando o problema fica ainda menos “água-like”

Implantes, próteses e materiais muito densos pressionam o cálculo de dose em várias frentes:

- artefato de imagem;

- necessidade de material override;

- diferença entre composição real e hipótese de água escalada;

- impacto local da convenção dose to medium vs dose to water.

Aqui, algoritmos material-explícitos ganham importância, mas também exigem mais disciplina. O manual da Varian destaca que o Acuros XB pode bloquear o cálculo ou exigir intervenção do usuário quando densidades ultrapassam o intervalo coberto pela atribuição automática de materiais.

Esse detalhe mostra uma verdade clínica importante: em materiais de alto Z, algoritmos mais físicos não perdoam preparação ruim do caso. Eles são mais poderosos, mas também mais dependentes de uma representação material correta.

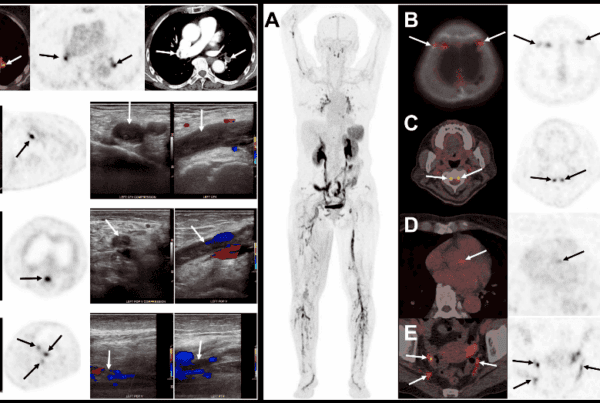

Imagem ruim pode mascarar ou amplificar diferença algorítmica

Em metal e alto Z, vale acrescentar um ponto operacional importante: às vezes o que parece diferença entre algoritmos é, na verdade, diferença entre a forma como cada motor reage a uma mesma imagem problemática.

Artefato de CT, curva de calibração inadequada e ausência de override material podem:

- distorcer densidade;

- distorcer composição presumida;

- deslocar a diferença observada para longe da física real do caso.

Isso é especialmente relevante quando se comparam motores material-explícitos com motores mais água-equivalentes. Sem imagem tratada de forma adequada, a superioridade teórica do método mais físico pode não aparecer de forma limpa.

Pequenos campos: quando a simplificação cobra mais caro

Campo pequeno é uma palavra curta para um problema físico longo. Quando o campo diminui, penumbra ocupa fração maior da distribuição, o equilíbrio eletrônico fica mais frágil e qualquer simplificação na modelagem lateral ou no cabeçote pesa mais.

Pencil Beam

É a família que mais sofre, especialmente em heterogeneidades.

AAA

Pode continuar muito competente em vários contextos, mas o manual do Eclipse destaca que diferenças relevantes em pulmão tornam-se mais graves justamente quando os campos são pequenos e as energias altas.

RayStation CC

O IFU local chama atenção para outro ponto muito importante: em small field rotational plans, o cálculo do RayStation torna-se altamente sensível aos parâmetros de MLC do beam model. Isso é valioso porque evita um erro frequente. Nem toda diferença em campo pequeno é “culpa do motor de dose”; parte dela pode vir do modelo de feixe e do MLC.

MC e motores mais físicos

Motores Monte Carlo ou mais próximos de transporte explícito costumam ganhar força aqui, mas isso não elimina a importância do beam model, da estatística, da resolução de grade e do commissioning.

O que cada família tende a enxergar melhor

| Cenário | Famílias que tendem a sofrer mais | Famílias que tendem a responder melhor |

|---|---|---|

| Pulmão de baixa densidade | Pencil Beam clássico | Collapsed cone, Acuros XB, Monte Carlo |

| Reentrada em tecido mole após pulmão | Pencil Beam, AAA em certos cenários | Acuros XB, Monte Carlo |

| Osso e interfaces densas | Modelos fortemente água-equivalentes | Acuros XB, Monte Carlo |

| Metal e alto Z | Qualquer algoritmo sem material mapping confiável | Motores material-explícitos bem configurados |

| Pequenos campos heterogêneos | Pencil Beam, parte dos modelos simplificados | Motores mais físicos, desde que bem modelados |

Essa tabela precisa ser lida com maturidade. Ela não diz que um algoritmo “perde sempre”. Ela diz onde a hipótese dominante de cada família tende a ser mais pressionada.

O erro clássico: culpar o algoritmo quando o problema é outro

Há um erro de leitura que aparece o tempo todo em comparações clínicas: atribuir toda discrepância ao nome do motor.

Em heterogeneidade, a diferença observada pode nascer de várias fontes ao mesmo tempo:

- família física do algoritmo;

- resolução da grade;

- material mapping;

- convenção de dose;

- beam model;

- modelagem de MLC;

- escopo de validação da máquina e técnica.

O próprio RayStation insiste nisso ao dizer que certas técnicas, como VMAT sequencing, devem ser tratadas como praticamente uma nova técnica, exigindo validação do beam model e QA por paciente. Isso muda completamente o tom da discussão. O algoritmo de dose importa muito, mas nunca atua sozinho.

Como ler heterogeneidade com mais maturidade

Uma leitura mais madura da comparação entre algoritmos em heterogeneidade inclui pelo menos quatro perguntas:

- qual fenômeno físico domina este caso?

- qual hipótese do algoritmo está mais pressionada aqui?

- a diferença observada vem do transporte, da convenção de dose ou do beam model?

- essa divergência é clinicamente relevante ou apenas metodologicamente visível?

Sem essas perguntas, a comparação vira ranking. Com elas, vira física clínica.

O que muda quando a heterogeneidade encontra modulação

Há um ponto final que merece destaque: heterogeneidade raramente aparece sozinha na prática moderna. Ela aparece junto com:

- modulação intensa;

- múltiplos campos;

- arcos;

- campos pequenos;

- bordas de MLC complexas.

Quando isso acontece, o problema deixa de ser apenas “como o algoritmo trata densidade” e passa a ser “como o conjunto algoritmo + beam model + técnica descreve um feixe complexo em meio complexo”. É exatamente por isso que textos regulatórios como o do RayStation insistem tanto em validação específica de técnica e QA por paciente.

É justamente em heterogeneidade que os nomes perdem utilidade e as hipóteses físicas aparecem. Pencil Beam, AAA, collapsed cone, Acuros XB e Monte Carlo não divergem porque um “é melhor” em abstrato. Eles divergem porque simplificam partes diferentes do mesmo problema.

No pulmão e nas interfaces ar-tecido, a lateralidade do transporte vira protagonista. Em osso e alto Z, o problema deixa de ser apenas densidade e passa a ser material. Em campo pequeno, beam model, MLC e discretização começam a pesar tanto quanto o nome do motor.

Se a equipe lê heterogeneidade desse jeito, a comparação entre algoritmos fica muito mais útil. Ela deixa de ser debate de marca e vira uma pergunta concreta sobre onde aquele cálculo ainda se sustenta e onde ele já está fora da zona confortável.