Radiologistas e IA Falham em Identificar Raios-X Gerados por IA

Um estudo publicado na revista Radiology, conduzido por pesquisadores da Icahn School of Medicine at Mount Sinai em Nova York, revela que tanto radiologistas quanto modelos avançados de inteligência artificial têm dificuldade significativa em distinguir raios-X autênticos de imagens geradas por IA. Os resultados levantam preocupações sérias sobre integridade clínica e cibersegurança em ambientes de diagnóstico por imagem.

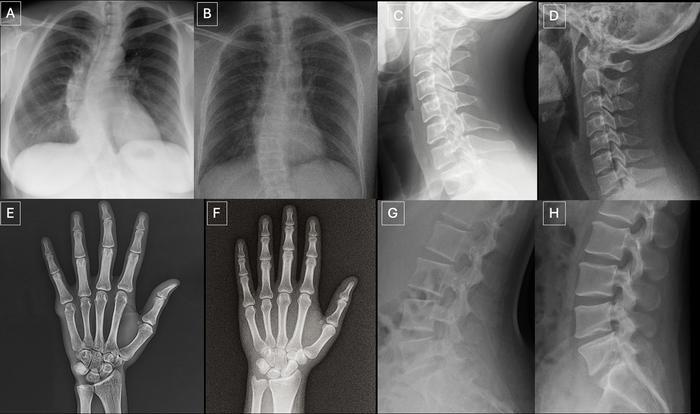

A pesquisa avaliou 17 radiologistas de 12 centros em seis países, que revisaram 264 imagens — metade das quais eram sintéticas. O conjunto de dados incluiu imagens geradas por sistemas baseados em ChatGPT, bem como o RoentGen, um modelo de difusão desenvolvido pela Stanford Medicine.

Apenas 41% dos Radiologistas Identificaram Imagens Falsas Sem Aviso

Quando os radiologistas não foram informados de que imagens sintéticas estavam incluídas no conjunto, apenas 41% as identificaram espontaneamente. Após serem avisados da presença de deepfakes, a acurácia média subiu para 75%, com desempenho individual variando entre 58% e 92%. Curiosamente, o nível de experiência não se correlacionou com a acurácia na detecção — embora especialistas em musculoesquelético tenham apresentado desempenho superior aos demais subespecialistas.

Esse resultado é preocupante porque sugere que, na rotina clínica — onde não há expectativa de que imagens possam ser falsas —, a taxa de detecção seria extremamente baixa. A maioria dos radiologistas simplesmente não esperaria encontrar uma imagem sintética em seu PACS.

Modelos de IA Também Falharam na Detecção

Os modelos multimodais de linguagem avaliados no estudo — GPT-4o, GPT-5, Gemini 2.5 Pro e Llama 4 Maverick — apresentaram taxas de detecção entre 57% e 85%, com variabilidade comparável à dos radiologistas humanos. O dado mais alarmante: mesmo o modelo que gerou algumas das imagens foi incapaz de identificá-las consistentemente. Isso indica que a tecnologia de geração já ultrapassou a capacidade de detecção dos próprios criadores.

A questão se conecta diretamente com achados anteriores sobre IA capaz de detectar laudos de radiologia gerados por IA — se os laudos textuais já apresentam desafios de autenticidade, as imagens diagnósticas representam um risco ainda maior.

Riscos Clínicos e Jurídicos

O autor principal, Dr. Mickael Tordjman, pesquisador de pós-doutorado no Mount Sinai, alertou para potenciais usos maliciosos. “Isso cria uma vulnerabilidade de alto risco para litígios fraudulentos se, por exemplo, uma fratura fabricada puder ser indistinguível de uma real”, afirmou. Ele também alertou para riscos de cibersegurança caso imagens manipuladas fossem introduzidas em sistemas clínicos.

Os cenários de risco incluem:

- Fraude em seguros: imagens sintéticas de lesões inexistentes para obter reembolsos indevidos

- Litígio médico fraudulento: fabricação de evidência radiológica de erros médicos

- Sabotagem clínica: inserção de imagens falsas em prontuários para comprometer diagnósticos

- Manipulação de ensaios clínicos: contaminação de datasets de pesquisa com dados sintéticos

Padrões Visuais e Salvaguardas Propostas

O estudo identificou padrões visuais recorrentes em imagens sintéticas: ossos excessivamente lisos, campos pulmonares simétricos demais e estruturas vasculares uniformes de forma não natural. Embora úteis como pistas, esses artefatos tendem a desaparecer à medida que os modelos generativos evoluem.

Os autores recomendam salvaguardas técnicas como marcas d’água embutidas e assinaturas criptográficas no ponto de captura da imagem — essencialmente garantindo que cada imagem carregue uma prova de origem que não pode ser falsificada. Também defendem a expansão de datasets de treinamento e ferramentas de detecção especializadas à medida que os modelos generativos avançam para modalidades mais complexas como TC e RM.

Implicações para PACS e Fluxos de Trabalho

Para administradores de sistemas de imagem e especialistas em informática médica, o estudo reforça a importância de protocolos de autenticação de imagem integrados ao PACS. Mecanismos como DICOM Digital Signatures e blockchain para rastreabilidade de imagens, ainda pouco adotados, ganham relevância diante da ameaça concreta de deepfakes radiológicos. O cenário de recursos em radiologia para 2026 deve incorporar ferramentas de verificação de autenticidade como componente essencial.

Perspectivas: Uma Corrida Armamentista Digital

O estudo sugere que estamos no início de uma corrida armamentista entre geração e detecção de imagens médicas sintéticas. À medida que os modelos de difusão e os LLMs multimodais se tornam mais sofisticados, a capacidade de gerar imagens radiológicas indistinguíveis de reais tende a aumentar. A resposta precisará combinar soluções técnicas (marcas d’água, criptografia), regulatórias (padrões de autenticação obrigatórios) e educacionais (treinamento de radiologistas para reconhecer artefatos sintéticos).