En Este Artículo

La combinación de inteligencia artificial con simulaciones Monte Carlo puede representar un salto cuántico en la radioterapia computacional. Esta afirmación, realizada en el prefacio de la segunda edición del libro Monte Carlo Techniques in Radiation Therapy (CRC Press, 2022), no es una exageración — los avances recientes en redes neuronales profundas están transformando la forma en que generamos, procesamos y aplicamos datos de simulación MC en la práctica clínica. Para una visión integral de todas las técnicas MC en radioterapia, consulte nuestra guía completa sobre Monte Carlo en Radioterapia.

Guía completa de la serie: para ver el panorama general y los artículos relacionados, vuelve a la guía completa sobre Monte Carlo en radioterapia.

Las simulaciones MC son inherentemente estadísticas y producen volúmenes masivos de datos — características que convierten al campo en un candidato natural para enfoques de deep learning. Las redes neuronales profundas (DNN) ya demostraron capacidad para aprender correlaciones estadísticas complejas en dominios como visión computacional, y ahora esa misma infraestructura metodológica se dirige hacia problemas específicos de la física médica.

Este artículo explora cómo la IA se está integrando al ecosistema Monte Carlo, desde la estimación directa de distribuciones de dosis hasta la aceleración de simulaciones y la corrección de imágenes en CBCT. También discutiremos las tendencias futuras, incluyendo la predicción de que el método MC seguirá siendo un componente esencial de la infraestructura científica en radioterapia.

Redes Neuronales Profundas y Simulación Monte Carlo

Para comprender cómo la IA se conecta con el Monte Carlo, conviene repasar la mecánica básica de las redes neuronales. Una DNN se organiza en capas de neuronas conectadas por pesos ajustables. Cada neurona aplica una función de activación no lineal a la suma ponderada de sus entradas — sin esa no linealidad, toda la red sería simplemente una función lineal gigante, incapaz de capturar patrones complejos.

Cuando trabajamos con datos tipo imagen — como distribuciones de dosis en vóxeles o imágenes de CT — las redes convolucionales (CNN) destacan. Las operaciones de convolución intercaladas entre capas permiten capturar propiedades no locales de los datos de entrada. La arquitectura U-Net, ampliamente utilizada en segmentación médica, combina un camino de contracción (downsampling) con un camino de expansión (upsampling), ideal para transformaciones imagen a imagen. Los autoencoders variacionales y las redes adversariales generativas (GAN) completan el arsenal de arquitecturas empleadas en los trabajos discutidos aquí.

En la práctica, entrenar una red implica ajustar hiperparámetros como tasa de aprendizaje, tamaño de batch y pesos de penalización. Este proceso no es trivial — pero frameworks como Keras, TensorFlow y PyTorch, desarrollados originalmente por grandes empresas tecnológicas, redujeron drásticamente la barrera de entrada para investigadores en física médica.

Una simulación MC en radioterapia puede verse como un mapeo: de una imagen de CT a una distribución de dosis, por ejemplo. No existe una expresión analítica explícita para este mapeo, pero la red neuronal logra aprenderlo a partir de datos suficientes. La simulación involucra transporte de partículas, scoring y binning — operaciones que producen resultados con varianza estadística inherente para cualquier conjunto fijo de condiciones iniciales.

Inteligencia Artificial para Estimación de Dosis MC

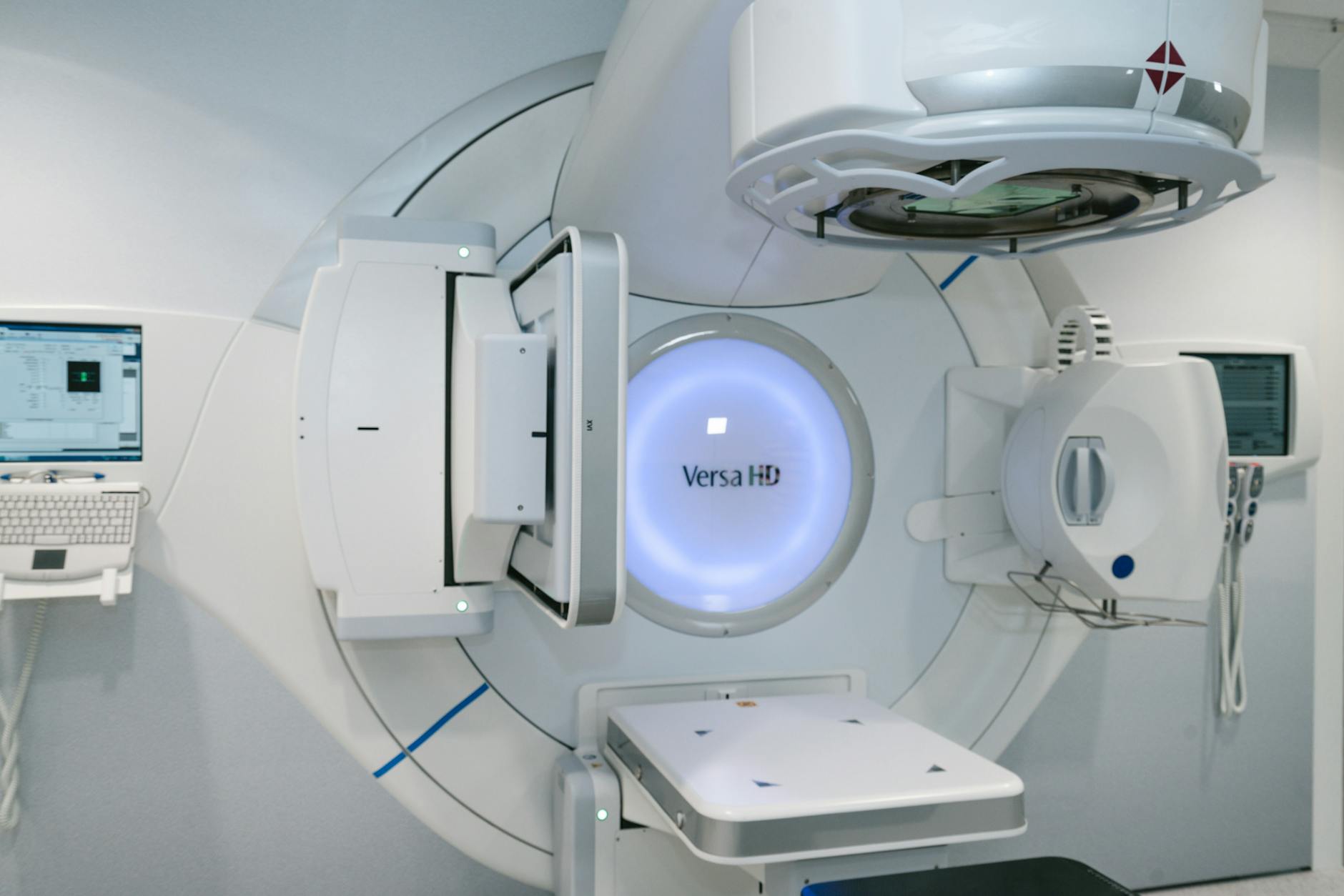

Varios grupos de investigación han explorado el uso de CNNs para estimar distribuciones de dosis en diferentes contextos — radioterapia interna, externa y braquiterapia — utilizando simulaciones MC como referencia de entrenamiento y validación.

Lee et al. (2019) propusieron Deep-Dose, una red basada en U-Net entrenada con patches de imágenes PET y CT asociados a distribuciones de dosis calculadas por GATE (aplicación GEANT4 para tomografía por emisión). La base de datos incluyó diez pacientes con ocho adquisiciones PET/CT tras inyección intravenosa de 68Ga-NOTA-RGD, cubriendo de 1 a 62 minutos posinyección. La precisión se mantuvo dentro del 3% del cálculo de referencia, reduciendo el tiempo de cómputo de horas a minutos.

Götz et al. (2019) combinaron U-Net con descomposición empírica de modos, usando imágenes de CT y mapas de dosis estimados por el protocolo MIRD (método de S-values por órgano) a partir de SPECT para tratamientos con 177Lu. El rendimiento superó al método rápido convencional de dose-volume-kernel.

En radioterapia externa y braquiterapia, Nguyen et al. (2019) utilizaron contornos de estructuras, prescripciones y dosis entregadas como datos de entrenamiento para tratamientos VMAT de cabeza y cuello. Liu et al. (2019) investigaron modelos para tomoterapia helicoidal en cáncer de nasofaringe. Mao et al. (2020) desarrollaron RapidBrachyDL para cálculos rápidos de dosis en braquiterapia. Todos reportaron predicciones precisas.

Un punto crucial: las redes neuronales entrenadas con datos MC nunca podrán reemplazar completamente al MC — siempre dependerán de las simulaciones para generar conjuntos de entrenamiento. El objetivo real es acelerar el cómputo a niveles clínicamente viables (minutos en lugar de horas). El entrenamiento extensivo y las simulaciones MC de referencia pueden realizarse offline. Sin embargo, la construcción cuidadosa del dataset de entrenamiento es fundamental: debe cubrir un rango suficiente de casos clínicos. Para más detalles sobre cómo se modelan los haces fotónicos externos con Monte Carlo, consulte nuestro artículo dedicado.

Otro aspecto frecuentemente ignorado: en un cálculo MC puro, la incertidumbre estadística es conocida. Con una red neuronal basada en MC, esa incertidumbre está implícitamente presente, pero invisible para el usuario.

Denoising de Dosis Monte Carlo con Deep Learning

A diferencia de los métodos de la sección anterior — que intentan reemplazar al MC mapeando directamente de imágenes a dosis — el denoising actúa como posprocesamiento. La red recibe distribuciones de dosis ruidosas (obtenidas con pocos historiales MC) y genera mapas suavizados, equivalentes a simulaciones con muchas más partículas.

Los métodos de denoising MC existen desde hace tiempo. Naqa et al. (2005) demostraron que suavizar fluctuaciones estadísticas puede reducir el tiempo de cálculo. El «ruido» de la dosis calculada está ligado a la varianza en la energía depositada y disminuye a una tasa de $1/\sqrt{N}$, donde $N$ es el número de partículas simuladas. Alcanzar baja fluctuación en regiones de baja dosis requiere un número enorme de iteraciones.

Las técnicas tradicionales de filtrado incluyen wavelets 3D, filtrado media-mediana avanzado y difusión anisotrópica. Funcionan razonablemente, pero la aceleración efectiva depende mucho de las características de la distribución de dosis.

Con deep learning, el principio es entrenar una CNN con pares de distribuciones dosis alta-varianza / dosis baja-varianza, obtenidas de simulaciones MC con baja y alta estadística, respectivamente. La mayoría de los trabajos emplean variantes de la U-Net, aunque DenseNet y codificadores-decodificadores convolucionales también se han estudiado.

| Aplicación | Autores | Modalidad | Indicación |

|---|---|---|---|

| Fotones | Peng et al. (2019), Fornander (2019), Neph et al. (2019), Kontaxis et al. (2020) | EBRT, MRgRT | Cerebro, cabeza y cuello, hígado, pulmón, próstata |

| Protones | Javaid et al. (2019), Madrigal (2018) | Protonterapia | Diversas indicaciones |

| MR-guiada | Neph et al. (2019) | MRgRT (campo magnético) | Dosis por deslocalización de partículas cargadas en campo magnético |

Fuente: Monte Carlo Techniques in Radiation Therapy (2nd ed., CRC Press, 2022)

Los resultados son alentadores. Las CNNs produjeron mapas de dosis con equivalencia de ruido usando de 10 a 100 veces menos partículas de las originalmente necesarias. Las métricas de evaluación incluyeron peak signal-to-noise ratio, índice gamma e histogramas dosis-volumen (DVH).

Quedan desafíos. Los resultados dependen del tamaño y complejidad de los datasets de entrenamiento, y la generalización a otros escenarios aún no está garantizada. Crucialmente, los mapas de dosis denoised deben preservar gradientes de dosis — y aún no está completamente claro cómo garantizar esto en todas las situaciones. Para entender mejor cómo se calcula la dosis en el paciente, consulte nuestro artículo sobre cálculo de dosis en el paciente con Monte Carlo.

El problema de denoising no se limita a distribuciones de dosis. Métodos investigados para CT de baja dosis — como los de Wolterink et al. (2017) y Yang et al. (2018) — pueden servir de inspiración para aplicaciones en radioterapia.

IA para Modelado de Detectores y Fuentes de Radiación

Los trabajos presentados hasta aquí dependen de los resultados de simulaciones MC, sin alterar la simulación en sí. La siguiente frontera es más ambiciosa: reemplazar partes de la propia simulación MC con redes neuronales, acelerando el transporte de partículas en componentes geométricos específicos.

Sarrut et al. (2018) propusieron una DNN para aprender la Angular Response Function (ARF) de un sistema colimador-detector SPECT. En vez de simular explícitamente el transporte de fotones en el cabezal de imagen, la red recibe propiedades cinemáticas de los fotones (energía y dirección) que cruzan un plano virtual y devuelve probabilidades de detección en cada ventana de energía. Comparada con las ARF basadas en histogramas, el enfoque con red neuronal depende menos de la estadística de datos de entrenamiento, no requiere binning explícito y necesita menos datos de entrenamiento. El speedup respecto al MC analógico varió de 10 a 3.000: más eficiente en regiones de bajo contaje (speedup de 1.000–3.000) que en regiones de alto contaje (speedup de 20–300), y más eficiente para radionúclidos de alta energía como 131I. Esta implementación está disponible en la plataforma GATE.

En PET, se propusieron redes neuronales para estimar la profundidad de interacción (DOI) y la posición de eventos en centelleadores pixelados o monolíticos continuos (Zatcepin et al. 2020; Berg y Cherry 2018; Müller et al. 2019). Incorporar la DOI en la reconstrucción de imagen mejora la calidad de las imágenes PET.

Quizá la aplicación más audaz sea el uso de GANs para generar phase spaces. Sarrut et al. (2019) emplearon redes adversariales generativas para aprender la distribución del phase space generado por la simulación de un LINAC. Las propiedades (energía, posición y dirección) de todas las partículas que alcanzan un plano en la salida del cabezal se almacenan en archivos de phase space — típicamente de decenas de gigabytes y difíciles de manejar. Tras el entrenamiento, la red generadora «G» produce partículas que pertenecen a la distribución de probabilidad original, ocupando unos 10 MB en vez de varios GB. Las pruebas demostraron buena precisión dosimétrica, incluso para braquiterapia de próstata. Para detalles sobre modelado de haces y phase spaces, consulte nuestro artículo sobre fundamentos del Monte Carlo en radioterapia.

Quedan preguntas abiertas: no está claro si la misma arquitectura GAN funciona para todos los tipos de phase space, y el entrenamiento exige ajuste delicado de hiperparámetros. Métodos alternativos como modelos de mezcla gaussiana también pueden ser útiles.

Corrección de Scatter en CBCT con Redes Neuronales

La tomografía computarizada cone beam (CBCT) es inseparable de la radioterapia moderna, pero sufre de calidad de imagen inferior y artefactos causados por scatter. El panel de imagen captura no solo fotones primarios atenuados de la fuente de rayos X, sino también fotones de dispersión coherente e incoherente dentro del paciente. Para una reconstrucción precisa de imagen, la contribución del scatter debería conocerse y sustraerse — pero en la práctica, el panel proporciona solo una señal de intensidad acumulativa sin discriminación.

Las simulaciones MC ofrecen una solución conceptual: pueden etiquetar específicamente fotones dispersados, generando proyecciones scatter-free perfectas. Jarry et al. (2006) ya usaban MC para estimar scatter en CBCT. El problema es que la simulación directa de fotones kV es demasiado lenta para integración clínica, incluso con técnicas de reducción de varianza (Mainegra-Hing y Kawrakow 2008).

Trabajos recientes proponen redes convolucionales profundas que aprenden de proyecciones CBCT simuladas por MC. Las redes generan imágenes de scatter estimado como salida a partir de proyecciones brutas como entrada (Lee et al. 2019; van der Heyden et al. 2020; Lalonde et al. 2020; Maier et al. 2019). Todos reportan resultados prometedores. Estos métodos dependen exclusivamente de simulaciones MC para entrenamiento, donde fotones primarios pueden distinguirse de dispersados — imposible solo con proyecciones experimentales.

Otro enfoque opera en el dominio de la imagen: recibe CBCT como entrada y genera CT sintético como salida. Estas imágenes sintéticas presentan muchos menos artefactos que las CBCT originales.

Perspectivas y el Futuro del Monte Carlo en Radioterapia

La integración de IA con Monte Carlo trae un cambio de paradigma en la física médica. En cierta medida, el investigador debe abandonar el instinto de dominar matemáticamente el fenómeno investigado y, en cambio, confiar en grandes volúmenes de datos para aprendizaje heurístico. Esta transición demandará nuevas competencias — la habilidad de implementar y gestionar tareas computacionales complejas será tan importante como el modelado de física de radiación.

Sin embargo, como este artículo ha demostrado, los trabajos en deep learning para radioterapia dependen fuertemente de datos de entrenamiento generados por MC. La simulación debe configurarse y evaluarse con competencia. La generación de datasets adecuados puede convertirse en una habilidad en sí misma, análoga al commissioning de un sistema de planificación (TPS).

Actualmente, la IA opera en el nivel «alto» del MC — conectando entrada (CT) con salida (dosis) de una simulación o sustituyendo etapas intermedias (como GANs para phase space). Queda por ver si la IA será útil en niveles más profundos del código MC, como en el transporte de partículas. Es posible imaginar redes neuronales sustituyendo modelos numéricos handcrafted para ajustar datos medidos complejos o funciones de distribución de probabilidad para ciertos tipos de interacciones.

La comunidad de física de altas energías (HEP) ya explora activamente la IA: deep learning para modelado de interacciones nucleares (Ciardiello et al. 2020), redes neuronales en física de materia condensada (Carrasquilla y Melko 2017), y GANs para simulación rápida de cascadas de partículas en calorímetros electromagnéticos (Paganini et al. 2018). El intercambio de conocimiento entre HEP y radioterapia sería extremadamente beneficioso.

En cuanto al método Monte Carlo en sí, la ley de Amdahl seguirá siendo un factor limitante para máquinas masivamente paralelas, pero las ganancias en velocidad de chips monoprocesador siguen la ley de Moore. El desarrollo de algoritmos es más difícil de predecir — datos históricos muestran saltos de productividad inexplicables: un factor de 2,8 en 1991 y 1,6 en 1998, ilustrando la naturaleza caótica del progreso en este campo.

Desde 2005 aparecieron nuevos códigos — principalmente interfaces para códigos existentes como TOPAS y GATE — y el número de publicaciones sobre MC sigue creciendo rápidamente. GEANT4, en particular, muestra un fuerte crecimiento en su uso. Como señaló el prefacio del libro, «aún no hemos visto el fin de las aplicaciones potenciales, garantizando diversión sin fin para las generaciones venideras.»

El panorama está claro: el tiempo de entrenamiento de las redes sigue siendo grande y exige GPUs potentes. La generalización de los modelos aprendidos a datasets diferentes de los de entrenamiento permanece incierta. La precisión final no siempre alcanza el nivel del MC convencional. Aun así, este es un campo extremadamente prometedor, y el número de publicaciones en la intersección de IA y MC para radioterapia debería crecer exponencialmente en los próximos años. Para explorar cómo el Monte Carlo se aplica a otras modalidades como protonterapia y QA avanzado, consulte nuestro artículo sobre protones y QA avanzado con Monte Carlo.